生成AI

最終更新日:2026/04/27

生成AIの問題点を解説!

生成AIの問題点を解説!

「生成AIを業務に使いたいが、情報漏洩や著作権侵害が怖い」「どこまで使って良いのか社内ルールが整備できていない」こうした悩みを抱えるビジネスパーソンは少なくありません。

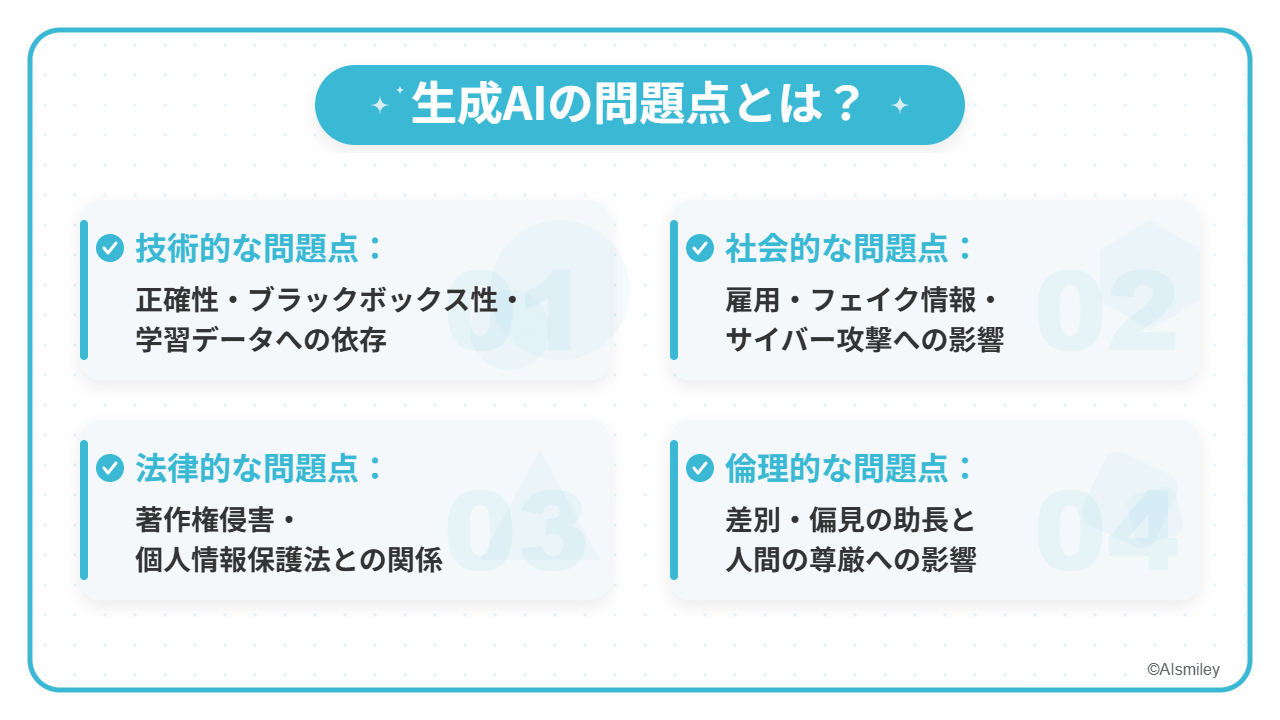

本記事では、生成AIが抱える問題点を技術・社会・法律・倫理の4つの観点から整理し、実際の企業事例と具体的な対策まで解説します。

生成AIが抱える問題点は大きく「技術的・社会的・法律的・倫理的」の4つに分類できます。

| 観点 | 主な問題点 | 具体的なリスク例 | 影響を受けやすい場面 |

|---|---|---|---|

| 技術的問題 | ハルシネーション(誤情報の生成) | 事実と異なる情報・存在しないデータの出力 | 医療・法務・財務など高精度が求められる業務 |

| ブラックボックス性 | 出力根拠が不明確で検証が困難 | 意思決定の根拠が必要な業務全般 | |

| 学習データへの依存 | 古い情報・偏った情報の出力、日本語精度の低さ | 最新情報や専門知識が必要な場面 | |

| 社会的問題 | フェイク情報・なりすまし | ディープフェイク詐欺・偽情報の拡散 | 企業の広報・SNS・金融取引 |

| 雇用への影響 | 定型業務の自動化による雇用減少の可能性 | データ入力・翻訳・事務処理などのルーティン職 | |

| サイバー攻撃への悪用 | フィッシングメール自動生成・マルウェアコード生成 | 企業のセキュリティ全般 | |

| 法律的問題 | 著作権・知的財産権の侵害 | 既存コンテンツに類似した出力の商用利用 | マーケティング資料・画像・テキスト生成 |

| 個人情報保護法への抵触 | 入力情報の第三者提供・情報漏洩リスク | 顧客情報・従業員情報を扱う業務 | |

| 倫理的問題 | 差別・偏見の助長 | 学習データの偏りによる差別的出力 | 採用選考・融資審査・保険料設定 |

| 人間の尊厳への影響 | AI生成コンテンツを人間の作成物と偽る行為 | 教育・クリエイティブ・カスタマー対応 |

この4分類はそれぞれ独立した問題ではなく、技術的なリスク(ハルシネーション)が法的問題(誤情報の公開による責任)や社会的問題(誤情報の拡散)へと連鎖するように、相互に絡み合っています。

AIを導入する前に全体像を把握しておくことが、後のトラブルを防ぐ最も効果的な一手といえます。

生成AIには、ビジネス活用において注意すべき技術的な課題が3つあります。

1つ目は、事実と異なる情報をもっともらしく生成する「ハルシネーション」です。医療分野での架空の薬剤名提示や法務分野での存在しない判例の引用といった事例が報告されています。

2つ目は「ブラックボックス性」で、なぜその回答が導かれたのか根拠が不透明なため、出力を鵜呑みにできません。

最後に「学習データ」への依存です。カットオフ(学習データを収集した締切日)以降の情報は反映されず、データの偏りがそのまま出力に影響します。

同じ質問でも回答が変わる「ゆらぎ」や、英語と比べた日本語対応の精度差も見逃せないポイントです。

不正確さが重大なリスクに直結する医療・法務・財務などの専門領域では、これらの問題が重大なミスや意思決定の誤りにつながる恐れがあるため、人によるファクトチェック体制の整備が欠かせません。

生成AIの普及は雇用市場にも大きな波紋を投じています。ルーティン業務が自動化されることで、特定の職種の雇用が減少するリスクが指摘されています。

一方で、AI活用を推進するための専門人材や、AIが生成したコンテンツを監督・編集するスキルを持つ人材へのニーズが高まっており、雇用の「消滅」ではなく「変容」という側面もあります。

社会的リスクとして見逃せないのが、フェイクニュースやディープフェイクへの悪用です。

生成AIを使えば特定人物の発言を模倣した偽動画や、実在しない出来事を伝える偽ニュースを低コストで大量生成できます。なりすましによるビジネスメール詐欺や、選挙・株価に影響を与える偽情報の拡散は、企業の広報活動やブランドイメージにも深刻な打撃を与えかねません。

加えて、生成AIはサイバー攻撃の高度化にも利用されています。

説得力の高いフィッシングメールの自動生成や、ゼロデイ脆弱性を狙うマルウェアのコード生成など、従来のセキュリティ対策が通用しない攻撃手法が次々に登場しています。

生成AIの普及は、企業のセキュリティコストを引き上げる要因にもなっています。

生成AIの出力コンテンツを商用利用する際、最も注意すべきは著作権リスクです。

日本の著作権法第30条の4は、情報解析を目的とするAI学習での著作物利用を原則許容していますが、「著作権者の利益を不当に害する場合」はこの限りではありません。

また、学習段階での問題とは別に、AIが生成したコンテンツが既存作品に類似している場合(類似性・依拠性が認められる場合)、それを公開・商用利用した企業が著作権侵害の責任を負う可能性があります。

個人情報保護の観点では、生成AIに顧客情報や従業員情報を入力することが個人情報保護法上の「第三者提供」に該当しうるとの指摘があります。

多くのクラウド型AIサービスでは、入力データがモデル改善のために再学習に使用される可能性があり、規約の詳細を確認せずに利用すると情報漏洩リスクが高まります。

EUのAI法(EU AI Act)は2025年から段階的に本格運用に入っており、日本企業がEU圏内でサービスを展開する場合は「リスクベース・アプローチ」に基づく規制対応が求められます。

生成AIは大量のデータから学習しますが、そのデータに社会的な偏見や差別が含まれていれば、AIはその偏りをそのまま再現・増幅してしまいます。

採用選考、融資審査、保険料設定などにAIを活用する際、特定の性別・人種・年齢層が不当に不利な扱いを受ける「意図しない差別」が生じるリスクがあります。

また、AIが人間の声・表情・文体を精巧に模倣できるようになったことで、「人間が作ったと思っていたものがAI生成だった」という事態が増えています。

AI生成であることを開示せずに消費者にコンテンツを提供する行為は、信頼関係を損ない企業レピュテーションの低下を招きます。

理論的なリスクとして語られがちな生成AIの問題点ですが、実際のビジネス・社会の場で深刻な被害が相次いでいます。

以下では「情報漏洩・著作権侵害・ディープフェイク詐欺・フェイク画像拡散」の4類型から代表的な事例を取り上げます。

2023年3月、韓国のサムスン電子で複数の従業員がChatGPTに社内の機密情報を誤って入力してしまうという事故が発生しました。

入力された内容には設備情報や会議内容が含まれており、これらの情報がOpenAIのサーバーに送信・保存される形で社外に流出しました。

問題の根本的な原因は、生成AIの利用に関するセキュリティガイドラインが整備されていなかったことにあります。クラウド型のAIサービスに一度送信された情報は、サービス提供側の管理下に入るため完全な回収が事実上不可能です。

「まず使ってみる」という姿勢の前に、利用ポリシーの策定が不可欠であることを明確に示した事例です。

著作権問題をめぐるAI企業への訴訟は2026年3月現在も続いています。

ニューヨーク・タイムズが2023年末にOpenAIとMicrosoftを提訴した案件では、2025年11月の証拠開示手続きでOpenAIに対し2,000万件以上のChatGPTチャットログの開示が命じられ、AIが実際にどの程度著作物を再現しているかの立証が進められています。

また、Getty Imagesは画像生成AIのStability AIを提訴しており、許可なく著作権保護された画像を学習データに使用した点が争点となっていました。

2025年11月の英高等法院判決では、Getty ImagesがStability AIに対して訴えた著作権侵害の主な主張(AIモデルが著作権侵害複製物にあたるとの訴え)は棄却されました。

一方、旧バージョンのStable Diffusionがウォーターマークに酷似した画像を生成した点については商標権侵害が部分的に認定されており、AIモデル提供者側に責任が及びうることが示されています。

これらの訴訟は、生成AIをめぐる法的リスクが著作権にとどまらず商標権・不正競争など多岐にわたることを示しており、日本企業が生成AI出力を商用利用する際には幅広い知的財産リスクを想定した体制整備が求められます。

2024年初頭、香港企業の財務担当者がビデオ会議でCFOや複数の同僚に見せかけたディープフェイク動画を通じ、2500万米ドル(日本円で約38億円相当)を不正送金させられる事件が発生しました。

詐欺師はAI技術を使って実在する社員の顔・声・動作を精巧に再現したオンライン会議を偽造し、財務担当者に送金を指示したのです。

国内でも画像生成AIによる社会的被害が現実となっています。

台風などの自然災害時に、実際には存在しない被災地の様子を描いたAI生成画像がSNSで拡散し、デマとして社会的混乱を引き起こすケースが確認されています。

こうした偽情報は救助活動の妨げとなるだけでなく、企業の公式情報と混同されることでブランド毀損にも発展しかねません。

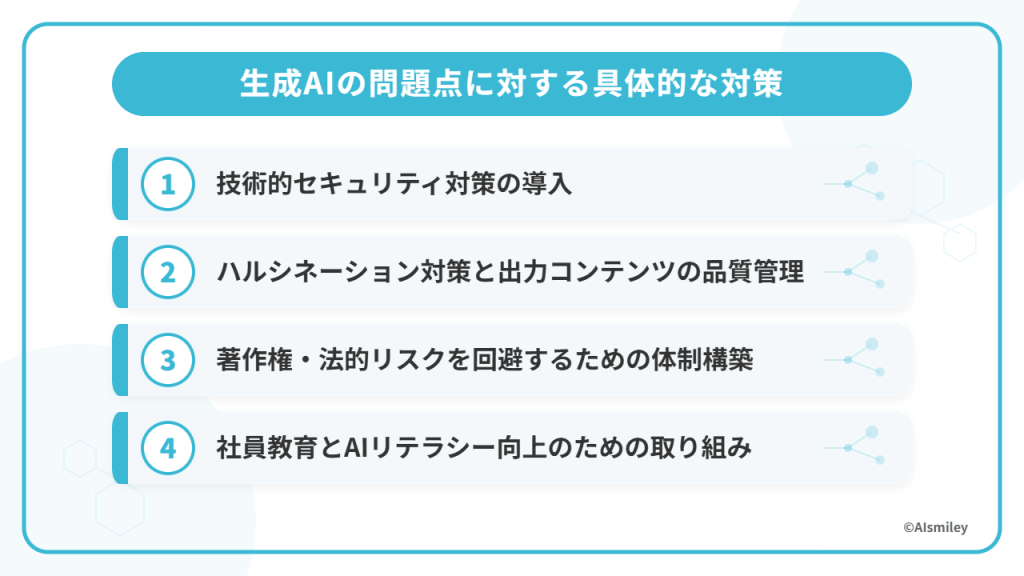

生成AIのリスクを理由に導入を見送ることは、競合他社に先行される機会損失ともなります。重要なのは「使わない」ではなく「適切な対策を講じた上で使う」ことです。

対策は技術・法務・組織・運用の4つの側面から体系的に講じる必要があります。以下ではそれぞれの対策を詳しく解説します。

情報漏洩リスクを低減する最初のステップは、入力データの分類と制限です。

機密度ごとに「生成AIへの入力可否」を明確にルール化し、個人情報・機密情報・未公開情報は原則として生成AIに入力しない運用を徹底しましょう。

既存のクラウド型サービスを使う場合は、利用規約で「入力データをモデル改善に使用しない(オプトアウト)」設定が可能かどうかを必ず確認してください。

機密性の高い業務には、プライベートクラウドやオンプレミス型のAI環境の採用も選択肢に入ります。

昨今では、オンデバイスAI(端末内で完結するAI)の性能も向上しており、特に医療・金融・法務分野では外部サーバーにデータを送らずに処理できる環境構築が有効です。

ハルシネーションを完全に排除することは現時点では技術的に困難ですが、リスクを低減する方法があります。

最も基本的な対策は「AIの出力をそのまま使用しない」ことです。特に顧客向けや対外公表資料への転用前には、担当者によるファクトチェックと、法務・専門部署による多段階の確認プロセスを設けてください。

また、プロンプトの品質を高めることでも出力精度は向上します。

「この情報に不足がある場合はその旨を伝えてください」「記載されている文書の内容のみに基づいて答えてください」といった指示を加えることで、AIが推測で情報を補完するリスクを抑えられます。

医療・法務・財務など高精度が求められる分野では、AIの使用範囲を補助的業務に限定する運用ルールの策定を推奨します。

生成AIの出力コンテンツを商用利用する前には、著作権チェックを義務化する社内体制の構築が欠かせません。

具体的には、AI生成テキスト・画像を既存著作物と比較できる類似性チェックツールの導入、および法務部門または外部顧問弁護士によるリーガルレビューの実施が有効です。

文化庁が公開している「AIと著作権に関するチェックリスト&ガイダンス」も体制構築の参考になります。

社内ルールとしては、AI生成コンテンツのコピー&ペーストによる直接利用を原則禁止し、あくまで参考・たたき台にとどめる運用を徹底することをおすすめします。

また、利用する生成AIサービスの利用規約を精査し、「AIが生成したコンテンツの権利がどちらに帰属するか」「学習データの取得方法に著作権上の問題がないか」を定期的に確認する仕組みも必要です。

技術的・法的な対策が整っていても、それを実行する従業員のリテラシーが低ければ意味がありません。

現場社員、管理職どちらに対してもAIリテラシー向上のための研修プログラムを実施することが重要です。研修内容には、機密情報の入力禁止ルール、著作権リスクの基礎知識、ハルシネーションの見分け方、適切なプロンプトの作成方法を含めることを推奨します。

また、組織的な取り組みとしては、部門別ガイドラインの整備(営業・マーケティング・法務・開発など用途別のルール策定)、定期的な理解度テストの実施、技術の進化に合わせた運用ルールのアップデートが重要です。

AIは数ヶ月〜半年ごとに機能がアップデートされるため、「一度研修すれば終わり」という発想ではなく、継続的に学び直す仕組みを組み込むことが必要になります。

生成AIの問題点を正確に理解した上でも、その潜在的なメリットは問題点を上回ります。業務文書の自動化による生産性向上、アイデア発想や情報収集の高速化、高度な顧客対応の自動化など、活用領域は急速に広がっているためです。

さらに、今後はAIエージェント(自律的にタスクを実行するAI)の企業導入が本格化していくフェーズにあります。

一方、AIの能力が向上するにつれて、新たなリスクも次々に生まれています。

AIエージェントが自律的に外部サービスと連携したり、社内データにアクセスしたりするようになると、情報漏洩や誤動作のリスクは従来の生成AIよりも格段に複雑になります。

生成AIを安全かつ効果的に活用し続けるためには、技術動向と法規制を継続的に注視し、社内のガバナンス体制・利用ルールを定期的にアップデートする仕組みを作ることが欠かせません。

AIを万能ツールと盲信せず、リスクを管理しながら段階的に活用範囲を広げていく姿勢が、今後のビジネスシーンで求められるAIとの向き合い方といえます。

生成AIには業務効率化の可能性がある一方、情報漏洩・著作権侵害・ハルシネーションといった無視できないリスクも存在します。

導入を進める場合は、入力情報のルール化、出力内容の確認体制、法務面のチェック、社員教育の4点を整備することが基本的な対応となります。

技術や法規制は今後も変化し続けるため、状況に応じた継続的な見直しが必要です。

アイスマイリーでは、生成AIのサービス比較と企業一覧を無料配布しています。課題や目的に応じたサービスを比較検討できますので、ぜひこの機会にお問い合わせください。

業務の課題解決に繋がる最新DX・情報をお届けいたします。

メールマガジンの配信をご希望の方は、下記フォームよりご登録ください。登録無料です。

AI製品・ソリューションの掲載を

希望される企業様はこちら