生成AI

最終更新日:2026/04/30

画像認識AIの仕組みと活用事例

画像認識AIの仕組みと活用事例

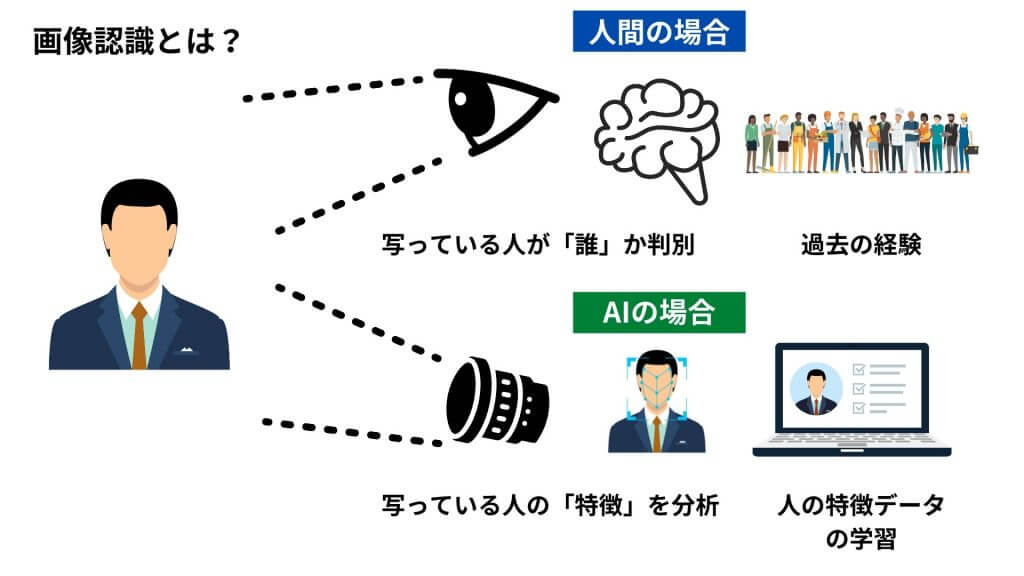

画像認識とは、AI(人工知能)を活用して画像や動画データを解析し、そこに「何が写っているか」「どこにあるか」「どのような状態か」を瞬時に判別する技術です。

近年、その活用範囲は急速に広がっており、製造業における高精度な「外観検査」をはじめ、医療現場での「画像診断支援」、セキュリティを高める「顔認証」や「防犯カメラの解析」、さらには物流管理やOCR(光学文字認識)による書類処理など、あらゆる業界で実用化が進んでいます。

これまで「人の目」に頼らざるを得なかった目視確認や判定作業をAIで自動化することにより、慢性的な人手不足の解消はもちろん、ヒューマンエラーの防止(精度向上)と大幅な業務効率化を同時に実現する技術として、いま最も熱い視線を集めています。

画像認識(Image Recognition)とは、AIやコンピューターが画像や動画データを解析し、そこに写る人・物・文字・風景などを識別して「何が写っているか」「どこにあるか」「どのような状態か」を瞬時に判別する技術です。近年はディープラーニング(深層学習)の飛躍的な進化により認識精度が劇的に向上しており、製造、物流、小売、医療、セキュリティなど、あらゆる産業で導入が進んでいます。

この技術は、単なる「写真の仕分け」にとどまりません。画像全体から「犬」「商品」「不良品」などのカテゴリを判定する画像分類をはじめ、対象物の正確な位置を特定する物体検出、画像内の文字を読み取るOCR(光学文字認識)、通常とは異なる状態を検知する異常検知など、複数の技術領域を包含しています。実際のビジネス現場では、これらの技術を複合的に組み合わせて課題解決にあたるのが一般的です。

人間は過去の経験や知識から視覚情報を自然に理解しますが、コンピューターはそのままでは画像の意味を理解できません。そこで、AIに膨大な画像データを学習させ、色・形・模様・位置関係といった「特徴」を抽出させることで、未知の画像に対しても高精度な識別を可能にしています。

現在、高度なタスクにおいてはディープラーニングが主流となっており、あらかじめ学習を済ませた「事前学習済みモデル」を活用し、効率よく導入や精度向上を図るアプローチも定着しています。

すでに実用化の裾野は広く、製造ラインでの外観検査、小売業の無人レジ、物流拠点での検品作業、防犯カメラによる人物検知、顔認証システム、帳票類の自動データ化など、多岐にわたる現場で稼働しています。

これまで人手と時間をかけていた「目視確認」をAIで自動化できるため、大幅な業務効率化や人手不足の解消に加え、担当者ごとの判断のばらつき(ヒューマンエラー)をなくせる点が最大のメリットです。

さらに近年は、「何が写っているか」を識別する段階から一歩進み、画像の内容を文章で説明する画像キャプション生成や、画像とテキストなど複数の情報を掛け合わせて処理するマルチモーダルAIの活用も急拡大しています。

つまり現在の画像認識は、単なる判別ツールを超え、画像から意味を深く読み取り、高度な業務判断やプロセス自動化の中核を担う「基盤技術」へと進化を遂げているのです。

例えば、防犯の分野では、IoTと組み合わせることで「防犯カメラの映像から人物を割り出す」ことが可能になります。そのため、従来よりも高精度の犯人特定や不審人物の検知を実現しました。

混同されやすい言葉に「画像処理」があります。画像処理は、明るさ補正、ノイズ除去、輪郭強調など、画像を見やすく整えるための処理を指します。

一方で画像認識は、その処理後の画像から「何が写っているか」を判断する工程です。実務では、画像処理が前段階、画像認識が判定段階と考えるとわかりやすいでしょう。

画像認識はディープラーニング(深層学習)の登場で改めて注目を集めましたが、その歴史は意外に古く、基礎となる技術は以前から存在していました。現在では、画像認識には機械学習によるパターン認識が標準的に用いられ、そこにディープラーニングが加わることで、高精度な画像認識が可能になっています。

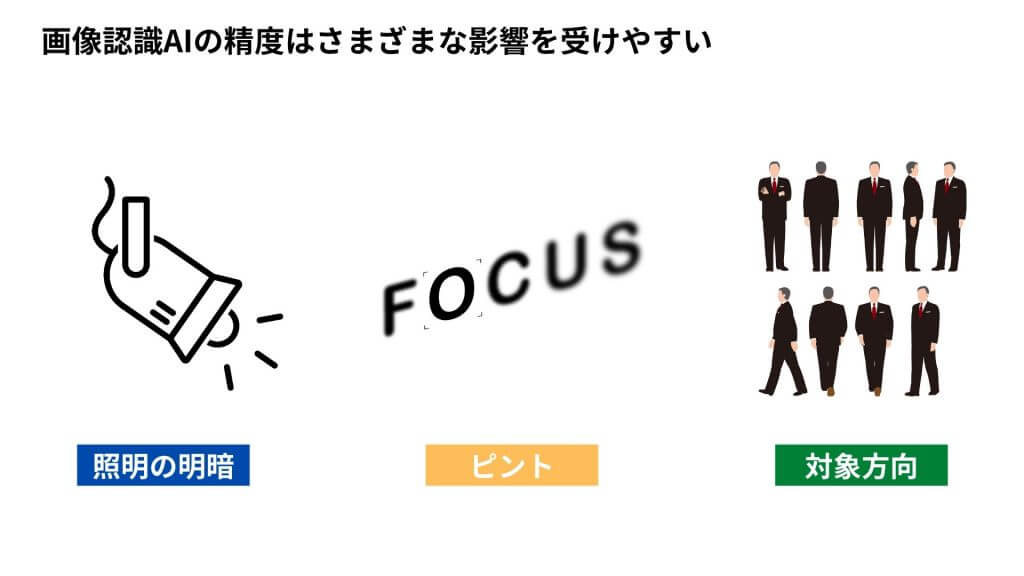

しかし、コンピューターが画像を認識するのは決して簡単なことではありません。照明の明るさ、ピントのずれ、対象物の向きなど、さまざまな影響を受けやすいからです。では、どのような経緯で画像認識の精度は高まってきたのでしょうか。歴史とともに振り返ってみましょう。

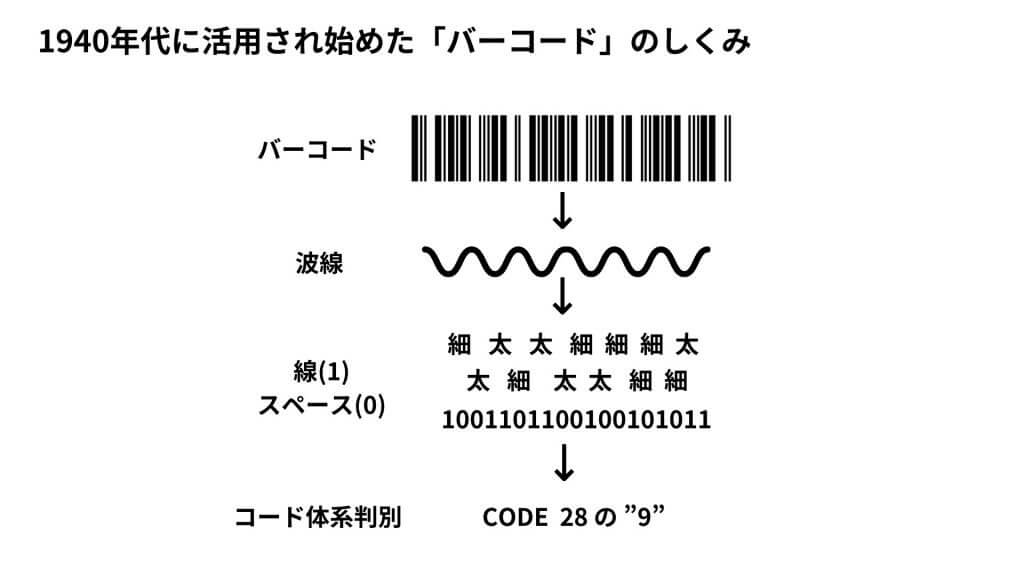

画像認識技術として最も古いのは、1940年代に活用され始めた「バーコード」です。バーコードとは、バーとスペースの組み合わせによって、機械が読み取れるように表現したものです。多くの商品パッケージに記載されています。

そんなバーコードは、バーコードスキャナと呼ばれる光学認識装置を使って、バーコード化された金額等の情報を読み取ります。

バーとスペースで構成されたシンプルなものですが、画像のパターンから情報を読み取っているという点を踏まえれば、立派な画像認識といえるでしょう。

これまでの画像認識では、テンプレートマッチングを使用するのが一般的とされていました。テンプレートマッチングとは、画像に映っている物体の位置を検出する「画像検出」という技術のひとつです。

この方法では、検出したい物体の画像そのものをテンプレートとして、対象画像の一部分との類似性を、その領域をスライドしながら比較していきます。これによって、「対象となる物体が画像内のどこに映っているのか」「いくつ映っているのか」といった情報を抽出することが可能になります。

しかし、この方法では、照明による変化が大きい場合など、テンプレート画像からの変化が激しいケースではどうしても認識率が下がってしまう傾向にあります。

また、認識したい対象物ごとにテンプレートが必要となるという点も、大きな課題でした。

2000年代に入ると、計算機の技術が発展したことで、データの処理速度も大幅に向上していきました。この変化によって、大量の画像データを用いた機械学習による画像認識が実現可能となり、人が手作業でルールやモデルを構築する手法から、機械学習によるパターン認識中心のアプローチへと移行していきました。

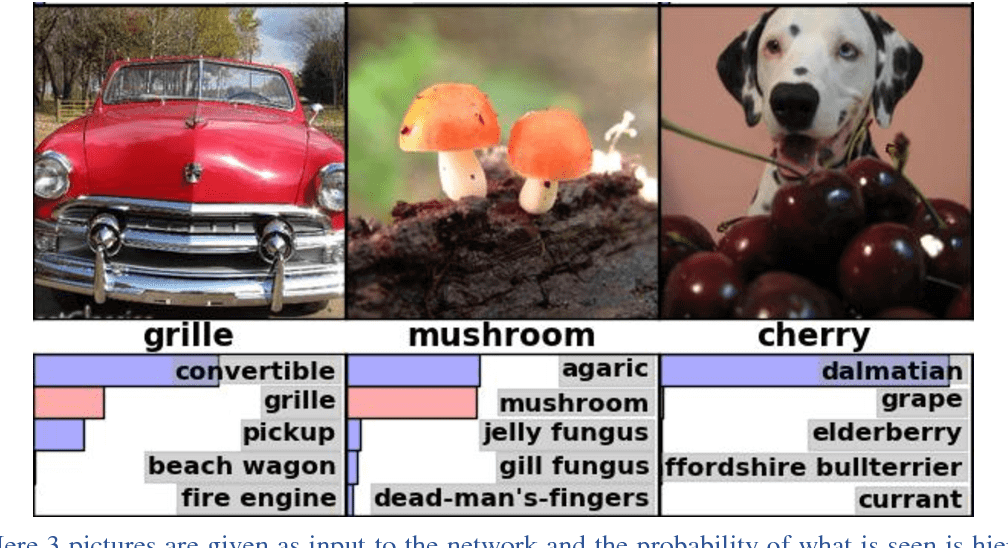

さらに2012年には、ディープラーニングの登場が世界に大きなインパクトを与えました。2010年から2017年まで開催されていた画像認識コンテスト ILSVRC(ImageNet Large Scale Visual Recognition Challenge)において、カナダ・トロント大学のヒントン教授が率いるチームが開発した「AlexNet」がディープラーニングを活用し、2位のエラー率26.2%に対して15.3%を記録しました。これにより、エラー率は約4割削減されたのです。

また、Googleは2012年に、ディープラーニングによってAIが自動的に猫を認識する技術を発表し、大きな注目を集めました。大量のYouTube画像をディープラーニングに学習させたところ、事前に「猫」と教えていないにもかかわらず、AIが自力で猫の顔を見分けられるようになったという実験です。

このように、ディープラーニングは画像認識の分野で大きな成果を上げており、その能力の高さを世界に示しました。

その後、ディープラーニングは画像認識以外の領域にも急速に広がり、そして、2016年にはアルファ碁が登場したことで第三次AIブームを決定づけました。近年では、産業界においてもディープラーニングを活用した画像認識が、製造、医療、小売などさまざまな分野で実用段階に入りつつあります。

画像認識が対象物を判別するプロセスは、基本的に以下の4段階で進みます。

【画像認識が対象物を判別するプロセス】

まず、カメラ映像や画像データを取り込み、AIが正確に解析できるようノイズ除去やサイズ調整といった前処理を施します。次に、画像の中から色・輪郭・模様・位置関係などの重要な特徴を抽出し、あらかじめ学習させたAIモデルと照合することで「それが何であるか」を特定します。

技術計算ソフトウェア大手のMathWorksも解説しているように、実際の開発現場では用途に応じて従来の機械学習とディープラーニング(深層学習)を使い分けます。

しかし、認識対象のバリエーションが多い場合や、環境条件が複雑なタスクになるほど、AI自身が高度な特徴を自動で見つけ出すディープラーニングが有力なアプローチとなります。

画像認識にはさまざまな種類があり、解決したい課題によって適した技術が異なります。以下では、代表的な6つの技術を紹介します。自社の課題に近いものがあれば、該当する活用事例のセクションも合わせてご覧ください。

コンピューター上で行われる画像認識は、人間の脳とは仕組みが異なります。人間のように「視覚」で認識するのではなく、オブジェクトの抽出やピクセルデータの処理といった複雑な処理が必要になるのです。

画像認識は、対象物の形状や色、複雑さなどによって適した技術が異なるため、いくつかの種類に分けられています。

扱う画像データや解決したい課題に応じて、最適な技術を選択することが重要です。では、具体的にどのような種類が存在するのでしょうか。ここからは、画像認識の種類と機能を見ていきましょう。

(参照:ImageNet Classification with Deep Convolutional Neural Networks)

(参照:ImageNet Classification with Deep Convolutional Neural Networks)

物体認識(物体識別)とは、対象の物体と同一の物体が画像内に存在するかどうかを検証する技術のことです。画像に映っている物体のカテゴリを特定するなど、画像に含まれている物体の情報を抽出できます。

この物体認識においては、「物体検出」という技術が重要視されており、物体認識と物体検出はそれぞれ区別して使用されます。

→ 製造業の外観検査、小売業の商品識別、物流の検品作業などで活用されています。「製品の種類を自動で判別したい」「正しい商品かどうかを確認したい」という課題をお持ちの方におすすめの技術です。

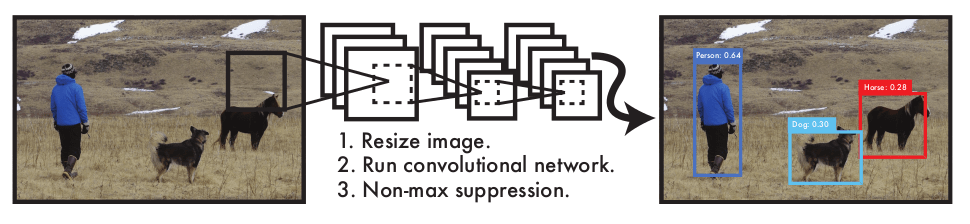

(参照:You Only Look Once: Unified, Real-Time Object Detection)

(参照:You Only Look Once: Unified, Real-Time Object Detection)

物体検出とは、画像内に含まれる対象の物体の位置を検出するための技術です。物体認識とは実行方法が異なりますが、対象となる物体の特徴を抽出する際に、その物体の「位置」も重要になるため、物体認識と併用されるケースが多いです。

→ 自動運転の障害物検知、監視カメラでの不審者検出、工場ラインでの位置ずれ検査などで活用されています。「どこに何があるかを把握したい」という課題に適しています。

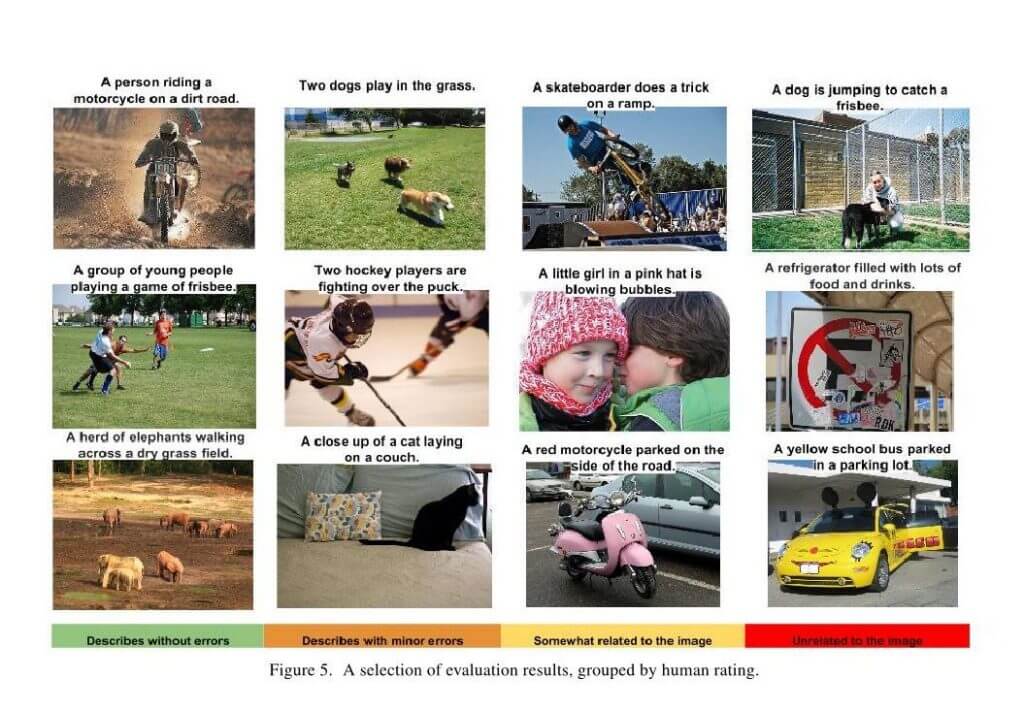

(参照:Show and Tell: A Neural Image Caption Generator)

(参照:Show and Tell: A Neural Image Caption Generator)

画像キャプション生成とは、入力した画像内に何が映っていて、映るものがどのような状況かを判別し説明文を出力するものです。CNNと自然言語処理(RNN)を組み合わせたもので、Microsoftが開発する視覚障碍者向けのカメラアプリ「Seeing AI」などで活用されています。

アクセシビリティ支援や画像の自動タグ付け、コンテンツ管理などで活用されており「画像の内容をテキストで説明したい」という場面に適しています。

セグメンテーションとは、画像のピクセル(画素)ごとに「どの物体クラスに属するか」という基準で分類していくタスクを指します。画像全体を対象にする「セマンティックセグメンテーション」、物体検出した領域を対象にする「インスタンスセグメンテーション」、画像全体を対象に個々の物体はそれぞれ分離して背景などはひとまとめにする「パノプティックセグメンテーション」などさまざまな手法があります。

医療画像診断(腫瘍の範囲特定など)や自動運転の道路認識、農業の作物生育分析などで活用されており、「画像内の特定領域を正確に切り分けたい」という高精度な分析が必要な場面に適しています。

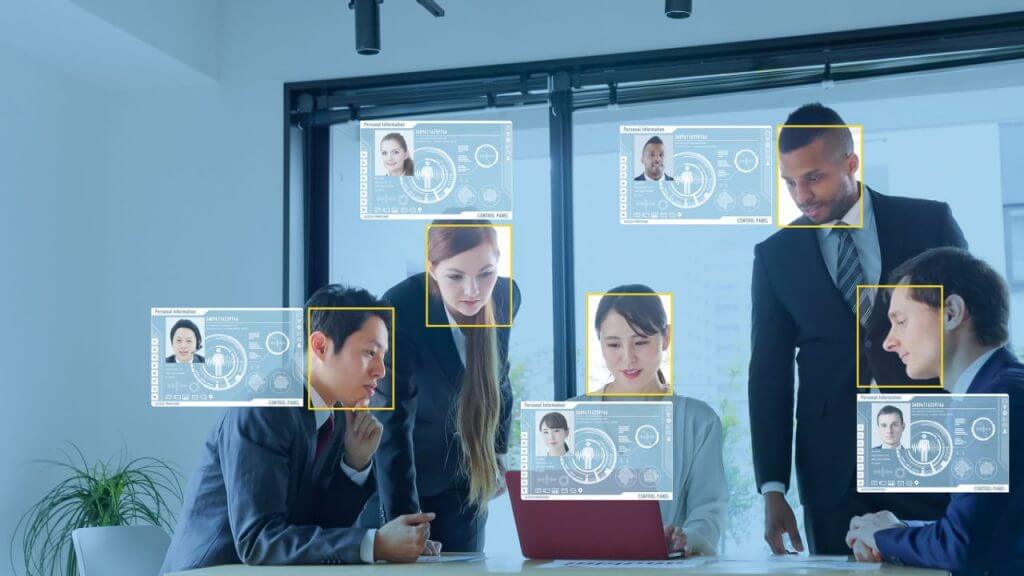

顔認識(顔認証)とは、人間の顔画像から目立つ特徴を抽出していく技術です。この技術を利用することによって、顔の識別・似た顔の検索・顔のグループ化などができます。

出入国管理や入退室管理、本人確認、マーケティングでの属性分析などで活用されており、「人物の特定や認証を自動化したい」「来店客の属性を把握したい」という課題に適しています。

また、最近では人間の表情から感情を読み取る「感情認識」の研究も進行中です。

文字認識(OCR)は、紙に書かれている手書きの文字や印刷された文字などを判別する技術で、画像内のテキストを抽出できるようになります。文字認識の技術は年々発展しており、最近では翻訳技術と組み合わせたシステムが登場しています。

請求書・帳票の自動読み取りや名刺管理、翻訳アプリなどで活用されています。「紙の書類をデータ化したい」「手書き文字を読み取りたい」という業務効率化に適しています。

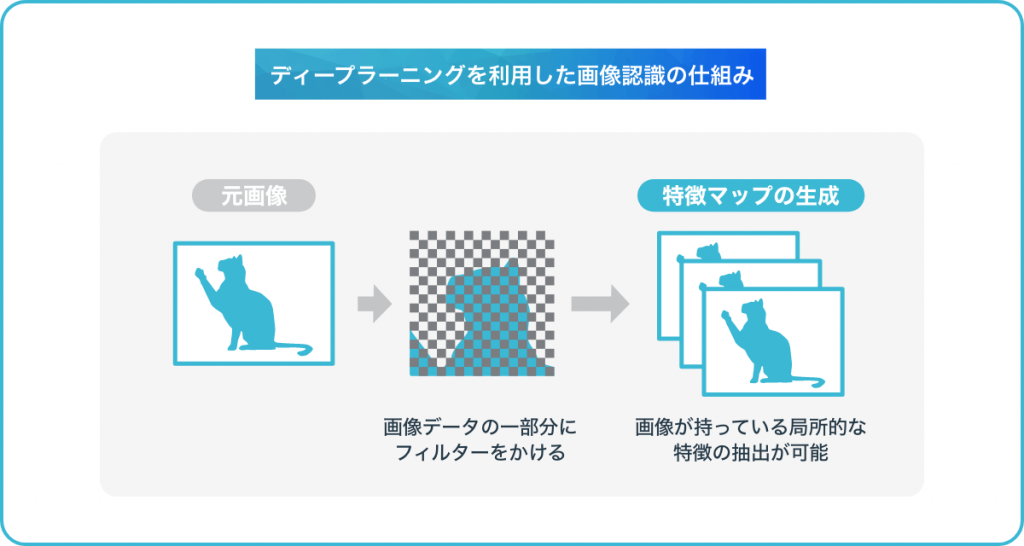

現在の画像認識において中心的な役割を果たしているのが、ディープラーニング(深層学習)を用いたAIモデルです。その代表格であるCNN(畳み込みニューラルネットワーク)は、画像の一部に「フィルター」をかけながらスキャンし、対象物の形や模様、位置関係といった特徴を自動的に抽出・学習していく仕組みを持っています。

長らく画像認識といえばCNNが主流でしたが、近年では自然言語処理の分野から派生したVision Transformer(ViT)やSwin Transformerなど、画像全体の大局的な文脈を捉えるのに長けたモデルも台頭しています。そのため、現在は「画像認識=CNN」という単一の技術ではなく、扱うデータ量や解決したいタスクに応じて複数のモデルを使い分けるのが一般的です。

AIの学習プロセスでは、大量の画像データに「正解ラベル」を付与し、AIの予測結果と実際の正解を比較して内部の計算ルール(重み)を微調整する作業を繰り返します。近年はゼロからすべてを学習させるのではなく、膨大なデータで基礎学習を済ませた「事前学習済みモデル」をベースにし、少量の自社データで効率よく高精度なAIを構築する手法が定着しています。

なお、低画質の画像を鮮明にする「超解像」などの画像改善領域においては、従来のGAN(敵対的生成ネットワーク)に加え、昨今は拡散モデル(Diffusion Model)を活用した最先端の手法も大きく注目を集めています。

画像認識をはじめとする機械学習の開発現場では、現在もPython(パイソン)が最もスタンダードなプログラミング言語として広く利用されています。Pythonは文法がシンプルで分かりやすく、AI開発や画像処理に特化したライブラリ(拡張プログラム)が豊富に揃っているため、研究開発からビジネスの実務導入まで幅広く対応できるのが最大の強みです。

既存のライブラリを活用することによって、自分が作りたいプログラムを作成できるのは大きなメリットといえるでしょう。また、Pythonによって開発されたアプリケーションの代表例としては、YouTube、Instagram、Dropbox、Evernoteなどが挙げられます。

実際の開発では、画像サイズの調整やノイズ除去といった前処理にOpenCVを用い、AIモデルの構築・学習にはPyTorchやTensorFlowといった世界的なフレームワークを組み合わせる構成が王道となっています。

さらに近年は、これらの環境向けに「事前学習済みモデル」や実践的なチュートリアルが多数公開されています。そのため、複雑なアルゴリズムをゼロから設計しなくても、自社の課題に合わせた高度な画像認識システムを、比較的容易にプロトタイピング(試作)できるようになっています。

すでに多様な業界で実用化が進む画像認識技術について、AIがどのように現場の課題を解決しているのか、代表的な5つの事例をご紹介します。

画像認識の代表的な活用例が、製造ラインにおける外観検査です。製品の傷や欠陥、組み付けミスなどを自動検出できるため、検査品質の平準化と大幅な省人化を実現します。

【具体事例】

キューピーでは、良品・不良品の判別が難しい「食品原料(ダイス状のポテトなど)の検査」にAI画像認識を導入し、熟練作業員の負担軽減に成功しています。また、Google Cloudの「Visual Inspection AI」のように、工場向けに最適化された専用ソリューションも広く普及しています。

レントゲンやCT、MRIなどの医用画像から、病変が疑われる異常部位を検出する用途です。医師の最終判断を置き換えるものではありませんが、見落としの防止や読影作業の補助として極めて高い価値を持ちます。

【具体事例】

富士フイルムの医療AI技術「REiLI(レイリ)」や、エルピクセルの画像診断支援AI「EIRL(エイル)」などが実際の医療現場に導入されており、医師の強力なパートナーとして診断の迅速化・高精度化に貢献しています。

バーコードやQRコードの読み取りから進化し、現在では棚の商品認識、入出庫管理、さらには店舗の無人化など、物流・小売業界の自動化にも欠かせない技術です。

【具体事例】

JR東日本発のベンチャーであるTOUCH TO GOが展開する無人決済店舗では、天井のカメラが「来店客」と「手に取った商品」をリアルタイムで画像認識し、レジでの完全スルー決済(自動精算)を実現しています。

防犯カメラの映像を解析し、不審者や車両の検知、危険行動、立ち入り禁止エリアへの侵入を自動で検出する用途です。Google Cloudの「Video Intelligence API」などを用いて、シーンの理解や人物の追跡を行うことも可能です。

【具体事例】

アースアイズが提供するAIカメラは、来店客の不審な動き(キョロキョロする、死角に入るなど)を骨格の動きから検知して従業員のスマホに通知し、店舗の万引き被害を未然に防ぐ成果を上げています。

AI-OCR(光学文字認識)と文書理解AIを組み合わせ、手書きの請求書や申込書などを自動でデータ化します。近年は文字をテキスト化するだけでなく、意味を理解して項目単位で抽出・分類する高度な処理へと進化しています。

【具体事例】

AI insideの「DX Suite」などのAI-OCRツールは、多くの自治体や金融機関、一般企業で導入されており、これまで手入力にかかっていた膨大な事務作業時間を劇的に削減しています。

画像認識を導入する最大のメリットは、「目視作業の自動化」による圧倒的な業務効率化です。人手では膨大な時間がかかる確認作業を瞬時に処理でき、疲労を知らないため24時間365日の連続稼働にも適しています。

また、担当者のスキルや体調による「判断のばらつき(ヒューマンエラー)」を排除し、検査や監視の品質を高いレベルで平準化できる点も強力です。

さらに、継続的に処理・蓄積された大量の画像データは、現場のボトルネック発見やマーケティング分析などにも応用でき、企業のデータドリブンな業務改善の基盤となります。

画像認識モデルを構築する際は、自社開発か外部委託かにかかわらず、基本的な流れは共通しています。重要なのは、いきなり複雑なモデル開発に進むのではなく、目的の整理、データ準備、モデル選定、検証、改善の順に進めることです。

近年は、ゼロからモデルを作るよりも、事前学習済みモデルやクラウドサービスを活用して短期間で検証を始める方法が一般的になっています。

画像認識の精度は、学習に使うデータの質と量に大きく左右されます。まずは対象業務に合った画像を集めて不要な画像を除外し、必要に応じてラベル付けを行います。

重要なのは単に枚数を増やすことではなく、実際の現場で起こりうる条件の違いを反映したデータを揃えることです。

例えば、照明・角度・背景・汚れ・欠損の有無など、運用時に近い条件を含めることが精度向上につながります。

転移学習を使えば、少ないデータでも一定の性能を得やすいため、最初から大量データを前提にしすぎないことも大切です。

【ポイント】データ収集の目安 :ディープラーニングで学習する場合、1クラスにつき5,000件程度のデータがあればまずまずのパフォーマンスが発揮されますが、人間レベルの精度を求めるとすると約1,000万件という大規模なデータが必要です。

ただし、後述する転移学習を活用すれば、より少ないデータでも高い精度を実現できる可能性があります。

また、画像に「これは何か」を示すラベルを付ける「アノテーション」作業が必要ですが、AIプロジェクトに費やされる時間の約80%がこのデータ準備作業に充てられるとも言われており、時間とコストがかかるため、外部サービスの活用も検討しましょう。

次に用途に合ったモデルを選びます。

画像分類であれば ResNet などの事前学習済みモデル、より新しい選択肢としては Vision Transformer 系のモデルも利用されています。

現在は、PyTorch の TorchVision などで学習済み重みを利用できるため、ゼロからネットワークを設計するより、既存モデルをベースに追加学習する方法が現実的です。 TensorFlow でも転移学習やファインチューニングが公式に案内されています。

【ポイント】モデル選定のコツ: ResNet、VGGなど、すでに高い性能が実証されている学習済みモデルを活用し、自社のデータで追加学習させる「転移学習」という手法があります。事前学習済みのモデルから知識を転移することで、ラベル付けされたデータが少なくても学習を行うことができます。

モデルを選定した後は、学習用データと評価用データに分けて学習を行い、精度を検証します。重要なのは、単に正答率を見るだけでなく、どのパターンで誤認識が起きるかを確認することです。

現場で使う画像認識では、全体精度だけでなく、見逃しや誤検知がどの程度発生するかが運用上の重要な判断材料になります。PoCの段階では、小さな範囲で試しながら、業務に必要な精度を満たせるかを見極める進め方が適しています。

初回の学習だけで十分な精度が出るとは限らないため、検証結果をもとにデータの見直しや再学習を行います。たとえば、誤認識が多い条件の画像を追加したり、ラベルの付け方を見直したりすることで、モデルの性能を改善できます。

現在は、事前学習済みモデルを活用したファインチューニングが一般的であり、改善サイクルを回しやすい点も特徴です。

自社でフルスクラッチ開発する以外に、用途に応じて既製のAPIやクラウドサービスを利用する方法もあります。

OCRや一般的な画像分類・物体検出であれば事前学習済みAPI、製造業の外観検査であれば専用サービスを使うほうが、短期間で効果検証しやすいケースがあります。まずは小規模に試し、必要に応じて自社専用モデルへ発展させる進め方が現実的です。

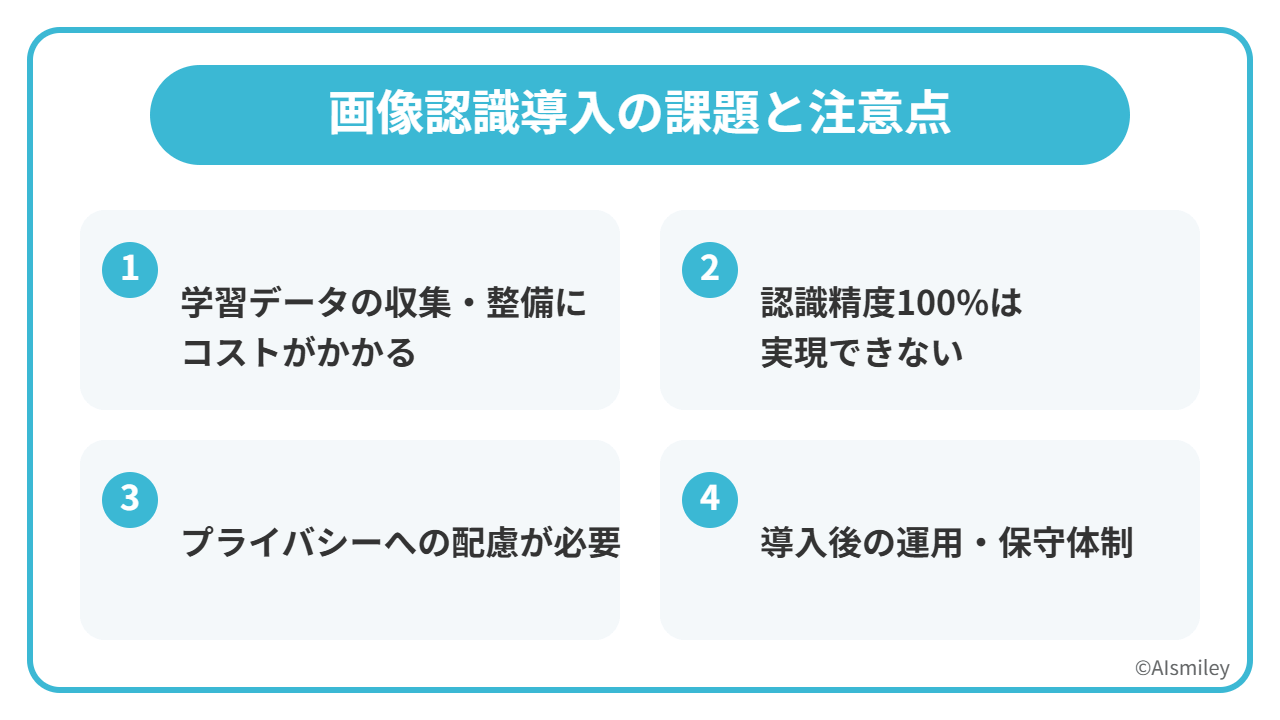

画像認識モデルの導入を検討する際には、期待できる効果だけでなく、事前に把握しておくべき課題もあります。ここでは、導入前に知っておきたい主な課題と、その対策について解説します。

画像認識モデルの精度は、学習に使用するデータの質と量に大きく依存します。十分な量の画像データを集め、それぞれにラベル(正解情報)を付ける作業は、想像以上に時間とコストがかかります。

近年は、事前学習済みモデルの活用や、必要に応じて合成データ(Synthetic Data)で不足データを補う方法も使われています。

過去の検査画像や製品写真など、社内にある既存データを活用できないか確認しましょう。

あわせて、転移学習や事前学習済みモデルを使えば、少ないデータでも精度を確保しやすくなります。ラベル付けの負荷が大きい場合は、外部のアノテーションサービスの利用も有効です。

どれだけ高性能な画像認識モデルでも、認識精度100%を達成することは現実的ではありません。照明条件の変化、対象物の汚れや破損、想定外の角度など、さまざまな要因で誤認識が発生する可能性があります。

特に顔認識のような用途では、NISTもアルゴリズム間の性能差や属性ごとの精度差を継続的に評価しています。

画像認識モデルの導入前に「どの程度の精度なら業務で許容できるか」を決めておきましょう。

誤認識が業務上大きな影響を与える場面では、人による確認フローを残す設計が適しています。また、誤検知や見逃しが起きた場合の対応手順も、事前に決めておく必要があります。

顔認識や人物検知など、人を対象とした画像認識では、プライバシーへの配慮が不可欠です。個人情報保護法や業界ガイドラインに沿った運用が求められます。

日本の個人情報保護委員会は、カメラ画像や顔特徴データの利用について継続的に注意喚起を行っており、防犯目的で取得したデータをマーケティングなど別目的で利用する場合には、あらかじめ本人同意が必要となるケースがあると示しています。

撮影の目的や利用範囲を事前に明示し、保存期間、アクセス権限、削除方法を定めておきましょう。

必要以上にデータを集めず、利用目的の変更がある場合は法令やガイドラインに沿った対応を行うことが重要です。顔認識を含む用途では、技術面だけでなく運用ルールまで含めて設計する必要があります。

画像認識モデルは「導入して終わり」ではありません。運用開始後も、精度のモニタリング、モデルの再学習、システムのメンテナンスなど、継続的な対応が必要です。

実運用では、学習時と運用時でデータの傾向が変わるデータドリフトや、時間経過によるモデル劣化が起こります。Google CloudやAWSでも、モデル監視や品質監視を継続することの重要性が示されています。

導入前に、誰が精度を確認し、どのタイミングで再学習するのかを決めておきましょう。月次や四半期ごとに精度を評価する仕組みを設けるほか、外部サービスを使う場合は、アップデート頻度や障害時のサポート体制も確認しておくと安心です。

画像認識は単なる対象物の「分類・検出」にとどまらず、画像の意味を深く理解して「文章で説明する」、あるいは「画像とテキストを横断して検索する」といった高度な段階へと進化したことです。

例えば、 Google Cloud では、画像・テキスト・動画の組み合わせをベクトル化する「マルチモーダル埋め込み」技術を提供しており、これによって、より複雑な画像分類や高度なコンテンツモデレーション(不適切コンテンツの監視)などが可能になると説明しています。

また、Googleの「Gemma 3n」のように、計算資源が限られた低リソース環境でもスムーズに動作する軽量なマルチモーダル対応モデルが登場したことも大きな変化です。

これにより、画像認識はクラウド上だけでなく、スマートフォンや工場設備といった端末・現場側(エッジAI)での活用が格段にしやすくなりました。さらに NVIDIA も2025年の最新動向として、「VLM(視覚言語モデル)がロボティクスや自動運転の分野で極めて重要な役割を担い始めている」と言及しています。

つまり、これからの画像認識は、単に「何が写っているかを当てる」だけの技術ではありません。画像内の文脈を「理解・説明」し、最終的なビジネスの「意思決定や自律制御」へと直結させる、次世代のインフラへと進化を遂げていると捉えるべきです。

物体認識や文字認識、植物判定、顔画像を使ったシミュレーションなど、画像認識を使ったフリーソフトや顔認証を用いた無料アプリなどが身近になっています。

スマートフォン1台で試せるものも多く、画像認識の活用イメージをつかむ入り口として適しています。

Google レンズは、スマートフォンのカメラや保存済みの画像を使って、写っている物の検索や文字の読み取り、翻訳、商品検索、植物・動物の判別などができる機能です。

日常生活の中で幅広く活用できるため、画像認識を手軽に体験したい方に適した無料ツールです。

Pl@ntNet は、植物の写真を撮影することで、その種類を調べられるアプリです。身近な草花や樹木を簡単に判別できるため、画像認識の仕組みを実感しやすいでしょう。

「画像認識ってどんなものか、まずは体験してみたい」という方に向けて、無料で試せるアプリを紹介します。

画像認識は私たちにとって身近な存在になりつつあり、最近では画像認識を使ったフリーソフトや顔認証を用いた無料アプリなどもリリースされています。その一つとして挙げられるのが、「AI Stylist」というアプリです。

AI Stylistは、ヘアサロン「Hair&Make EARTH」を展開している株式会社アースホールディングスが提供しているAI搭載型のアプリです。この「AI Stylist」は、画像認識技術を用いることで、ユーザーに最適な髪型をアプリが提案してくれるというものです。その使い方は、ユーザーはヘアスタイルなどを選択して自分の顔写真をスマートフォンで撮るだけなので、とても簡単です。

2020年3月にiOS版がリリースされ、2020年8月にはAndroid版もリリースされました。2021年にはヘアスタイルを試せるシミュレーション機能も追加され、2023年1月時点で累計100万ダウンロードを突破しています。髪型シミュレーションアプリのおすすめランキングでも常に上位に入るなど、多くのユーザーに利用されています。2020年3月にiOS版が先立ってリリースされ、すでにダウンロード数が5万を突破するなど、多くの注目を集めています。2020年8月にはAndroid版もリリースされたため、今後さらに多くのユーザーが活用するようになるのではないでしょうか。

この「AI Stylist」は髪型の提案だけではなく、似ている芸能人を判定する機能なども備わっています。比較対象はモデルや歌手、タレントなどで、男性557人、女性949人のデータが用意されているそうです。

今後は、これらの機能に加え、髪型を試すことができる「ヘアスタイルシミュレーション」という機能も実装される予定だといいます。

まずは無料で画像認識技術を体験してみてはいかがでしょうか。

最近ではさまざまな分野で画像認識が活用されていますが、具体的にどのような場所で画像認識が活用されているのでしょうか。ここからは、最新の画像認識の活用事例についてご紹介していきます。

製造業の方 → 「外観検査で部品の不良品対策」

物流業の方 → 「物流会社の検品・入庫作業を効率化」

小売業の方 → 「画像認識を活用した無人レジ」「人数カウントして密を回避」

セキュリティ担当の方 → 「画像認識で監視カメラを管理」

マーケティング担当の方 → 「SNSマーケティングにも画像認識を応用」「属性分析や行動解析」

多言語対応が必要な観光業、翻訳・通訳業、海外取引のある企業向けの活用事例です。

Google翻訳をはじめとする機械翻訳は、多くの方が一度は利用したことがあるのではないでしょうか。この機械翻訳は、自然言語処理によってできることのひとつです。「自然言語」とは、私たちが日常的な会話で使用している言語のことだと捉えていただければ問題ありません。

ちなみに、自然言語と相反する言語としては「コンピューター言語」というものがあり、「1+2+5」といったような一通りの解釈しか存在しないようなものは、コンピューター言語に該当します。

一方の自然言語には、複数の解釈ができるケースも少なくありません。例えば、「A君は自転車で帰宅中のB君を追いかけた」という文章があったとします。この場合、「A君は自転車に乗り、帰宅中のB君を追いかけた(自転車に乗っているのはA君)」という解釈もできますし、「A君は、自転車に乗って帰宅中のB君を追いかけた(自転車に乗っているのはB君)」という解釈もできます。

このように、自然言語は複数の解釈ができることから、これまでは適切に処理することが難しいとされてきました。

しかし、近年はAI(人工知能)の技術が発展したことにより、非常に高い精度で自然言語処理を行えるようになってきています。最近では、音声合成や文字認識と組み合わせたサービスも増えています。

例えば、「あなたは将来、進歩した自然言語処理の技術を実感することになるでしょう」という日本語を英語に訳した場合、「In the future, you will experience advanced natural language processing techniques.」となります。

しかし、この「In the future, you will experience advanced natural language processing techniques.」という文章をもう一度和訳すると、「将来的には、高度な自然言語処理技術が体験できます。」という文章になるのです。

私たち日本人は主語を省略することが多く、一般的な会話の中で「あなたは~するでしょう」という言い方はあまりしません。Google翻訳はそれを踏まえた上で、対象言語においてより自然な表現に近い言葉へ置き換えることができます。これは、AIの技術によって的確な文脈解析と意味解析が行われ、自然言語処理に基づく高精度な翻訳が可能になったためです。

また、Googleの翻訳アプリには、カメラを文章にかざすだけで別の言語に自動翻訳する機能が搭載されています。これも画像認識技術によって実現されたものです。こうした技術の進化により、言語の壁は今後ますます低くなっていくでしょう。

ECサイトや小売業では、写真から類似商品を特定する画像検索が検索体験(UX)を劇的に向上させています。

「商品名がわからない」というユーザーの課題を解決し、購買意欲を逃しません。さらに近年は、画像とテキストを掛け合わせてより直感的に探せる「マルチモーダル検索」の導入も進んでいます。

画像認識は、PC操作の自動化(RPA)においても重要な役割を果たしています。画面上の特定のボタンやアイコン、ポップアップメッセージなどをAIが視覚的に検知し、クリックやテキスト入力といった操作を自動実行する仕組みです。

システム構造上、UI要素(内部データ)を直接取得できないレガシーシステムや仮想環境など、「画面の見た目」でしか判別できない特殊なソフトウェアでも柔軟に自動化できる点が最大の強みです。実際に、UiPathなどの主要ツールでは「画像アクティビティ」として標準搭載されています。

現在の業務自動化では、Power Automate for desktopやUiPathを用い、より確実性の高い「UI要素認識」を軸としつつ、それでは対応しきれない難所を画像認識でカバーする手法が一般的です。

画像認識はすべてのPC作業を代替する万能ツールというよりも、従来の自動化では突破できない壁を越えるための「強力な補完手段」として実務に定着しています。

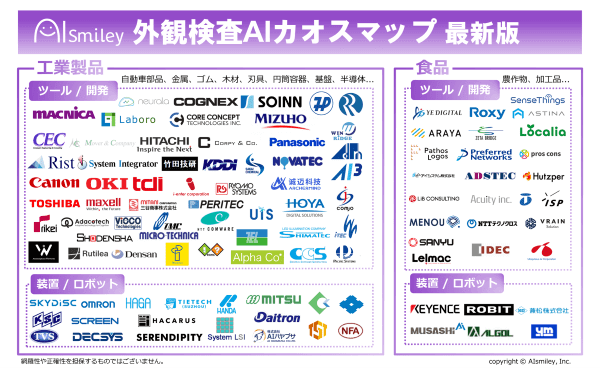

外観検査AIカオスマップを公開!製造業で導入進む104サービスをまとめました

外観検査AIカオスマップを公開!製造業で導入進む104サービスをまとめました

→製造業の品質管理担当者、検査工程の自動化を検討している方向けの活用事例です。

目視検査の人手不足解消、検査精度の向上、検査スピードの向上といった課題に対応できます。画像認識技術を活用すれば、製造業などの外観検査の自動化や高精度化が可能になり、より高い精度で部品の品質を維持できるようになります。

画像認識を用いた外観検査の仕組みは、以下の通りです。

検査対象が静止状態の場合には写真データを活用し、検査対象が動いている場合には撮影データを活用します。取得する画像の精度は、自動検査の精度にも大きな影響を与えるため、検査対象として相応しい「高精度の画像」を撮影することが重要です。

検査対象に合わせて適切な画像処理を施していきます。目的に合わせて適切な情報を抽出できるよう、画像データをフィルター処理するのが一般的です。さまざまな処理方法が存在しますが、代表的なものとしては「ノイズ除去」「明るさ調整」「エッジ強調」「コントラスト調整」などが挙げられます。

取得した画像をもとに、検査対象のどこに、どのような異常項目が存在しているのかを自動で特定していきます。一般的な外観検査システムでは、「色」「周囲との色の違い」「大きさ」「形」といった判定要素をもとに、検査対象項目に応じた判定ロジックを用いて特定していくという流れです。

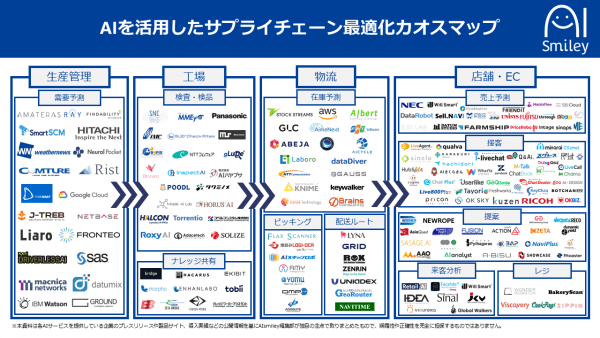

SCM改革!AIを活用したサプライチェーン最適化カオスマップ!小売・物流・製造業必見!

SCM改革!AIを活用したサプライチェーン最適化カオスマップ!小売・物流・製造業必見!

物流業・倉庫業の方、EC事業者で出荷作業の効率化を検討している方向けの活用事例です。検品時間の短縮、ヒューマンエラーの削減、人手不足の解消といった課題に対応できます。

物流には、物を移動させる業務だけでなく、そのプロセスとなる包装や保管といった業務も含まれます。

そのため、倉庫への入庫作業なども物流に該当します。

その倉庫への入庫作業においては、これまで人の目で商品のパッケージやタグなどを確認しなければならず、さらにその商品名や型番などを倉庫管理システムに入力する作業も、人が行っていました。

しかし、最近ではAIの画像認識技術を活用したシステムが積極的に導入され始めており、この一連の業務の大幅な効率化を実現しました。具体的には、人間による目視とシステム入力作業を自動化させることで、検品業務を半分以下の時間で実施できるようになりました。

→ セキュリティ担当者、施設管理者、イベント運営者向けの活用事例です。不審者の早期発見、監視業務の効率化、インシデント対応の迅速化といった課題に対応できます。

画像認識技術は、セキュリティ強化という側面でも積極的に活用され始めています。その具体的な事例としては、以下のようなものが挙げられます。

車両種別の判別では、AIを活用し、防犯カメラに写っている自動車の画像から車種を割り出していきます。

各メーカーの車の画像データをAIに学習させることで、より高い精度での判別が可能になりました。画像認識モデルの技術の進化により、多少画像が不鮮明であっても車のタイプや車種、年式などを判別できるようになっています。これは、画像認識モデルの進化によるメリットのひとつといえるでしょう。

大規模なイベントなどでは、どうしても人の目が届かないエリアが出てきてしまいます。そのため、画像認識モデルを搭載した防犯カメラを活用してイベント会場全体を監視することで、イベントでの不審点の抽出を高精度で実行できます。

実際、2019年には警視庁による実証実験も行われており、会場内外に設置された防犯カメラの映像から、不審と思われる点を自動的に検知する検証が進められました。この実験は、コンサートやスポーツ大会、会議といった大規模イベントを想定したもので、過去に欧米で発生したテロのデータも活用しながら、テロリストが取り得る行動特性をAIに学習させる内容です。

最近ではAIの処理をクラウドではなくデバイスで行うエッジAIの活用も進んでいます。

→ 小売業・商業施設の運営者、イベント会場の管理者向けの活用事例です。来客数の把握、混雑予測、店舗オペレーションの最適化といった課題に対応できます。

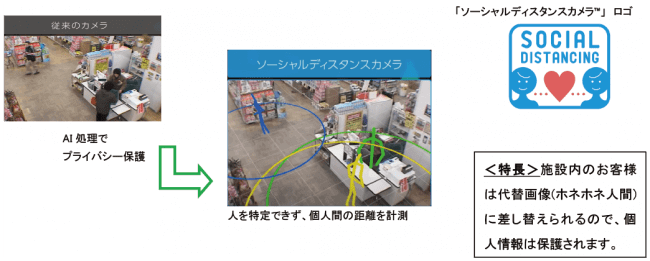

昨今は新型コロナウイルスの感染拡大に伴い、ソーシャルディスタンスが重視されるようになりました。そのような中で、いわゆる「3密」を避けるための手段に画像認識が有効活用され始めています。画像認識技術は、施設内の人数カウントや混雑状況の可視化にも活用されています。その事例として挙げられるのが、アースアイズ株式会社(本社:東京都港区)と日商エレクトロニクス株式会社(本社:東京都千代田区)が販売している「ソーシャルディスタンスカメラ™」です。

この「ソーシャルディスタンスカメラ™」は、AIカメラの3D空間認識技術(画像認識技術)によって施設内外の人数を認識したり、人と人の距離を認識したりして、混雑レベルを可視化します。「ソーシャルディスタンスカメラ™」が導入されている施設の利用者(顧客)は、スマホなどから混雑レベルをチェックできます。施設内の混雑状況を把握した上で訪問するかどうかを判断できるため、店舗側だけでなく施設の利用者にとっても非常に大きなメリットがあるといえるでしょう。

このような混雑可視化技術は、イベント会場での来場者管理、商業施設での来客分析、交通機関での混雑予測など、さまざまな場面で活用されています。タイムリーに混雑状況を把握できる仕組みは、顧客体験の向上や運営効率化に大きく貢献しています。

画像認識は、属性分析や行動解析の分野でも活用されています。店舗や商業施設では、カメラ映像をもとに来店人数や滞在傾向、導線、商品棚やサイネージの視認状況などを把握し、売り場づくりや接客改善に役立てられるようになりました。勘や経験だけに頼らず、実際の来店行動データをもとに店舗運営を見直すことが可能です。

どの売り場で立ち止まる人が多いか、どの時間帯に混雑しやすいか、どの什器や販促物が見られているかといった傾向を可視化することで、レイアウトの改善や販促施策の最適化につなげられます。

画像認識は、顧客理解を深めるだけでなく、店舗開発や売場改善の精度向上にも役立つ技術です。

小売業における深刻な人手不足や店舗運営の効率化を背景に、画像認識を活用した「無人レジ」や「レジレス店舗」の導入が加速しています。現在のシステムは、単にカメラ映像で商品を判別するだけではありません。高度なコンピュータービジョンや重量センサー、RFIDなどを複合的に組み合わせ、顧客が手に取った商品を極めて正確に把握する仕組みが主流となっています。

顧客はスキャンの手間から解放され、店舗側もレジ業務の省人化と待ち時間の大幅な短縮を実現できます。

さらに画像認識の応用範囲は決済にとどまらず、棚の欠品検知や商品陳列の乱れの確認、来店客の動線把握など、店舗運営全体の最適化にも貢献しています。実際にローソンでも近年、画像解析AIを用いて陳列棚の欠品を自動検知する実証実験が進められています。

このように、小売分野における画像認識は、単なる「レジの無人化」という枠を超え、在庫管理や精緻な棚分析へと活用が広がっています。最初から完全な無人店舗を目指すのではなく、自社の課題に合わせて効果の出やすい業務から段階的に自動化を進めていくアプローチが、最も現実的な導入戦略といえるでしょう。

ローソンの他にも画像認識を活用したAIレジの普及が進んでいます。

自動運転や先進運転支援システム(ADAS)において、画像認識は「車の目」として歩行者、他車両、標識、車線などを瞬時に検知し、安全な走行判断を下す中核技術です。

自動運転技術は決して完璧なものではなく、死亡事故を起こした事例も存在します。しかし、人間による運転と比べれば、はるかに安全なものになっているのです。

運転席に座った状態の人間の視野にはいくつかの死角が存在するため、その部分を確実に把握することはできません。もちろんドアミラーやバックミラーを使ってある程度の死角を解消することはできますが、それでも視認できない部分が多数あります。

では、完全には見えていない部分があるにも関わらず、なぜ大半の人は自動車を走らせることができているのでしょうか。それは、「その場所が死角になる前に『なにもないこと』を把握(記憶)しているから」に他なりません。つまり、若干ではあるものの、過去の情報を頼りに運転しているということです。

自動運転車は、センサーや画像認識AIなどによって自動車周辺の情報をリアルタイムに把握しながら走行します。自動車周辺に障害物が存在しないかどうか、いわばリアルタイムで目視しながら走行しているわけです。

現在はカメラ画像だけでなく、各種センサーと高度に連携して周囲環境を立体的に把握するのが一般的であり、画像認識の最も高度でミッションクリティカルな応用分野といえます。

人間は見ている方向以外の視覚情報を拾うことはできませんが、自動運転車はセンサーや画像認識によって全方向の視覚情報を拾うことができるのです。

SNSマーケティングの領域でも画像認識の活用が本格化しています。従来のSNS分析は投稿文やハッシュタグなど「テキスト主体」でしたが、現在は画像や動画に映り込むロゴ、商品、背景といった「ビジュアル情報」も高度な解析対象となりました。これにより、テキストには現れないリアルな利用シーンや潜在的な関心を把握できます。

例えば、「自社商品がどんな場面で使われているか」「競合商品と一緒に写っていないか」「ロゴの視覚的な露出度はどの程度か」といった深い分析が可能です。ユーザーの文脈を映し出す視覚データを活用することで、広告クリエイティブの改善や、より精緻なターゲティングに直結させることができます。

オルビスでは、AIを活用して現在の肌状態や生活習慣を分析し、今後の肌変化を踏まえたスキンケア提案を行う取り組みを展開しています。従来は「AI未来肌シミュレーション」として提供されていた機能があり、現在はその仕組みを活かしながら、アプリ内の肌分析サービス「肌カ.ル.テ」に発展しています。

この仕組みでは、顔画像やカウンセリング情報をもとに肌状態を分析し、将来の肌悩みの傾向を予測したうえで、一人ひとりに合ったお手入れ方法を提案します。

フューチャーアーキテクトの事例紹介によれば、画像認識やセンシング技術を組み合わせ、肌スコアの測定や将来のしみ・毛穴・しわ・たるみなどの変化予測を支えるAIエンジンが開発されています。

画像認識は、今後さらに多くの業界で重要性を高めていくと考えられます。これまでの画像認識は、「画像に何が写っているか」を分類・検出する用途が中心でしたが、現在はその先の段階に進んでいます。たとえば、画像の内容を文章で説明したり、画像とテキストを組み合わせて検索したり、映像の状況を理解して判断支援につなげたりと、活用範囲は大きく広がっています。Google Cloud は、マルチモーダルAIが画像・動画・テキストなど複数の情報を横断して扱えると案内しています。

近年は、従来の画像分類や物体検出だけでなく、視覚言語モデル(VLM) の進化によって、画像認識は「見る技術」から「理解して活用する技術」へと変わりつつあります。Microsoft が2026年3月に発表した Phi-4-reasoning-vision も、画像を含むマルチモーダル推論を重視したモデルです。こうした流れにより、画像認識は単独の技術ではなく、生成AIや業務自動化と連携する基盤技術としての役割を強めています。

また、今後はクラウド上での高度な解析だけでなく、エッジAIを使ってカメラや現場機器の近くでリアルタイムに処理する活用も広がるとみられます。これにより、製造現場の外観検査、店舗の安全管理、物流現場の検品、自動運転やロボティクスなど、遅延を抑えたい場面での導入が進みすくなります。NVIDIA も、AIの推論基盤がクラウドからデータセンター、ワークステーション、エッジまで広がっていると案内しています。

このように、画像認識の未来は単なる精度向上だけではありません。画像を理解し、他のデータと組み合わせ、現場で即座に活用する方向へ進化している点が大きな変化です。今後、画像認識は製造、物流、小売、医療、セキュリティといった分野だけでなく、より幅広い業務や生活シーンで活用が広がっていくでしょう。

AIsmileyでは、画像認識サービスの利用料金・初期費用・無料プラン・トライアルの有無などを比較検討することができるカオスマップを無料でお配りしています。より最適なサービスを選択するための比較検討を簡単に行うことができますので、画像認識サービスの導入を検討の際は、ぜひお気軽にご活用ください。

2024/12/13

2024/12/9

2024/12/5

2024/11/5

2024/10/30

2024/10/24

2024/10/10

2024/10/1

2024/9/30

2024/9/25

2024/9/20

2024/9/11

2024/9/10

2024/9/5

2024/9/4

2024/9/3

画像認識技術として最も古いといわれているのは、1940年代に活用され始めた「バーコード」です。バーコードとは、バーとスペースの組み合わせによって、数字や文字を機械が読み取れるように表現したものを指します。

身近な例を挙げると、 無人レジ、車の自動運転、Instagramなどの製品に使われています。

画像認識などをはじめとするAIのプログラミング言語は、Pythonが主流になってきています。 Pythonとは、少ないコードで簡潔にプログラムを書くことができるという特徴があり、専門的なライブラリが豊富にあることも魅力のひとつです。

業務の課題解決に繋がる最新DX・情報をお届けいたします。

メールマガジンの配信をご希望の方は、下記フォームよりご登録ください。登録無料です。

AI製品・ソリューションの掲載を

希望される企業様はこちら