生成AI

最終更新日:2026/03/12

SB Telco AI Cloud

SB Telco AI Cloud

ソフトバンクは、自社通信基盤を生かしてAI時代の社会インフラを構築する「Telco AI Cloud」構想を発表しました。GPUクラウドとAI-RAN、AIデータセンター向けソフトウエアを統合し、AIインフラプロバイダーを目指します。

このニュースのポイント

ソフトバンク株式会社は、自社通信基盤を生かしたAI時代の社会インフラを構築する「Telco AI Cloud」構想を発表しました。

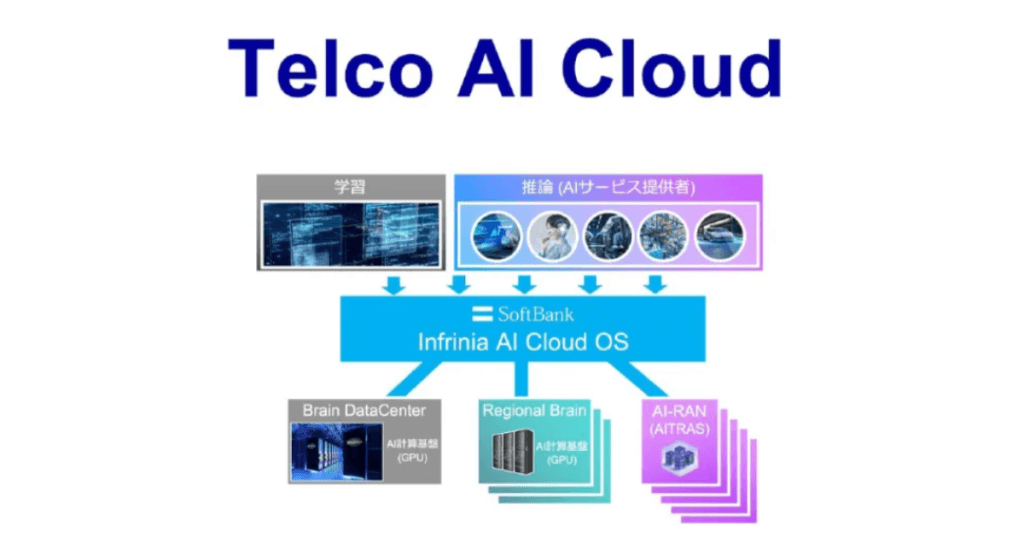

「Telco AI Cloud」は、GPUクラウドによる大規模なAIデータセンター基盤に加え、AI-RANのMEC基盤、AIデータセンター向けのソフトウエアスタック「Infrinia AI Cloud OS」を統合したAIインフラ構想です。

学習から推論までのAI処理を最適化し、全国規模の通信基盤を活用することで、低遅延・高信頼でソブリン性を備えた分散型のAIインフラを構築します。

今回の新構想は、全国規模の通信基盤を有するソフトバンクだからこそ実現可能なものです。ハイパースケーラーなどでみられる集中型クラウドとは異なり、通信ネットワークを活用した分散型AIインフラの構築が可能です。

「Telco AI Cloud」は、主にAIの学習を担う大規模なAIデータセンターであるGPUクラウドと、推論向けに低遅延で処理を行うAI-RANのMEC基盤、オーケストレーター、さらにそれらを統合管理するソフトウエアスタック「Infrinia AI Cloud OS」の3つで構成されています。

ソフトバンクは、AI-RANのプロダクト「AITRAS(アイトラス)」において、AI処理とRANの制御に使用する計算資源の需要をリアルタイムに把握。リソースの空き状況やアプリケーション要件、消費電力予測などの複数の指標に基づいて、柔軟かつ動的に配分するオーケストレーターの開発を進めています。

「Telco AI Cloud」は、RANも1つのAIアプリケーションとして統合管理され、通信ネットワークとAI処理基盤を横断した高度な計算資源の制御を実現します。

また、分散型AIインフラでは、拠点ごとに構成が異なることから運用の複雑さが課題となっていました。

ソフトバンクではこの課題を解決するため、GPUから通信ネットワーク、オープンソースシステムのKubernetes、AIワークロードまでを統合管理するソフトウエアスタック「Infrinia AI Cloud OS」を開発しました。これにより、学習から推論までのAI処理を最適化し、セキュアなマルチテナント型のGPUクラウド運用を可能にします。

「Telco AI Cloud」の実現に向け、既にフィジカルAI時代に向けた通信ネットワークの高度化や、産業分野におけるセキュアなエッジAI基盤の展開、AI-RANエコシステムの拡大などの取り組みが行われています。

ソフトバンクは、今回の「Telco AI Cloud」構想により、これまでの通信事業者の枠を超え、AIインフラプロバイダーへの進化を目指します。

出典:ソフトバンク株式会社

業務の課題解決に繋がる最新DX・情報をお届けいたします。

メールマガジンの配信をご希望の方は、下記フォームよりご登録ください。登録無料です。

AI製品・ソリューションの掲載を

希望される企業様はこちら