生成AI

最終更新日:2026/04/30

LM Studioの使い方と日本語化!

LM Studioの使い方と日本語化!

最近注目を集めている「LM Studio」は、あなたのパソコンでAIモデルを動かせる画期的なツールです。

インターネットに接続せずにAIと対話できるため、セキュリティを重視する方や、自社の機密情報を扱いながらAIを活用したい方に最適です。

この記事では、LM Studioの基本的な使い方から高度な活用法まで、以下のポイントを解説します。

特に、IT知識が豊富でない方でも、手順に沿って操作するだけで、ChatGPTのようなAIをローカル環境で使いこなせるようになります。

プライバシーを守りながらAIの恩恵を受けたい方は、ぜひ最後までお読みください。

LM Studioは、インターネット接続なしでもPCのローカル環境でLLM(大規模言語モデル)を動かせる画期的なツールです。

クラウドサービスに依存せず、自分のコンピューター上でAIモデルを実行できるため、近年急速に注目を集めています。

その主な特徴は以下の3点です。

最近の利用規約の変更により、商用利用も無料で可能になった点は、企業ユーザーにとって朗報です。

Ollama、Text generation web UI、LocalAIなど他のローカルLLMツールと比較しても、初心者から開発者まで幅広いユーザーに対応した、バランスの取れた機能セットを提供しています。

LM Studioの最大の特長は、完全にローカル環境で動作する点にあります。

あなたが入力したデータやプロンプトは一切外部サーバーに送信されないため、機密性の高い情報を安心して扱えます。

これは企業の機密文書や個人のプライベートな情報を処理する際に特に重要な利点です。

初回のモデルダウンロード時やアプリケーションのアップデート確認時を除けば、インターネット接続なしで動作します。

以下のようなメリットがあります。

クラウドベースのAIサービスでは、入力データが必ず外部サーバーに送信され処理されるため、情報漏洩のリスクが常に存在します。

一方、LM Studioではすべての処理があなたのPC内で完結するため、データセキュリティとプライバシー保護の観点で圧倒的に優位性があります。

特に、医療情報や法律文書など、厳格な守秘義務が求められる分野での活用に最適です。

最近の利用規約の変更により、商用利用も無料化されたことで、以下のようなメリットが生まれました。

ただし、より高度な機能が必要な場合は有料プランの検討も必要です。

具体的には、以下の機能が必要な場合です。

このような要件があれば、TeamsプランやEnterpriseプランへのアップグレードを検討するとよいでしょう。

無料版でも十分な機能を備えていますが、組織の規模や要件に応じて最適なプランを選択することをお勧めします。

参考:LM Studio|LM Studio is free for use at work

LM Studioは、OllamaやGPT4Allといった他のローカルLLM実行ツールと比較して、直感的なGUIを中心に設計されている点が最大の特徴です。

コマンドラインの知識がなくても、マウス操作だけでモデルの検索からダウンロード、起動までをすべて完結できるため、技術的なバックグラウンドを持たないユーザーでも簡単に利用できます。

特に優れている点として以下が挙げられます。

さらに、RAG(Retrieval Augmented Generation)機能によるドキュメント検索や、一部のモデルではマルチモーダル対応も実現しています。

Ollamaがコマンドライン操作に強みを持ち、GPT4Allが軽量さを特徴とする中、LM Studioは使いやすさと機能の豊富さでバランスの取れた選択肢となっているのです。

| ツール名 | GUI操作 | API互換性 | RAG / マルチモーダル | 特徴・おすすめユーザー |

| LM Studio | ◎

(完全対応) |

◎

(OpenAI互換) |

◎

(標準対応) |

バランス型

検索から起動までGUIで完結し、機能も豊富。初心者から開発者まで幅広く推奨。 |

| Ollama | △

(基本CLI) |

◎

(独自仕様) |

△ | 軽量・高速

コマンドライン操作に抵抗がない人や、動作の軽快さを重視する人向け。 |

| GPT4All | ◎ (操作性良) |

△

(限定的) |

△ / × | GUI重視

CPUでの動作に強く、チャット利用がメインの人向け。機能拡張性はやや低め。 |

| LocalAI | × (なし) |

◎ (OpenAI互換) |

◎ / △ | 開発者向け

設定ファイルで細かく制御したいエンジニア向け。GUIがないため導入難易度は高め。 |

LM Studioを導入するには、まず適切なPCスペックを確認することが重要です。

快適に動作させるためには、最低でも16GBのRAMと、NVIDIA GPUを搭載したマシンが推奨されます。

特に、7B~13Bパラメータのモデルを動かす場合は、RTX 3060以上のGPUがあると安定して動作します。

導入手順は非常にシンプルで、以下のステップで完了します。

インストール後は、使用するモデルのサイズに応じて、PCのリソースを確認しておくことをお勧めします。

例えば、30Bを超える大型モデルを使用する場合は、32GB以上のRAMと高性能なGPU(RTX 4070以上)が必要になります。

初期設定では英語インターフェースですが、設定画面から日本語に変更できます。

これで基本的な導入は完了し、次はモデルのダウンロードに進めます。

| 項目 | 推奨スペックの目安 |

| GPU (VRAM) | NVIDIA製 8GB以上(快適な動作に推奨) |

| メモリ (RAM) | 16GB以上(GPUがない場合は特に重要) |

| CPU | 最新のApple Silicon (M1/M2/M3) または 高性能Intel/AMD CPU |

LM Studioを快適に動作させるには、ハードウェア、特にGPUのスペックが重要な要素となります。

最も理想的なのはNVIDIA製GPUで、VRAM容量が8GB以上あると多くのモデルをスムーズに動かせます。

RTX 3060以上のグラフィックカードがあれば、ほとんどの一般的なモデルを問題なく実行できるでしょう。

GPUを搭載していないPCでも動作は可能ですが、応答速度が大幅に低下することを覚悟する必要があります。

その場合は以下の対策が有効です。

モデルのサイズによって必要なリソースは大きく異なります。

具体的な目安は以下の通りです。

ストレージに関しては、モデルファイル自体が数GBから数十GBになるため、少なくとも100GB程度の空き容量があると安心です。

SSDの使用も応答速度向上に貢献するため、可能であればSSDへのインストールをおすすめします。

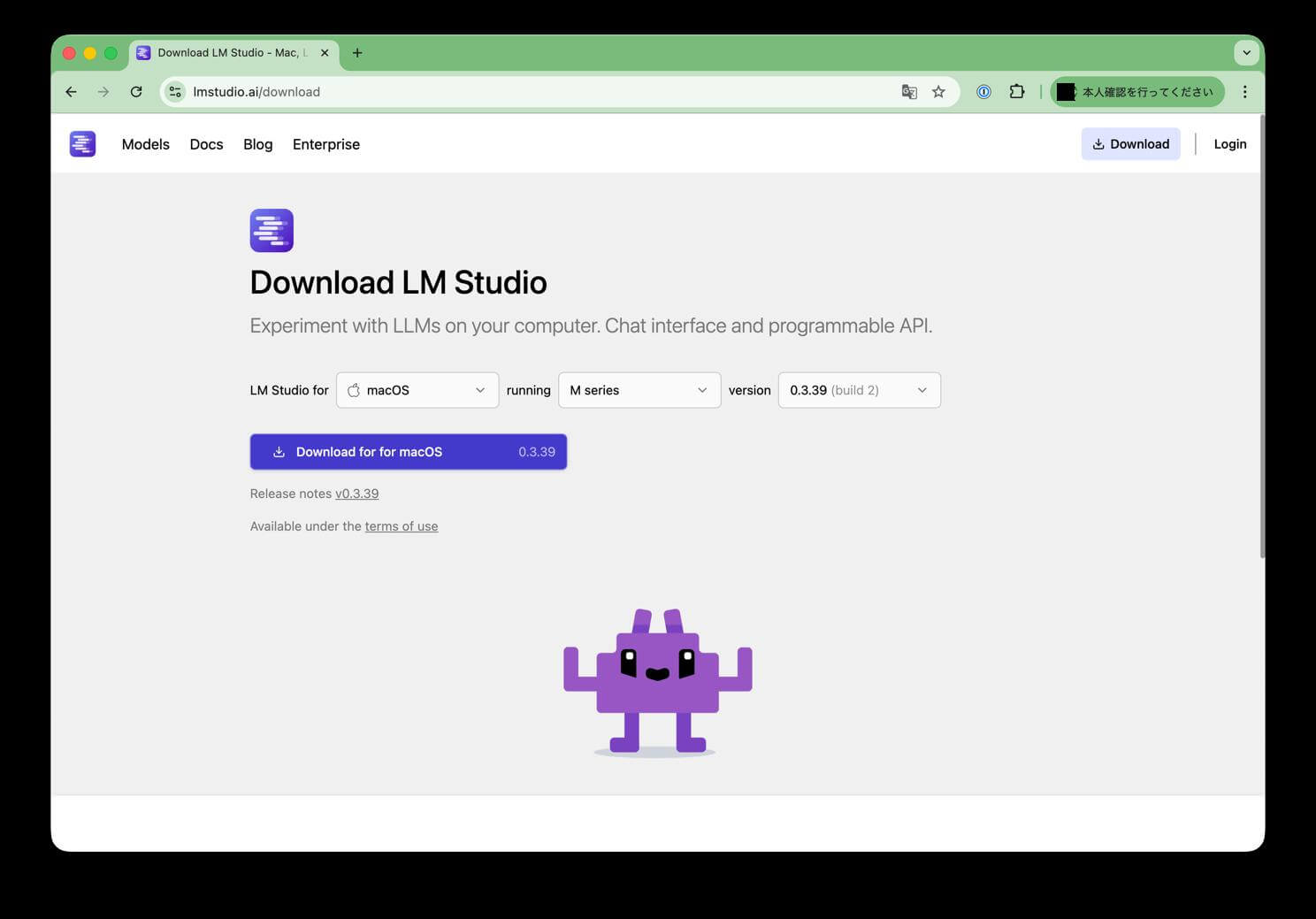

LM Studioをインストールするには、まず公式サイト「lmstudio.ai」にアクセスしましょう。

トップページに表示されている大きなダウンロードボタンをクリックすると、お使いのOSに合わせたインストーラーが自動的に選択されます。

もし手動で選びたい場合は、ページ下部にあるWindows、macOS、Linux向けのダウンロードリンクから適切なものを選択できます。

ダウンロードが完了したら、次の手順でインストールを進めます。

初回起動時には、セットアップウィザードが表示され、使用レベルの選択を求められます。「User(一般ユーザー)」は基本機能のみ、「Power User(上級者)」は高度な設定にアクセスできるようになります。

初心者の方は「User」を選択し、後から設定画面でいつでも変更可能です。これでLM Studioの準備が整いました。

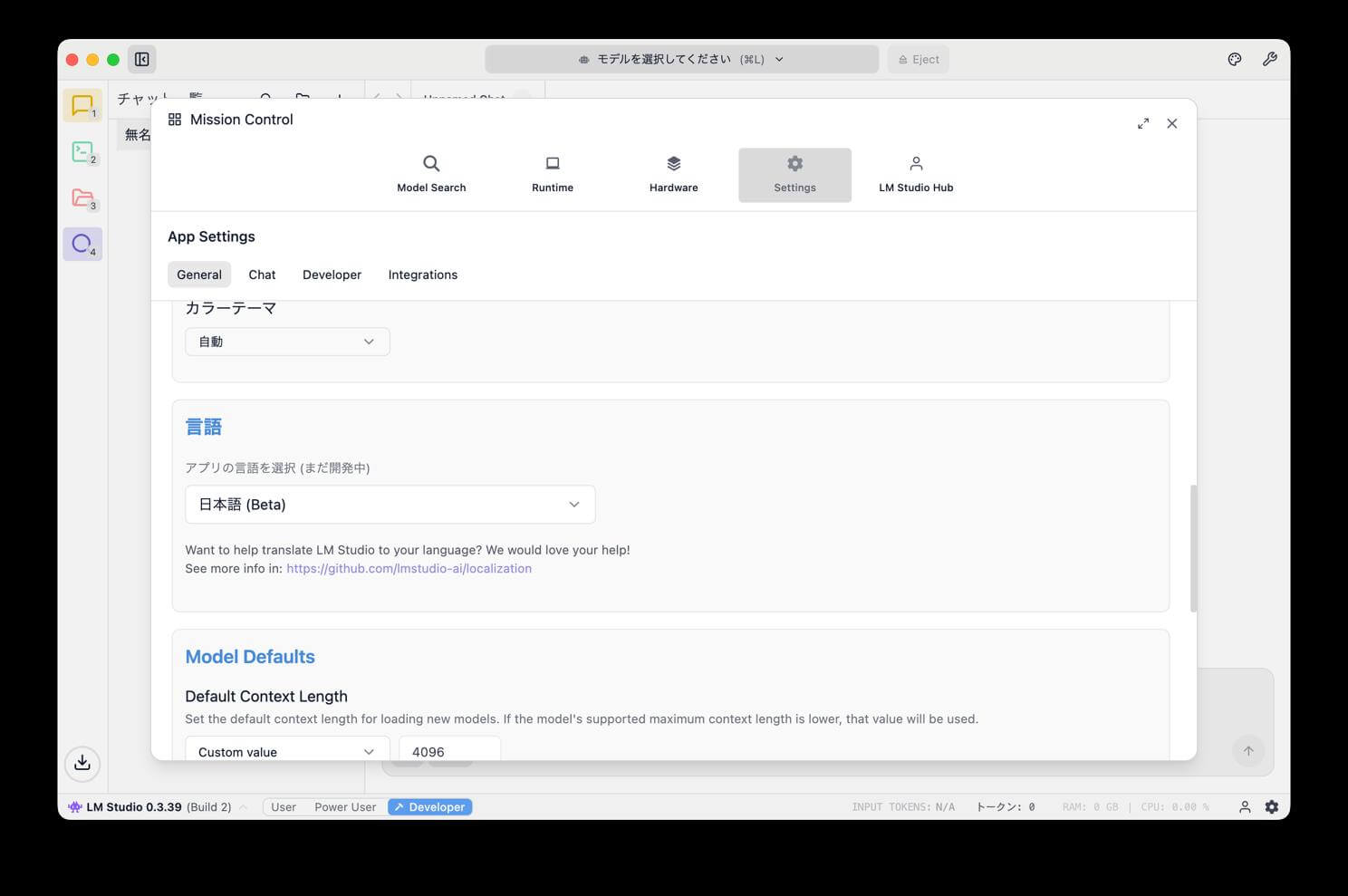

LM Studioのインターフェースは標準で英語表示ですが、日本語に切り替えることで操作性が格段に向上します。日本語化の手順はとても簡単です。

アプリケーション起動後、画面右上に表示されている歯車アイコン(Settings)をクリックしてください。設定メニューが開き、左側のメニューから「Appearance」(外観)を選択します。右側に表示される設定項目の中から「Language」(言語)の項目を探し、プルダウンメニューをクリックすると言語一覧が表示されます。

この中から「日本語 (Beta)」を選択してください。選択後、即座にインターフェース全体が日本語表示に切り替わります。メニュー項目やボタン、設定画面などすべての要素が日本語化されるため、直感的な操作が可能になります。

なお、日本語表示はまだベータ版のため、一部翻訳が不完全な箇所や英語表記が残っている部分もあります。

今後のアップデートで改善されることが期待されています。設定はアプリケーションを再起動しても保持されますので、一度設定すれば次回以降も日本語インターフェースで利用できます。

LM Studioでの操作は、モデルのダウンロードから対話までシンプルな3ステップで完結します。

まずはモデルを入手します。左側のメニューバーにある「Discover」タブをクリックすると、Hugging Faceに公開されている様々なモデルを検索できます。

モデルを選ぶ際のポイントは以下の3つです。

モデルをダウンロードしたら、次は「Chat」タブに移動してモデルをロードします。画面上部のドロップダウンメニューからダウンロードしたモデルを選択し、「Load」ボタンを押すだけです。

ロード完了後は、通常のチャットアプリのように下部の入力欄に質問や指示を入力するだけで対話が始まります。

さらに高度な使い方として、「System Prompt」の設定があります。

これはAIの役割や応答スタイルを指定できる機能で、「あなたは経理の専門家です」「簡潔に回答してください」などと設定すると、より目的に合った回答が得られます。

LM Studioの最大の魅力は、これらすべての操作がGUIベースで直感的に行える点です。プログラミングの知識がなくても、数クリックでローカルAIとの対話環境が整います。

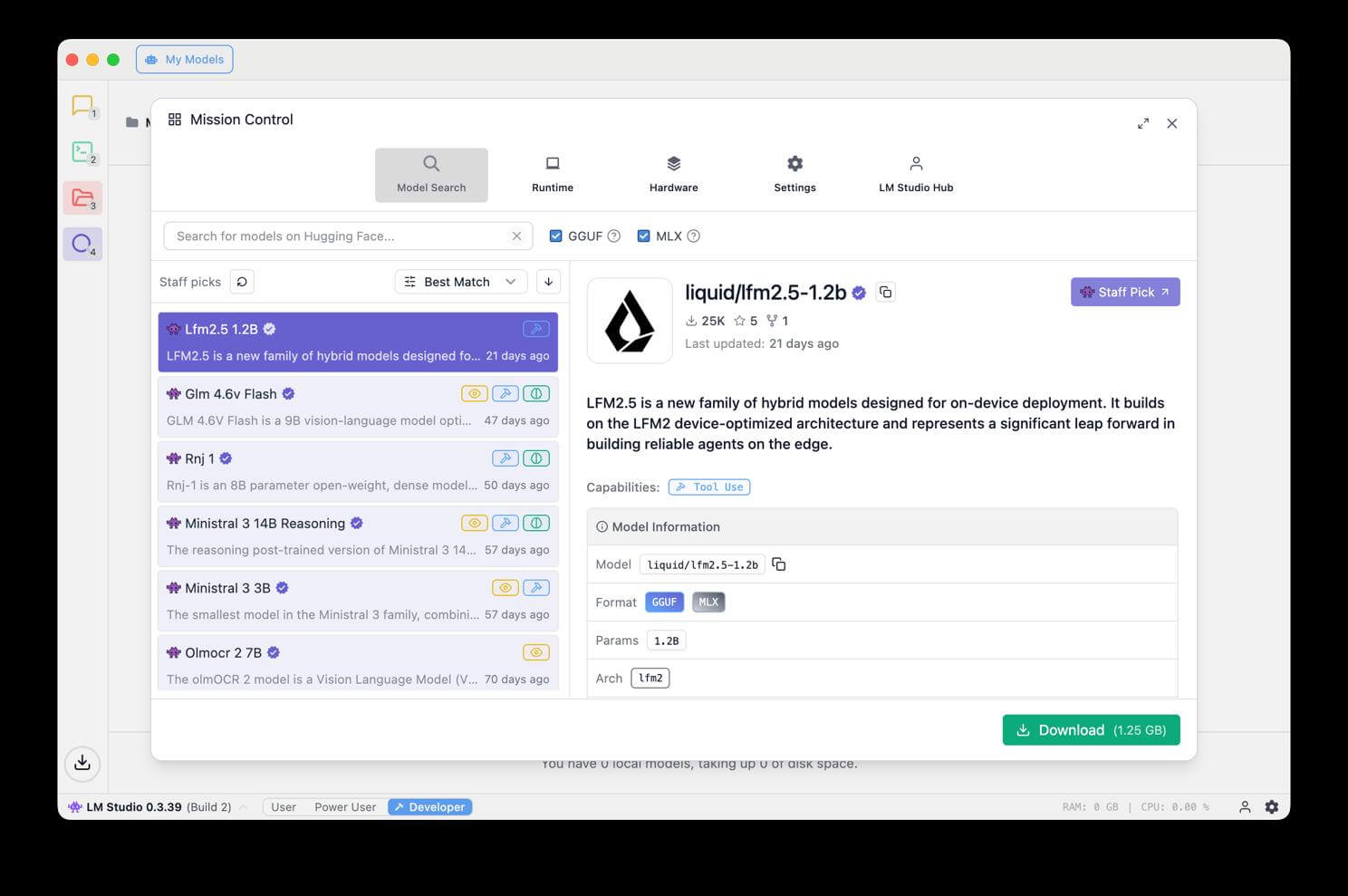

LM Studioでモデルをダウンロードする際は、左側メニューの「Discover(虫眼鏡アイコン)」を活用すると効率的です。

このアイコンをクリックすると検索画面が開き、上部の検索バーから希望のモデルを簡単に探せます。

以下のようなキーワードで検索すると良いでしょう。

検索結果には、Hugging Face上でホストされている互換性のあるモデルが一覧表示されます。

各モデルには、性能や特徴、ファイルサイズなどの情報が表示されるので、自分のニーズや環境に合ったものを選びましょう。

モデル名の横に表示される「Q4_K_M」などの表記は量子化レベルを示しており、数字が小さいほどファイルサイズは小さくなりますが、精度はやや落ちる傾向があります。

PCのスペックに合わせた適切なサイズ選びが重要です。

気になるモデルが見つかったら「Download」ボタンをクリックするだけで、ダウンロードが開始されます。

初回は時間がかかる場合がありますが、一度ダウンロードしたモデルは再利用できるので効率的です。

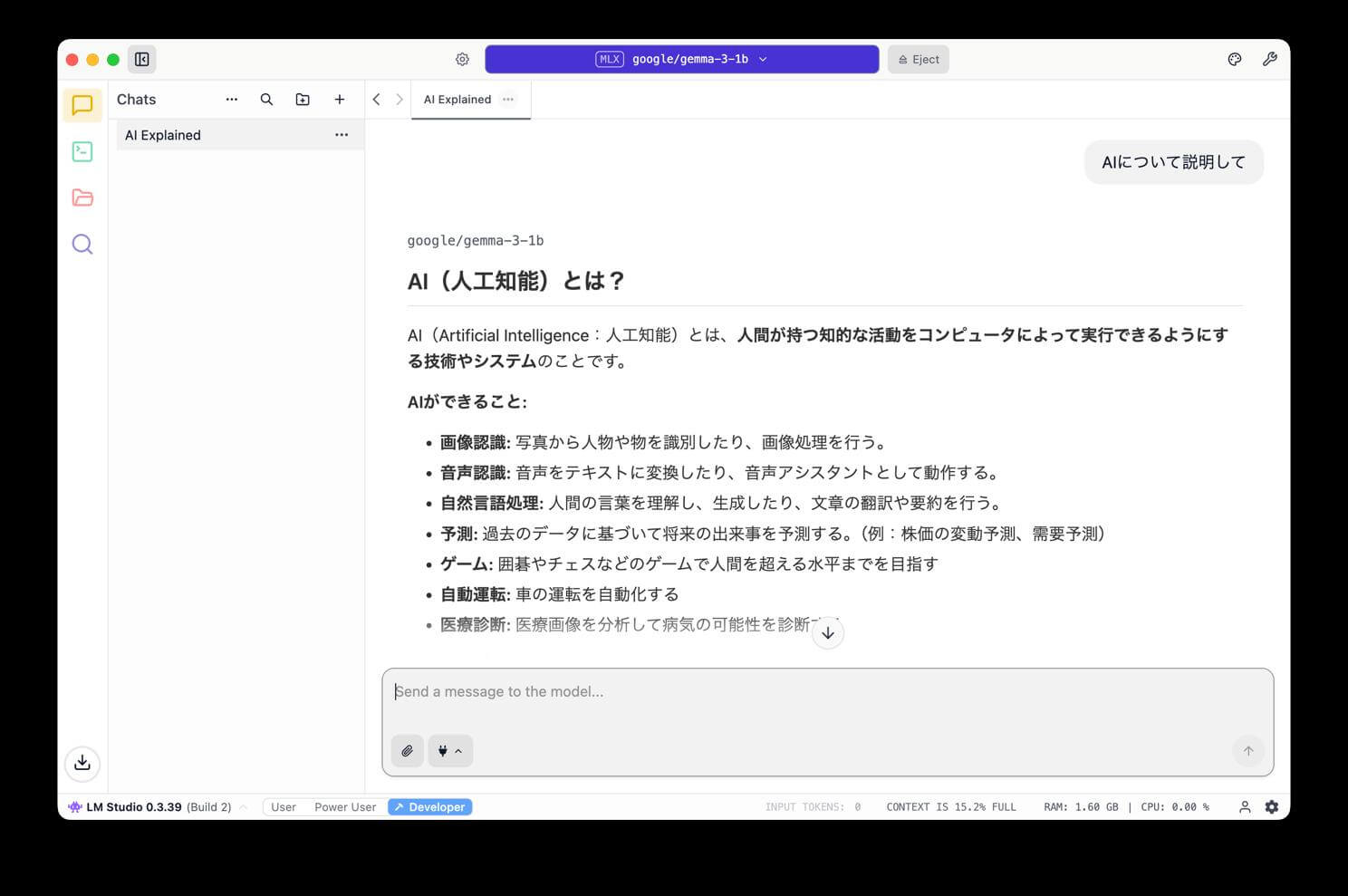

モデルをダウンロードしたら、いよいよAIとの対話を始めましょう。

まず画面上部の「Select a model to load」ドロップダウンメニューから、先ほどダウンロードしたモデルを選択します。

選択すると自動的にモデルのロードが始まり、PCのスペックによって数秒から数分かかることがあります。

ロードが完了すると、画面下部のチャット入力欄が活性化されます。

ここに質問やプロンプトを入力し、Enterキーを押すか送信ボタンをクリックすれば、AIからの回答が表示されます。会話はスレッド形式で積み重なっていくので、文脈を理解した対話が可能です。

特筆すべき点として、Gemmaや一部の最新モデルでは画像入力にも対応しています。

これらの方法で画像を添付し、「この画像について説明して」などと質問すれば、AIが視覚情報を分析して回答してくれます。

対話の履歴は自動的に保存されるため、後から続きの会話を再開することも可能です。

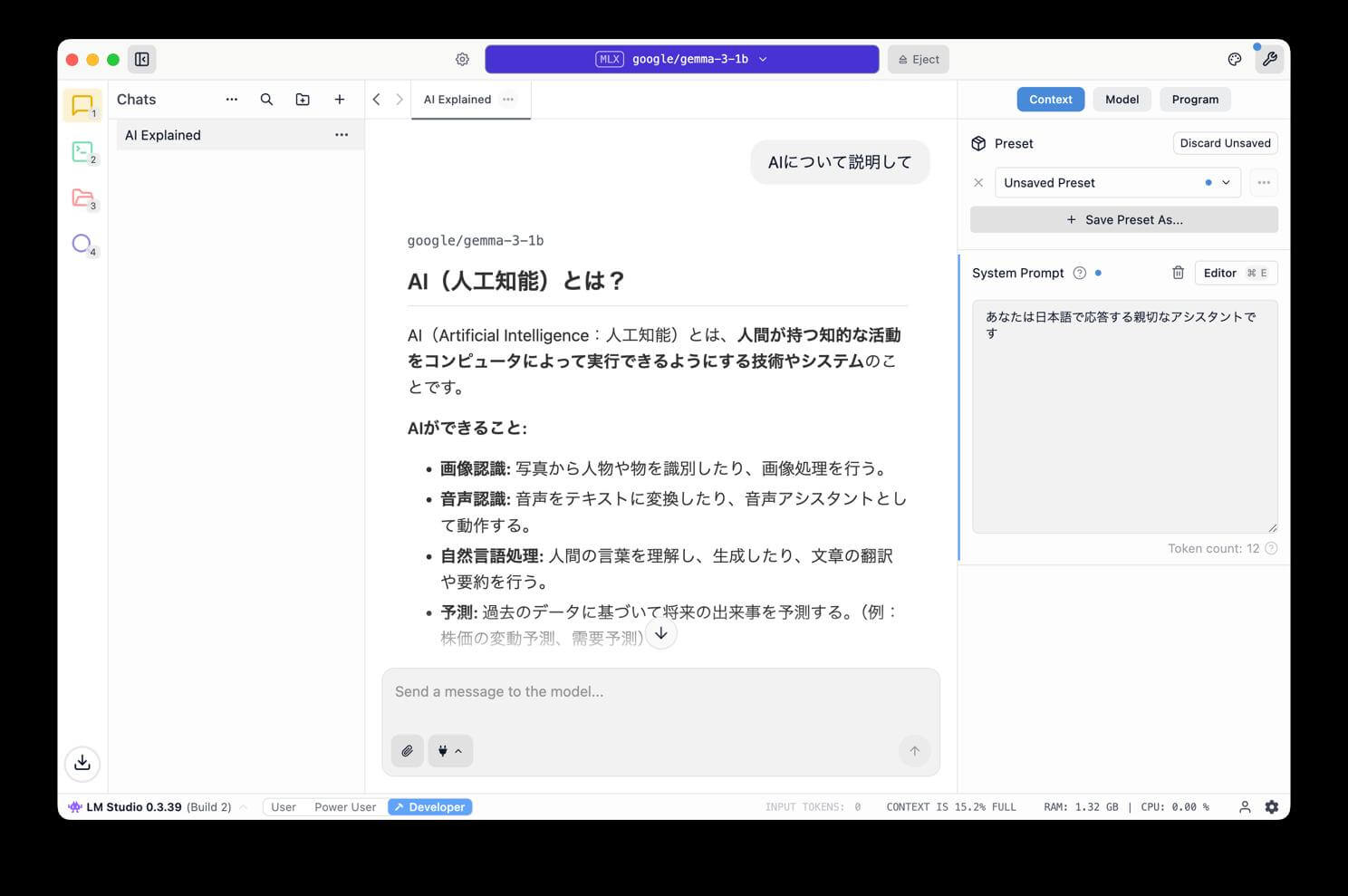

LM Studioでは、AIの振る舞いをカスタマイズするためにシステムプロンプトが非常に重要な役割を果たします。

チャット画面の右側パネルにある「System Prompt」欄を編集することで、AIに特定の役割や指示を与えることができます。

以下のような指示が効果的です。

特に注意すべき点として、多くのモデルはデフォルトでは英語で応答する傾向があります。日本語での対話を希望する場合は、システムプロンプトに「日本語で回答してください」と明記しておくと安心です。

また、専門的な内容を扱う場合は、その分野の専門家としての役割を指定すると、より的確な回答が得られることが多いです。

システムプロンプトは会話の最初に一度設定するだけでその後の対話全体に影響するため、会話の始めに適切に指定しておくことをおすすめします。

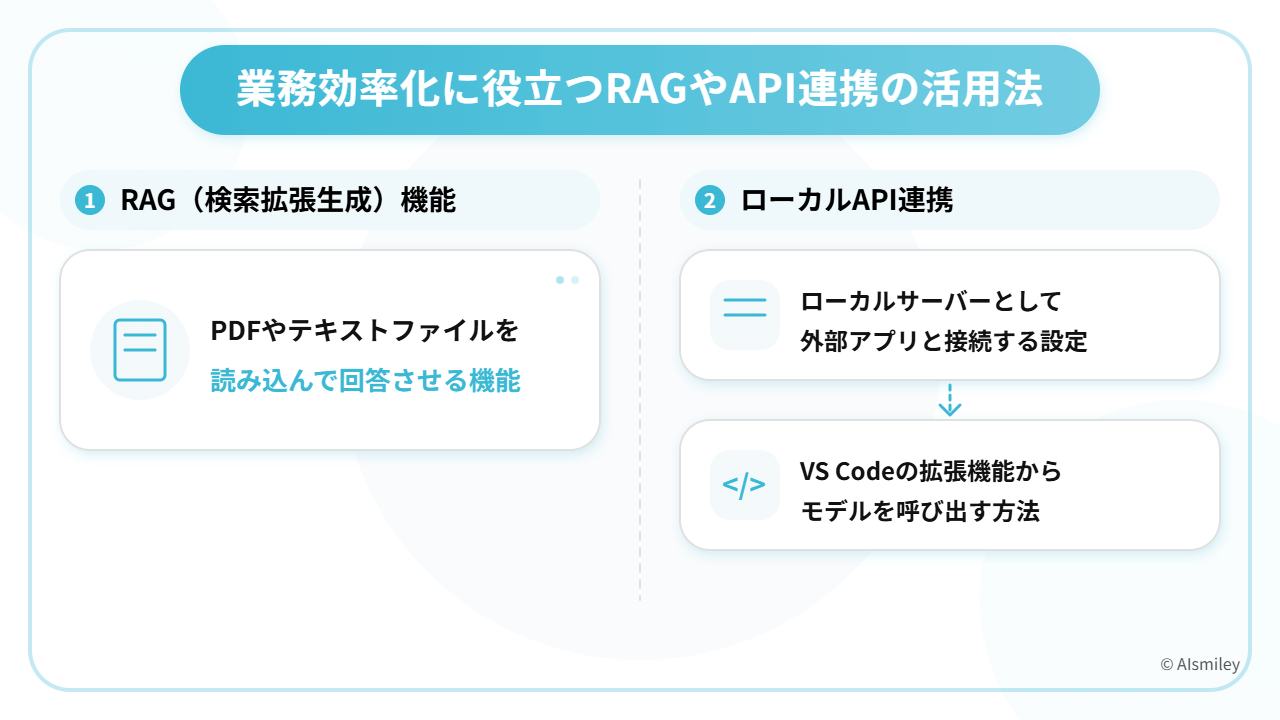

LM Studioの真価は、単なるチャットボットとしての利用にとどまらず、実務プロセスに組み込んで業務効率を飛躍的に高める拡張機能にあります。

特に注目すべきは以下の2つの強力な機能です。

これらの機能を活用することで、データ分析、コード生成、文書作成などの業務を自動化し、人間はより創造的な作業に集中できるようになります。

また、すべての処理がローカル環境で完結するため、データセキュリティを確保しながらAIの恩恵を最大限に享受できるのです。

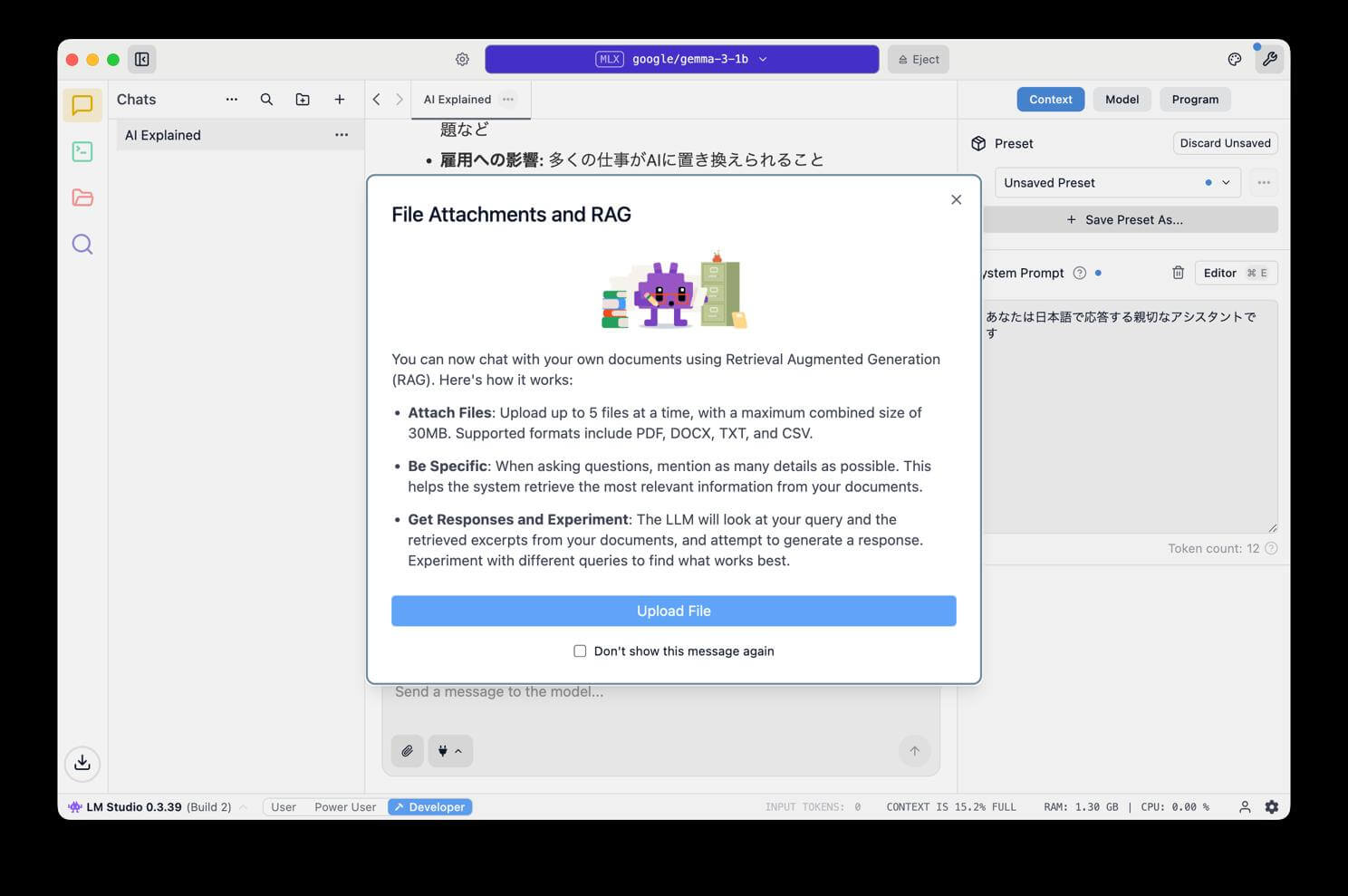

LM Studioには、業務効率化に大きく貢献するRAG(検索拡張生成)機能が搭載されています。

この機能を使えば、社内マニュアルやプロジェクト資料などのPDFやテキストファイルを読み込ませ、それらの内容に基づいた精度の高い回答を得ることができます。

ファイルの読み込み方法は非常に簡単です。

本機能の強みは、AIが元々学習していない独自情報に基づいた回答が得られることです。

具体的には、次のような業務で大きな効果を発揮します。

特に注目すべきは、インターネット接続なしでこれらの処理が完結することです。機密性の高い社内文書でも安心して活用できるため、セキュリティを重視する企業環境でも安心して利用できます。

さらに、読み込んだ文書から引用して回答を生成するため、情報の出所が明確になり信頼性も向上します。

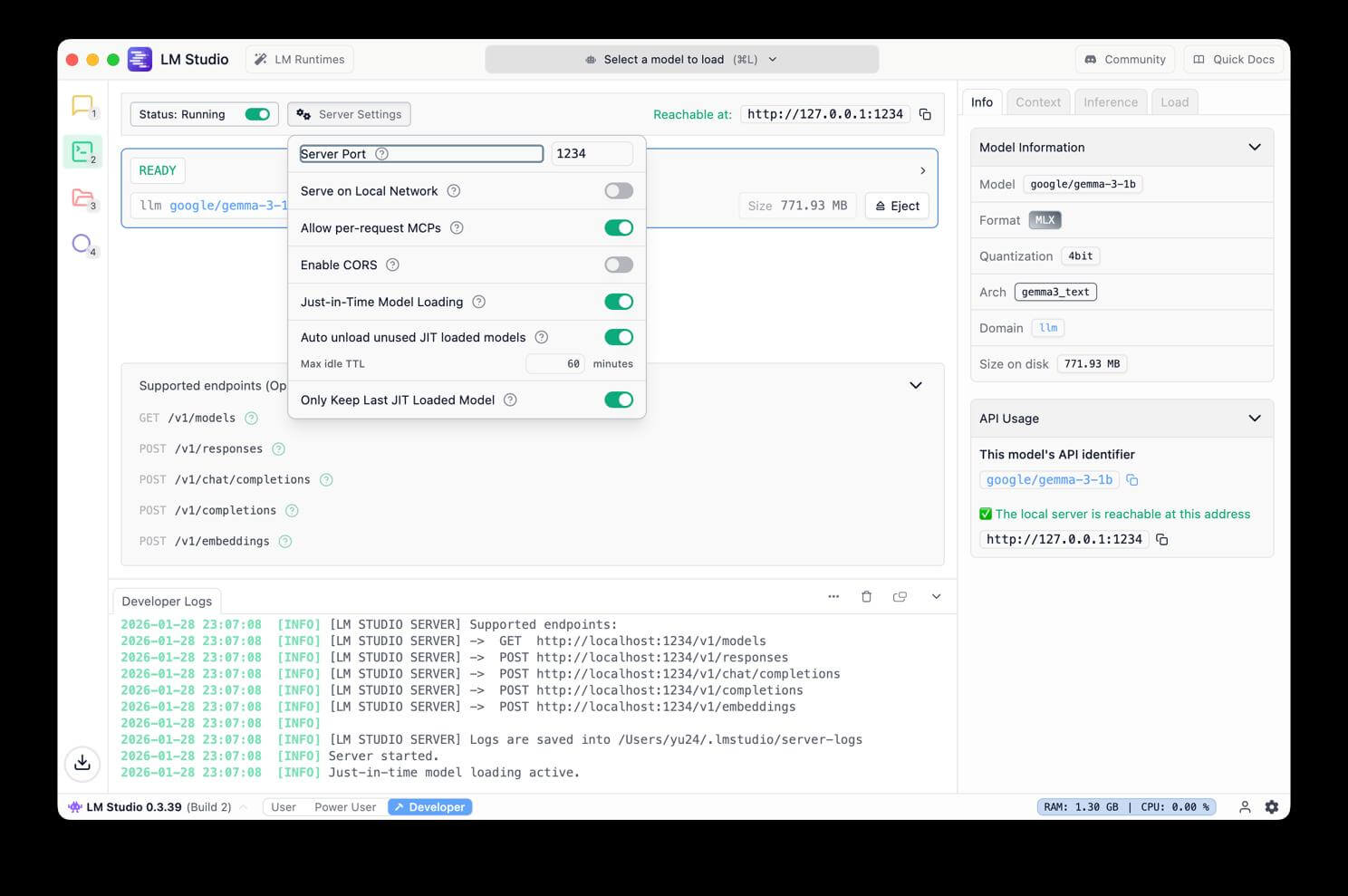

LM Studioの強力な機能の一つに、OpenAI互換のAPIサーバーとして動作する能力があります。

この機能を活用すれば、既存のOpenAI APIを利用するアプリケーションやツールと簡単に連携できるようになります。

設定方法は非常にシンプルです。LM Studioの「Developer」タブを開き、トグルスイッチを「Running」にするだけで、ローカルサーバーが起動します。

デフォルトでは、サーバーは「http://localhost:1234/v1」のエンドポイントで利用可能になります。

サーバー設定では以下のオプションをカスタマイズできます。

この機能の最大の利点は、ChatGPT APIを使用する既存のツールやプログラムの接続先をLM Studioのエンドポイントに変更するだけで、すぐにローカルLLMを利用できることです。

これにより、APIコストを削減しながら、データのプライバシーを確保できます。

Pythonのプログラムであれば、OpenAIのライブラリの設定で「base_url」パラメータを変更するだけで連携が完了します。

これにより、社内システムやカスタムアプリケーションをセキュアに拡張できるでしょう。

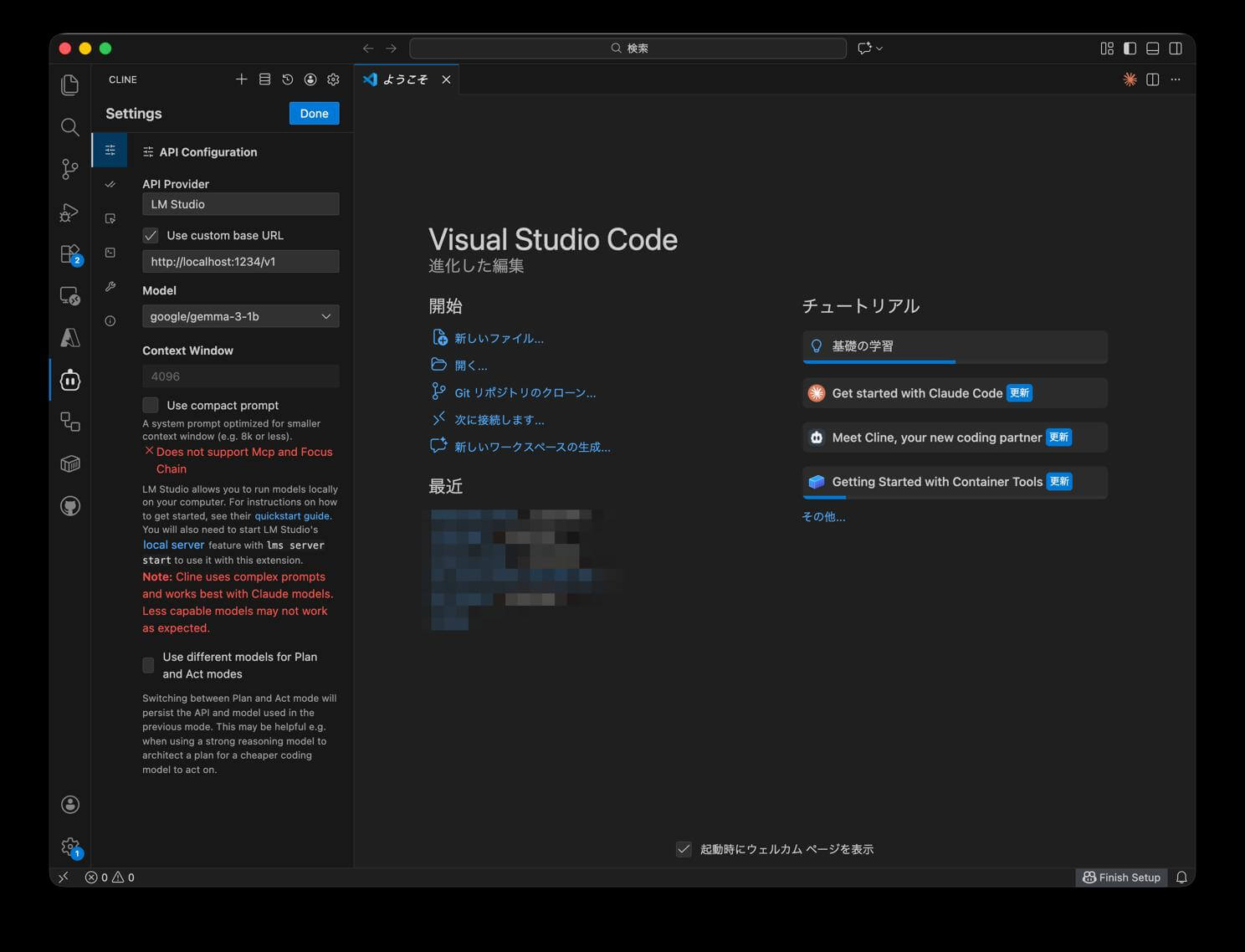

Visual Studio Codeで開発作業をしながらLM Studioのモデルを活用したい方には、拡張機能を使った連携がおすすめです。

特に「Cline」や「Continue」などのAI支援拡張機能を使えば、エディタ上で直接コード生成や修正の支援を受けることができます。

設定方法は以下の通りです。

この連携により、オンラインのAPIサービスと比較して次のようなメリットがあります。

特にコーディング特化モデルを使えば、関数の自動補完やバグ修正、コメント生成などの作業効率が大幅に向上します。

一度設定してしまえば、Visual Studio Code上で開発しながらシームレスにAIの支援を受けられるようになります。

LM Studioは、ローカル環境でLLMを安全かつ柔軟に活用できる強力なツールです。インターネット接続なしで動作するため、機密データを守りながらAIの恩恵を受けられます。

導入にあたっては、適切なハードウェア要件を満たしたPCを用意し、公式サイトからインストーラーを入手するだけで簡単に始められます。日本語UIへの変更も可能で、初心者にも使いやすい環境が整っています。

モデル選択においては、以下の点がポイントとなります。

さらに、API連携やVisual Studio Code拡張機能との統合により、開発効率を大幅に向上させることができます。プライバシーを確保しながらAIの力を最大限に引き出せるLM Studioは、今後のAI活用において欠かせないツールとなるでしょう。

アイスマイリーでは生成AI のサービス比較と企業一覧(LLM・大規模言語モデル)を無料配布しています。課題や目的に応じたサービスを比較検討できますので、ぜひこの機会にお問い合わせください。

業務の課題解決に繋がる最新DX・情報をお届けいたします。

メールマガジンの配信をご希望の方は、下記フォームよりご登録ください。登録無料です。

AI製品・ソリューションの掲載を

希望される企業様はこちら