生成AI

最終更新日:2026/04/14

Qwen 3.5で何ができる?

Qwen 3.5で何ができる?

文章生成や画像生成、音声入力を1つで行える生成AI「Qwen」を愛用している人の中には、最新モデルであるQwen 3.5について、

「Qwen2.5と何が違うの?」「自分のPCで動くモデルはどれ?」そんな疑問を抱えていませんか?

本記事では、120B超の旧モデルを凌駕する性能を見せた最新のQwen 3.5について、具体的な進化点から、話題の「Deep Research」機能の使い方・ローカル環境での推奨スペックまで徹底解説します。

この記事を読めば、あなたの業務や開発に最適なモデルがすぐに見つかります。

画像出典:Qwen公式サイト

Qwen(クウェン)とはアリババクラウドが開発し2023年9月に初公開した大規模言語モデル(LLM)およびマルチモーダルAIモデルのシリーズです。

文章生成だけでなく、画像や音声など複数の情報を理解・処理できる点が特徴で、チャットAIとしての利用はもちろん、開発用途やローカル環境での活用にも対応しています。

また、Qwenは単一のAIではなく、用途や性能に応じて複数のモデルが展開されている「AIモデル群(エコシステム)」として提供されています。

Qwenの特徴や使い方についてもっと詳しく知りたい方は、次のページもご覧ください。

Qwen 3.5とは、アリババクラウドが開発した次世代の大規模AIモデルです。設計段階からテキスト・画像・音声などの複数情報を統合して扱える機能(マルチモーダル)と、ツールを使ってタスクを自律実行する機能(エージェント)を備えていることから、「ネイティブマルチモーダルエージェント」と呼ばれています。

ネイティブマルチモーダルエージェントとは、Native=後付けではなく設計段階から統合されている、Multimodal=テキスト・画像・音声など複数の情報を扱える、Agents=ツールを使いながらタスクを自律的に実行するという3つの意味から成り立つ言葉です。

また、Qwen 3.5は以下のように段階的にリリースされました。

| 日付 | リリース内容 |

| 2026年2月16日 | Qwen 3.5シリーズを発表。第1弾としてQwen 3.5-397B-A17Bを公開 |

| 2026年2月24日 | Qwen 3.5-122B-A10B、Qwen 3.5-35B-A3B、Qwen 3.5-27Bを公開 |

| 2026年3月2日 | Qwen 3.5-9B、Qwen 3.5-4B、Qwen 3.5-2B、Qwen 3.5-0.8BをHugging Face HubとModelScopeで公開 |

Qwen 3.5は、理解・推論・ツール利用・マルチモーダル処理を横断して扱えるよう発展したモデルシリーズなのです。

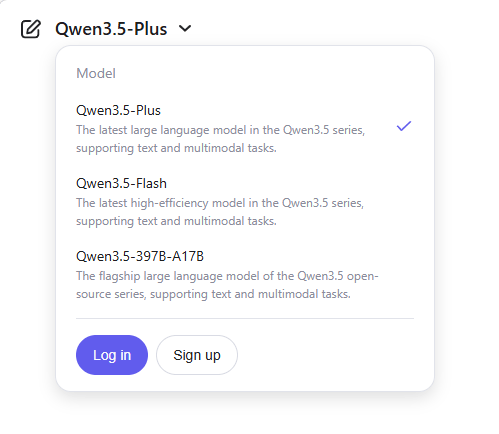

なお、Qwen ChatやModel Studioで利用する場合は、前述の公開モデル名とは別に、用途に応じた提供モデルが表示されることがあります。

利用環境によって見えるモデル名が異なる点は、あらかじめ把握しておくとよいでしょう。

画像出典:Qwen「Qwen 3.5:ネイティブマルチモーダルエージェントへ向けて」

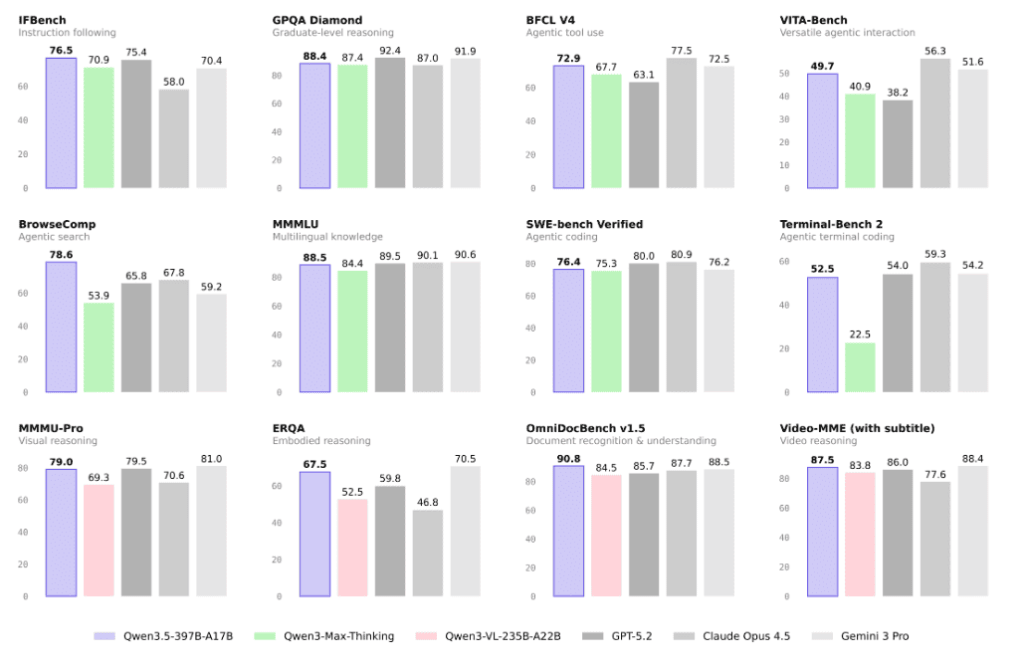

Qwen 3.5は、AIモデルの性能を評価・比較するための指標である複数のベンチマークにおいて高く評価されています。

各ベンチマークは評価する能力が異なるため、AIの強みを多角的に把握できます。

画像で使用されているベンチマークの種類と評価内容は以下の通りです。

| ベンチマークの種類 | 概要 |

| IFBench |

|

| GPQA Diamond |

|

| BFCL V4 |

|

| VITA-Bench |

|

| BrowseComp |

|

| MMMLU |

|

| SWE-bench Verified |

|

| Terminal Bench 2 |

|

| MMMU-Pro |

|

| ERQA |

|

| OmniDocBench v1.5 |

|

| Video-MME |

|

Qwen 3.5は、言語、科学といった単一の能力を選択式問題で評価するベンチマークだけではなく、社会における実際のタスクをどれだけ完遂できるかを評価するベンチマークでも高い評価を受けている点が大きな特長です。

上記のデータから、Qwen 3.5の性能における強みを4つご紹介します。

検索だけでは解けない高度な科学的推論力を評価するために設計されたベンチマークであるGPQA Diamondにおいて、Qwen 3.5-397B-A17Bが88.4という好成績を残しています。

また、多言語環境における知識理解力や言語能力を評価するMMMLUでも88.5と高いスコアを記録しており、推論力だけでなく知識を適切に扱う能力にも優れていることがわかります。

そのため、論理的な構成や正確な情報の扱いが求められるSEO記事や論文などの作成にも適しています。

特にGPQA Diamondのような高難度ベンチマークで高スコアを記録している点から、単なる知識の再現ではなく、複雑な問題に対する思考力の高さが強みです。

ユーザーの指示に応じて外部関数やAPI、ツールを適切に選択・実行する能力を評価するBFCL V4でQwen 3.5-397B-A17Bが72.9と評価されています。

さらにAIが通常の検索では見つけにくい情報を、複数の情報源を横断して探索・統合する能力を評価するBrowseCompで、78.6と高スコアを記録しています。

このことからQwen 3.5はユーザーのために適切な情報収集を行い、それを外部ツールを利用して扱いやすい形にまとめたり、適切な形にアウトプットするAIエージェントとしての能力に優れている点が大きな特徴です。

GitHub上の実際のソフトウェア課題をもとに、AIがコード修正によって問題を解決できるかを評価するSWE-bench Verifiedで、Qwen 3.5-397B-A17Bが76.4を記録しています。

そのため、Qwen 3.5は、プログラムの不具合を修正したり、既存コードをもとに機能追加や改善を行ったりする開発タスクに役立ちます。

特に、初心者が行ったコーディングの誤りを修正したり、既存のコードをもとに改善案を提示したりする場面で有効です。

動画・音声・字幕といった複数の情報をもとに、時間的な流れを含めた理解能力を評価するベンチマークであるVideo-MMEで、Qwen 3.5-397B-A17Bが87.5と評価されています。

加えて、PDFやレポートなどの複雑なドキュメントを対象に、AIがテキスト・レイアウト・表・数式といった要素を正確に解析し、構造化できるかを評価するベンチマークであるOmniDocBenchにおいても90.8と高スコアです。

これらのことからQwen 3.5は、ショート動画やPDFの内容把握から、要約・資料作成まで一貫して対応できる点が強みです。

参考:Qwen「Qwen 3.5:ネイティブマルチモーダルエージェントへ向けて」

Qwen 3.5の主な機能と対応タスクの例は以下の通りです。

| 機能 | 概要 | 対応タスクの例 |

| 自然言語の理解 | 201の言語(および方言)を理解できる | 翻訳・通訳、多言語対応のカスタマーサポート |

| 文章生成 | ユーザーのプロンプト入力に応じて自然な文章を生成できる | SEO記事作成、SNS投稿、メール文作成 |

| マルチモーダル理解 | テキスト・画像・動画など複数の情報を統合して理解できる | 画像内容の説明、動画の要約、音声データの文字起こし |

| 推論 | 与えられた情報をもとに論理的に考え、結論を導き出せる | データ分析、課題解決の提案、複雑な質問への回答 |

| コーディング | プログラミング言語やマークアップ言語を用いてコードを生成・修正できる | Webアプリ開発、コードレビュー、バグ修正 |

| エージェント | 状況に応じて自律的に判断し、複数のステップを踏みながらタスクの実行を支援する | 情報収集の自動化、業務フローの効率化、リサーチ代行 |

| ツールの使用 | 外部ツールやAPIを適切に選択し、連携して実行できる | Web検索、データ取得、外部サービスとの連携 |

文章生成や翻訳に加え、複数の情報を統合して処理し、ツール利用を伴うタスクにも対応できる点が、Qwen 3.5の大きな特徴といえるでしょう。

参考:Qwen「主要概念」

Qwen 3.5は、クラウド・API・ローカル環境など、複数の方法で利用できる生成AIモデルです。

「Qwen Chat」を使えばWeb上で手軽に利用できるほか、API経由での組み込み、ローカル環境での実行など、用途に応じて柔軟に使い分けられます。

Qwen 3.5の主な利用方法として、クラウド・API・ローカル環境それぞれの使い方を解説します。

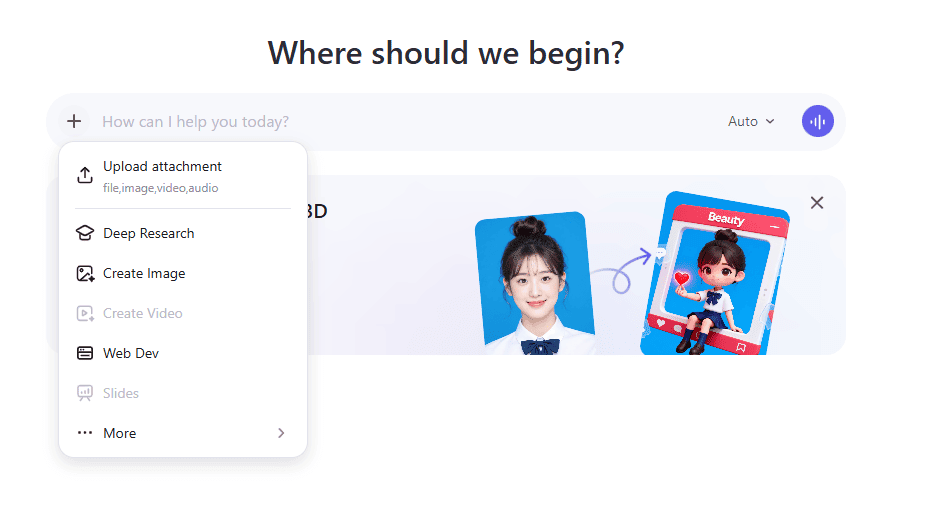

Qwen 3.5は、クラウド上のチャットインターフェース「Qwen Chat」を通じて手軽に利用できます。

Qwen Chatでは、文章生成・画像認識・画像生成・音声認識などの機能を1つの画面から操作できるため、複数の生成AIを使い分ける必要がありません。

画面上部のドロップダウンから利用するモデルを選択し、入力欄にテキストを入力するほか、音声や画像をアップロードすることで直感的に操作できます。

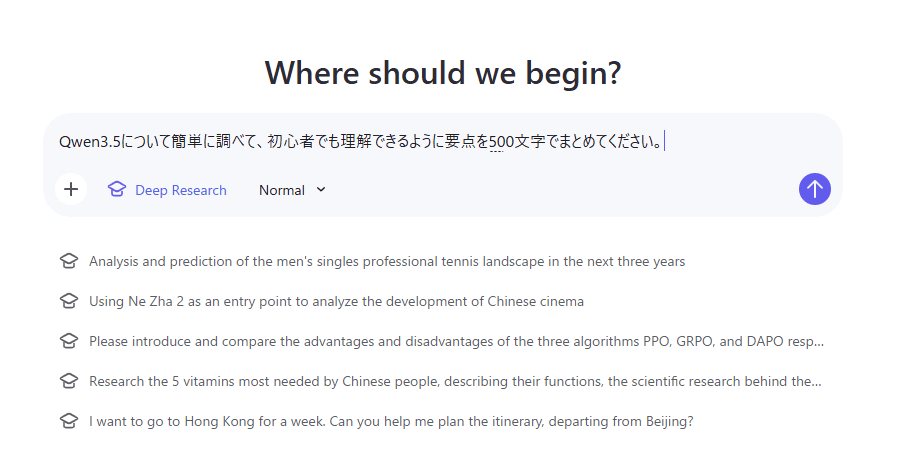

Qwen Chatでは、Auto、Thinking、Fastなどのモードを選んで使えます。Thinking(思考)モードは、複数の条件を踏まえて答えを導きたい場面や、論理的な検討が必要な質問に向いているモードです。

Autoは質問内容に応じて思考やツール利用を使い分けるモードで、調査や情報収集を行いたいときに向いています。Fastはすばやく回答を得たいときに使いやすく、短い要約や簡単な質問に向いています。質問の内容に応じて切り替えると、Qwen Chatを使いやすくなります。

Qwen Chatでは、用途に応じてモデルを選択できます。複雑な調査や多段階の検討が必要な場合はQwen 3.5-Max、文章生成や画像を含むやり取りなど幅広く使いたい場合はQwen 3.5-Plus、短い要約や言い換えなどをすばやく処理したい場合はQwen 3.5-Flashが使いやすいでしょう。

どのモデルを選ぶか迷う場合は、文章生成や調査など幅広い用途に使いやすいQwen 3.5-Plusから試すとよいでしょう。

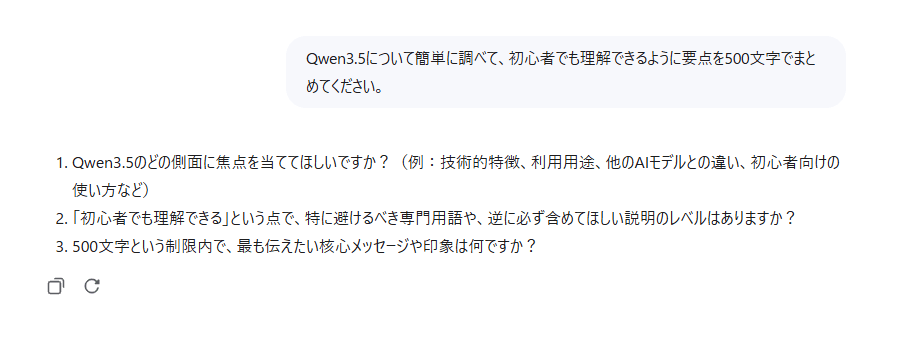

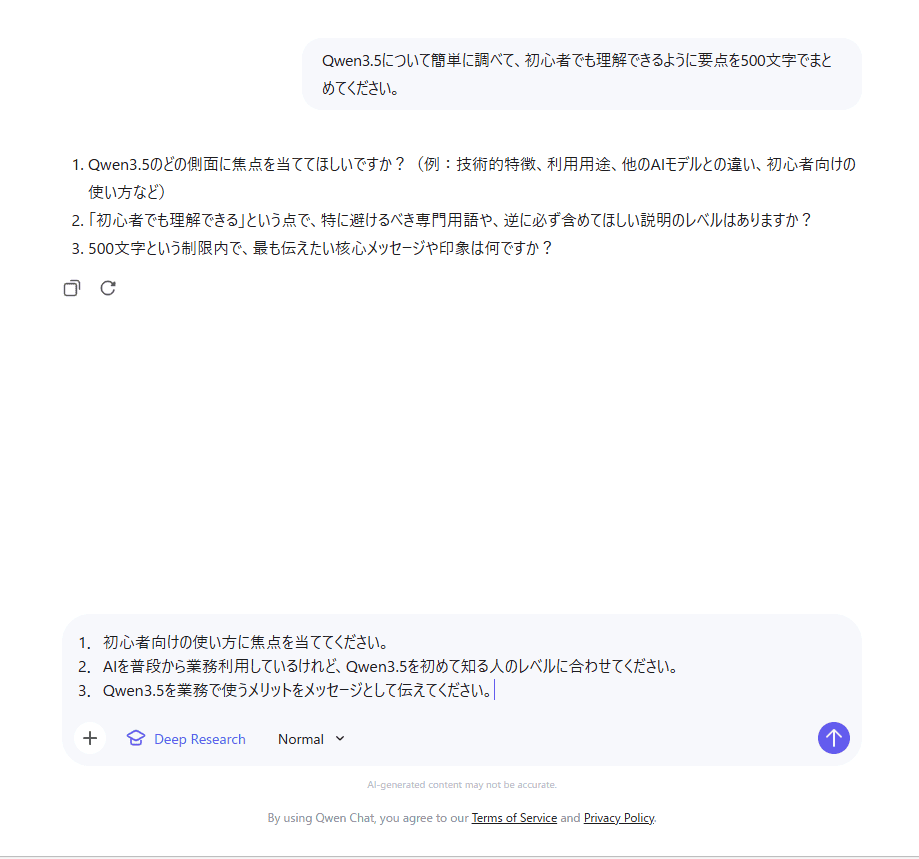

調査や情報収集を行いたい場合は、Autoモードを選択して使うと進めやすいでしょう。例として、Qwen 3.5の高度なリサーチ機能であるDeep Research機能の使い方をご紹介します。

画像出典:Qwen Chat

画像出典:Qwen Chat 画像出典:Qwen Chat

画像出典:Qwen Chat 画像出典:Qwen Chat

画像出典:Qwen Chat

1度の回答で完結しない場合でも、対話を繰り返すことで情報を深掘りし、より精度の高い調査結果を導き出せる点が特徴です。

APIを利用することで、Qwen 3.5の機能を自社サービスやアプリケーションに組み込めます。

Qwen 3.5をAPI経由で使う手順は次の通りです。

| 手順 | 概要 |

| ①アカウント作成 | Alibaba Cloudのアカウントを作成し、Model Studioにアクセスする |

| ②APIキーの取得 | ダッシュボードからAPIキーを発行し、控えておく |

| ③利用環境の準備 | Pythonなどの開発環境を用意し、必要なライブラリ(SDKなど)をインストールする |

| ④エンドポイント設定 | APIのURL(エンドポイント)を設定する |

| ⑤リクエスト作成 | モデル名や入力内容(プロンプト)、パラメータなどを指定してリクエストを作成する |

| ⑥APIを実行 | HTTPリクエストまたはSDKを使ってAPIを呼び出す |

| ⑦レスポンス取得 | 生成されたテキストや結果を受け取る |

APIは、OpenAI互換形式のAPIとして提供されており、既存の開発環境に組み込みやすく、他の生成AIと同様の感覚で利用できるのが特徴です。

また、APIではenable_thinkingの設定によって、Thinking(思考)モードの有効・無効を切り替えられます。複雑な推論や数値計算、段階的な検討が必要な処理では有効にし、短い要約や定型的な文章生成では無効にするなど、用途に応じて調整できます。

またAPIキーの取得や環境構築、リクエスト送信といった基本的な流れは、他の生成AIにおけるAPIとほぼ同様のため、詳細な手順を公式サイトのチュートリアルを確認しながら進めるとよいでしょう。

参考:Alibaba Cloud Model Studio「OpenAI チャットインターフェイス互換性」

参考:Alibaba Cloud Model Studio「ディープシンキング」

Ollama、LM Studio、llama.cpp、MLX LMなどのツールを利用すると、開発者や上級者向けにPC上でQwen 3.5のモデルを動作させられます。

それぞれの詳細な手順は、公式サイト内の次のページに記載があるため、確認しながら進めるとよいでしょう。

| 主なローカル実行ツール | 手順の解説ページ |

| Ollama | オラマ – クウェン |

| LM Studio | LMスタジオ – Qwen |

| llama.cpp | llama.cpp – クウェン |

| MLX LM | MLX LM – Qwen |

ローカル環境で生成AIを利用する最大のメリットは、データを外部に送信する必要がなく、高いセキュリティを保ちながら利用できる点です。さらに、モデルや設定を自由にカスタマイズできるため、用途に応じた柔軟な運用ができます。

一方で、高性能なPC(GPUなど)が必要になる点や、環境構築に一定の知識が求められる点には注意が必要です。

参考:Qwen公式サイト

Qwen 3.5とはアリババクラウドが開発した、推論能力・エージェント性能・マルチモーダル処理を高水準で統合した次世代の大規模AIモデルです。

この記事も参考にして、ぜひQwen 3.5をさまざまな業務の現場で活用してみてください。

アイスマイリーでは、生成AI のサービス比較と企業一覧を無料配布しています。課題や目的に応じたサービスを比較検討できますので、ぜひこの機会にお問い合わせください。

業務の課題解決に繋がる最新DX・情報をお届けいたします。

メールマガジンの配信をご希望の方は、下記フォームよりご登録ください。登録無料です。

AI製品・ソリューションの掲載を

希望される企業様はこちら