生成AI

最終更新日:2026/04/07

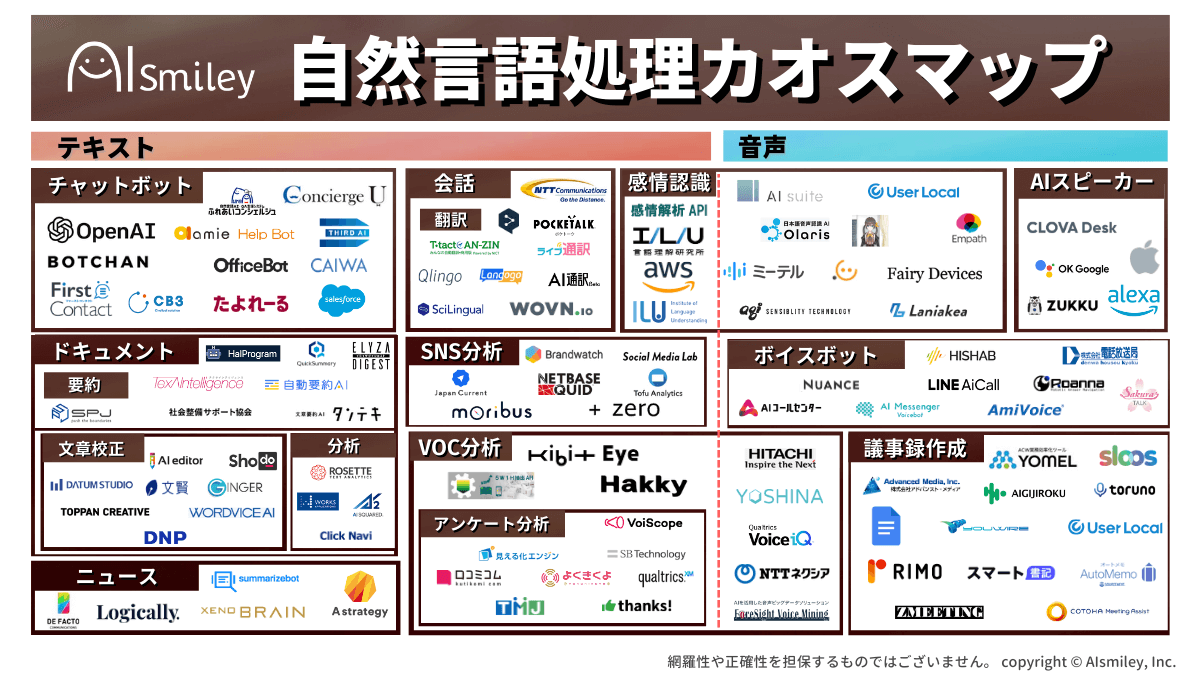

自然言語処理(NLP)とは?

自然言語処理(NLP)とは?

自然言語処理(NLP)とは、人間が日常的に使う日本語や英語などの言葉を、コンピュータが理解・解析・生成できるようにする技術です。メール・チャット・議事録・FAQ・音声データなど、企業に蓄積される大量の非構造化データを扱う上で欠かせない基盤技術として活用が広がっています。

この記事では、自然言語処理の基本から仕組み、代表的なモデル、活用事例、導入時の注意点、最新動向までをわかりやすく解説します。

AIソリューションについて詳しく知りたい方は以下の記事もご覧ください。

AIソリューションの種類と事例を一覧に比較・紹介!

自然言語処理(NLP:Natural Language Processing)とは、人間が日常的に使う日本語や英語などの「自然言語」を、コンピュータが理解・解析・生成できるようにする技術分野です。自然言語は、プログラミング言語のような人工言語とは異なり、人間社会の中で自然に発展してきた言葉を指します。

自然言語処理は、こうした言葉をコンピュータで扱いやすい形に変換し、意味や意図を捉えた上で、検索、分類、要約、翻訳、対話などに活用するための基盤技術です。

現在の自然言語処理は、単なる文字列処理にとどまりません。機械翻訳、音声認識、テキスト要約、感情分析、チャットボット、質問応答システムなど、私たちが日常的に触れる多くのAIサービスに使われています。

企業でも、顧客対応の自動化、社内文書検索、議事録要約、レビュー分析、ナレッジ活用など、幅広い業務で導入が進んでいます。

自然言語処理は「人間の言葉を扱う技術領域」であり、機械学習(ML)は「データから規則やパターンを学習し、予測や判断を行う技術」です。

機械学習は、現代の多くのAIの基盤となる考え方であり、自然言語処理の精度向上にも広く使われています。つまり、自然言語処理と機械学習は別の概念ですが、現在は非常に密接に結びついています。

例えば機械翻訳では、自然言語処理が文章を単語や文脈の単位で捉え、どの表現がどの意味を持つのかを整理します。その上で機械学習が大量のデータから翻訳パターンを学習し、より自然な訳文を生成します。

現在の自然言語処理は、こうした機械学習、とくにTransformerや大規模言語モデル(LLM)の発展によって大きく進化しています。

自然言語処理が注目されている背景には、まずテキストデータの急増があります。メール、チャット、議事録、FAQ、SNS投稿、レビューなど、企業には大量の非構造化データが蓄積されています。

こうした情報を人手だけで整理・活用するのは難しく、自然言語処理によって意味を抽出し、業務に活かすニーズが高まっています。

次に大きいのが、汎用言語モデルや大規模言語モデルの進化です。

従来の自然言語処理は、分類や抽出など個別タスクごとに設計することが一般的でしたが、現在はLLMの登場によって、要約、検索支援、対話、翻訳、文章生成まで幅広く対応しやすくなりました。NLUやNLGを個別に実装する時代から、より統合的に扱う時代へ移っています。

さらに、DXの加速も大きな要因です。人手不足や業務効率化の必要性から、問い合わせ対応、文書確認、情報検索、ナレッジ共有といった「言葉を扱う業務」の自動化が進んでいます。

近年はRAGのように、社内文書など外部知識を参照しながら回答を生成する仕組みも広がっており、自然言語処理は企業の実務を支える中核技術として存在感を増しています。

2026年、自然言語処理分野は、単なる文章生成の高度化から、推論性能の強化、エージェント化、業務データとの接続へと焦点が移っています。

OpenAIは2025年8月にGPT-5を公開し、質問の複雑さやツール利用の必要性に応じて応答方式を切り替える統合型の設計を打ち出しました。さらに同年11月にはGPT-5.1を展開し、より自然な会話と適応的な推論を強化しています。

加えて、GPT-5は長いツール呼び出しや社内ファイルとの連携も重視しており、自然言語処理の活用は「高性能な応答」から「業務の中で使える実用的な応答」へと進化しています。

Googleも2025年11月にGemini 3を発表し、LMArenaで1501 Eloを記録するなど、推論とマルチモーダル性能を大きく向上させました。

さらに、2026年2月公開のGemini 3.1 Proでは、テキスト、画像、音声、動画、コードリポジトリまで扱うネイティブなマルチモーダル推論を強化しています。

あわせてGoogleはGemini APIにFile Search Toolを追加しており、企業データを参照しながら回答精度を高めるRAG(検索拡張生成)の実装も進みやすくなっています。

2026年の自然言語処理は、LLM単体の性能競争だけでなく、外部知識や社内データを接続して正確性と再現性を高める方向へ進化しているのが大きな特徴です。

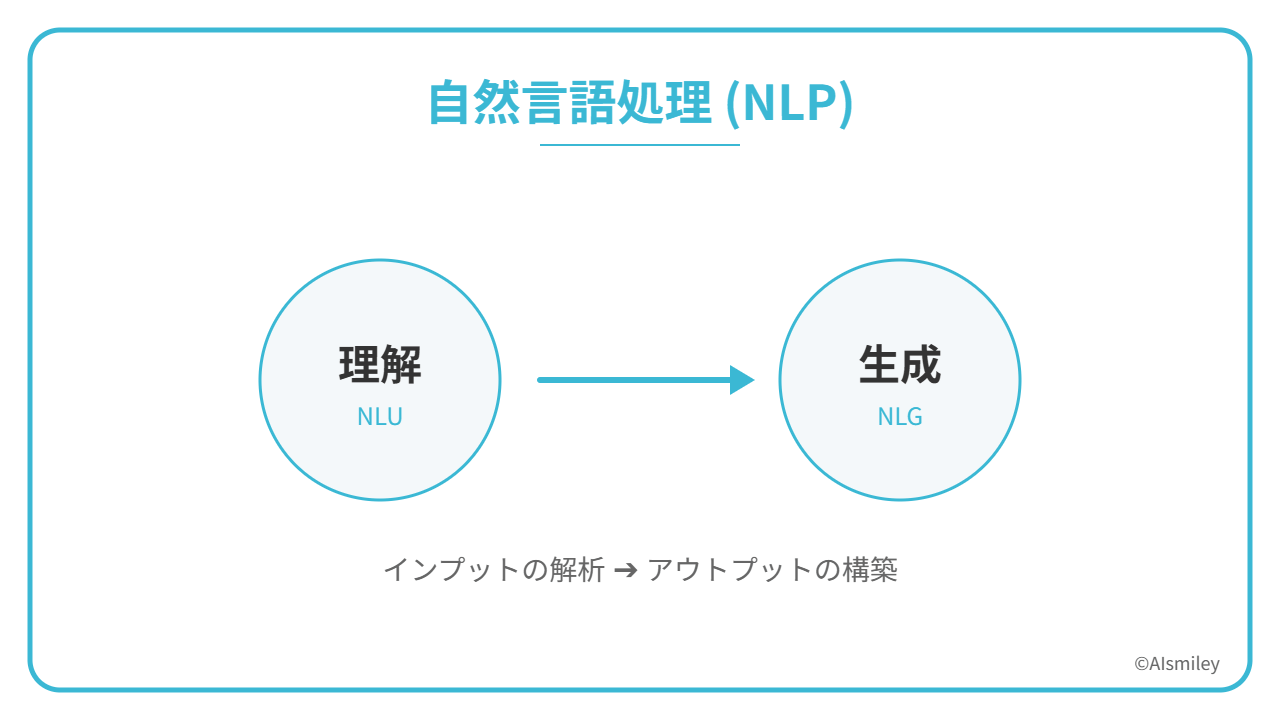

自然言語処理(NLP)は、人間が使う言葉をコンピュータが理解・解析・生成するための技術です。主な領域としては、自然言語理解(NLU)と自然言語生成(NLG)が挙げられます。

ただし、現在の実務ではこの2つだけで完結するのではなく、検索、要約、情報抽出、対話、翻訳などの機能と組み合わせて活用されるのが一般的です。IBMも、NLUとNLGはNLPを構成する要素だと説明しています。

自然言語理解は自然言語処理の一分野であり、テキストや音声の構文・意味を解析して文意を判別する技術です。

例えば、問い合わせ文の内容をもとに適切な担当部署へ振り分けたり、レビューやアンケートの自由記述からポジティブ・ネガティブの傾向を分析したり、文章中に出てくる企業名・商品名・人名などの重要語を抽出したりする処理は、NLUの代表的な活用例です。Google Cloudでも、自然言語理解の主な機能として感情分析、エンティティ分析、分類、構文解析などを挙げています。

自然言語理解は、関連する「オントロジー」も構築していくことが特徴として挙げられます。オントロジーとは、語と句の間の関係を指定するデータ構造のことです。人間は、日常会話においてごく自然にこのオントロジーを行っていますが、機械が人間と同じようにさまざまなテキストの意味を理解するためには、これらの分析を組み合わせなければなりません。

自然言語生成(NLG)も、自然言語処理の一分野です。自然言語生成はコンピュータに自然な文章を構築させる技術です。

自然言語生成は、あるデータ入力に基づき、人間の言語によってテキスト応答を生成していくプロセスを指します。ここでテキストが生成されたら、音声合成サービスを介して音声の形式に変換していくことも可能です。自然言語生成 には、テキストの要約機能も含まれます。

これは、情報の整合性を保ちながら入力された文書の要約を生成する仕組みで、AI によって可能になった革新的技術として大きな注目を集めています。

従来の自然言語生成(NLG)システムは、あらかじめ用意した「本日の売上は◯◯円です」のようなテンプレートの空欄に、データベースから取得した数値や文字列を当てはめる方式が主流でした。

しかし近年は、再帰型ニューラルネットワーク(RNN)やTransformer(トランスフォーマー)といった深層学習モデルが利用できるようになり、テンプレートに頼らず、文の構成や言い回しも含めてリアルタイムに文章を生成できるようになってきました。

現在の自然言語処理では、NLUとNLGを別々に使うよりも、両者を組み合わせて活用するケースが増えています。

例えば、ユーザーの質問の意図を理解し、関連する社内文書やFAQを検索し、その内容をもとに自然な回答文を生成する、といった流れです。こうした仕組みは、チャットボットや社内検索、問い合わせ対応の高度化で広く使われています。

特に近年は、LLMが外部の知識ベースや社内文書を参照して回答するRAG(検索拡張生成)が注目されています。AWSはRAGについて、LLMが学習データの外にある信頼できる知識ベースを参照してから応答を生成する仕組みだと説明しています。これにより、より正確で実務に使いやすい回答を返しやすくなります。

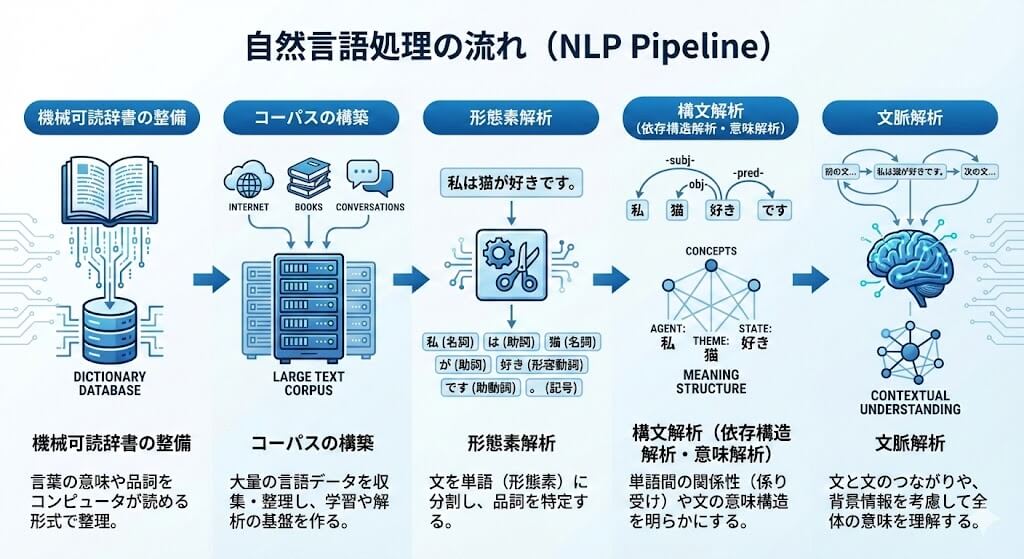

自然言語処理は、前処理から最終的な文脈理解に至るまで、いくつかの段階を順に踏んで進みます。

具体的な流れは、以下のとおりです。

機械可読辞書とは、コンピュータが単語や語彙の情報を扱えるように整理した辞書データのことです。特に日本語は英語のように単語の区切りが明確ではないため、単語分割や品詞判定の精度を高めるために辞書情報が重要な役割を果たします。

従来の自然言語処理では、この機械可読辞書の整備が重要な出発点でした。専門用語、固有名詞、新語などを辞書へ反映することで、形態素解析や情報抽出の精度を高めるアプローチが広く使われてきました。

一方で現在は、TransformerやLLMの発展により、辞書だけに依存せず、前後の文脈から意味を捉える手法が主流になっています。機械可読辞書は「自然言語処理の必須の第一段階」というより、日本語処理や専門分野で精度を補強する重要な要素の一つとして位置づけるのが自然です。

コーパスとは、コンピュータが言語を分析・学習するために集められた大量の文章データの集合です。自然言語処理では、このコーパスをもとに、単語の使われ方や文脈、言い回しの傾向などを学習します。

従来は、自社や研究用途に合わせてコーパスを整備し、それをもとに分類器や解析モデルを作る流れが一般的でした。現在も学習データの質は重要ですが、近年は事前学習済みモデルやLLMを活用し、必要に応じて追加学習やプロンプト設計、RAGで補うケースが増えています。

つまり、コーパスは今でも重要ですが、役割は「一から全てを学習させる土台」から、「モデルを業務に最適化するための知識資源」へと広がっています。

形態素解析とは、文章を意味を持つ最小単位に分割し、それぞれに品詞などの情報を付与する処理です。日本語では単語間に空白がないため、文章をどこで区切るかを判断すること自体が重要になります。

「黒い目の大きい金魚」という言葉を例に解説します。

この「黒い目の大きい金魚」というフレーズは、「黒い」「目」「の」「大きい」「金魚」という形態素で分割できます。このように分割する作業を「形態素解析」と呼びます。

形態素解析を行うことで文字列を単語ごとに分割し、それぞれの形態素に「形容詞」「名詞」「助詞」といった品詞を適切に割り当てていくことが可能になります。ただし、どれくらい詳細な品詞を割り当てるかどうかは形態素解析を行うツールの仕様や設定方針によって異なるため、一概には言えません。

現在の自然言語処理では、従来型の形態素解析に加えて、サブワード単位のトークン化も広く使われています。特にLLMでは、単語そのものではなく、より細かな単位に分解して扱うことで、未知語や表記ゆれにも対応しやすくしています。

構文解析とは、形態素解析で分割された語同士が、文の中でどのような関係にあるか(どの語がどの語に係るか)を調べる工程のことです。日本語の構文解析では、形態素解析によって分割された単語同士の関連性を解析した上で、「文節間の係り受け構造を見つけてツリー化(図式化)していくこと」が主な目的となっています。

ここでは、構文構造を求める代表的な手法である「依存構造解析」と、その結果を用いて意味を解釈する「意味解析」について説明します。

構文解析とは、形態素解析で分割した語同士が、文の中でどのような関係にあるのかを調べる工程です。どの語がどの語にかかっているか、主語と述語はどれか、修飾関係はどうなっているかを明らかにすることで、文全体の構造を把握しやすくなります。Google CloudのNatural Language APIでも、構文解析は主要機能の一つとして扱われています。

従来の自然言語処理では、構文解析は文章理解の中核的な工程でした。現在でも基礎概念として重要ですが、近年はTransformer系モデルが文全体の関係性をまとめて学習するため、実装上は構文解析の情報を明示的に分けずに扱うケースも増えています。

依存構造とは、単語や文節間における「修飾・被修飾関係」「係り受け関係」などの依存関係をもとに、文章の構造を表したものです。

単語・文節を接点とするツリーによって表現されます。文章内における「単語間の係り受け関係」を調べた上で、「どの単語がどの単語に係るのか」を構文的に解析していく作業です。日本語の構文的依存構造関係について出力していく構文解析器(parser)としては、CaboChaやKNPなどが挙げられます。

現在は、こうした依存関係も含めてモデルが内部表現として学習することが多く、従来のように明示的な解析結果だけに頼らない実装も一般的になっています。

意味解析とは、構文解析された文章内の意味を解釈していく工程のことです。日本語の場合、ひとつの文章を、複数の意味として解釈できるケースも少なくありません。たとえば、「私は冷たいビールとメロンが好きだ。」

この文章の場合、「私は|冷たい|ビールとメロン|が好きだ。」という解釈であればどちらも「冷たい」と認識できます。しかし、「私は|冷たいビール|と|メロン|が好きだ。」という解釈であれば、メロンが冷たいかどうかは言及されていないことになります。

このように複数の解釈ができる文章において、正しい解釈を選択するために必要となるのが意味解析です。意味解析では、意味の概念を持たない機械に、自然言語の意味を正確に理解させる必要があります。

日本語は、ひとつの単語が複数の意味を持つことも多いため、他の単語とのつながりを踏まえた上で、適切な候補を選び出す必要があります。その候補を絞り込む作業は、非常に難易度が高い処理といえます。

現在は、意味解析を個別のルールで解くというより、TransformerやLLMが大量データから文脈と意味の対応関係を学習し、より自然に解釈する方向へ進んでいます。感情分析、エンティティ抽出、分類といった機能も、こうした意味理解の延長線上にあります。

文脈解析とは、文章の繋がり(文脈)を考えていく工程のことです。複数の文に対して「文同士のつながり」を解析するためには、文章の背景など複雑な情報も必要になります。

意味解析よりもさらに難易度は高いものの、近年は大規模言語モデル(LLM)などの発展により、チャットボットや要約、質問応答システムなどで文脈を踏まえた処理が実用レベルで行われるようになってきています。

近年の自然言語処理では、この文脈解析の精度が大きく向上しています。AWSはTransformerについて、系列内の要素同士の関係を追跡しながら文脈を学習するアーキテクチャだと説明しており、LLMはその仕組みを土台に長文や複数ターンの会話を扱えるようになっています。

これにより、チャットボット、要約、質問応答、翻訳などで、より自然で一貫した出力が可能になっています。

現在の自然言語処理では、形態素解析、構文解析、意味解析、文脈解析といった複数の工程を、LLMが統合的に扱うケースが増えています。従来は個別のルールやモデルで分けて処理していた内容を、単一の大規模モデルがまとめて扱えるようになったことで、実装の柔軟性と応用範囲が大きく広がりました。

そのため、2026年の自然言語処理を説明する際は、従来型の段階的な解析フローを基礎として押さえつつ、現在はTransformerやLLMが文脈理解を統合的に担っていることもあわせて示すのが適切です。

実務での自然言語処理では、モデルが学習済み知識だけで回答するのではなく、社内文書、FAQ、規程、マニュアルなどの外部知識を検索してから応答を生成するケースが増えています。AWSはRAGを、LLMがトレーニングデータの外にある信頼できる知識ベースを参照してから回答を生成する仕組みだと説明しています。

この考え方を取り入れることで、自然言語処理は単なる文章理解や生成にとどまらず、社内検索、問い合わせ対応、ナレッジ活用、文書要約など、より実務に直結した形で活用しやすくなります。

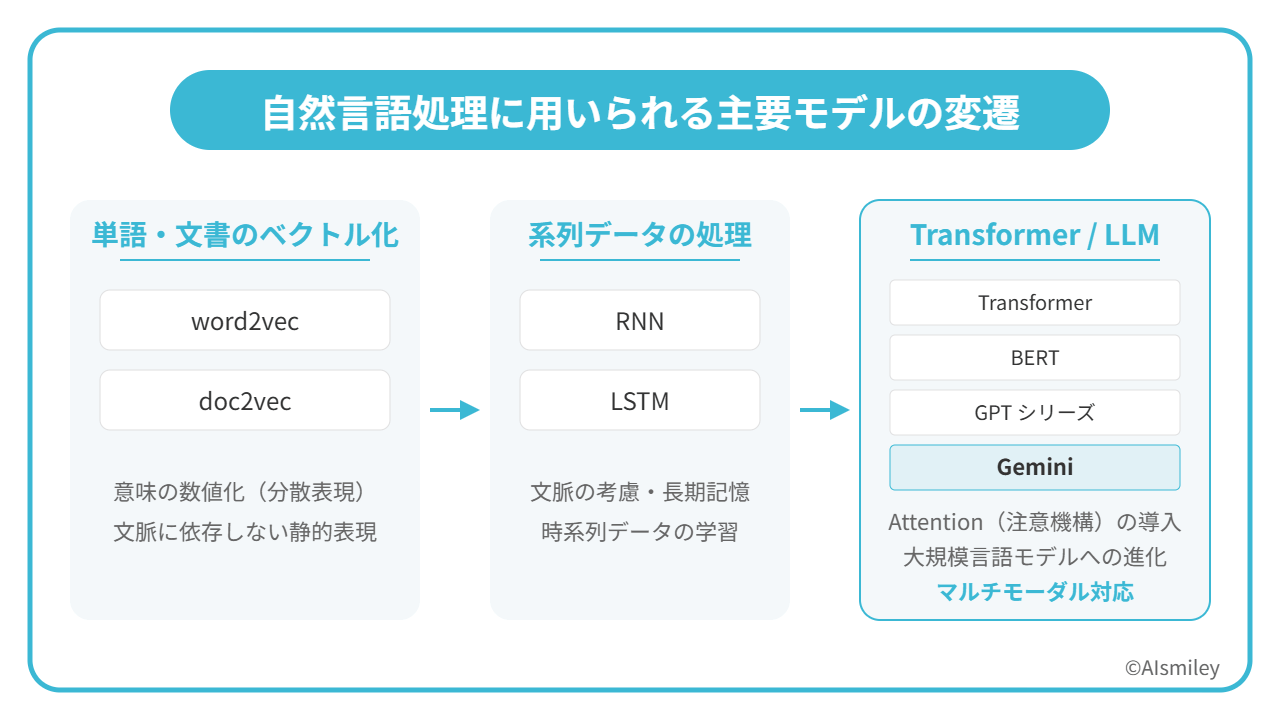

自然言語処理におけるモデルとは、人間の言語をコンピュータが理解・解析・生成するためのアルゴリズムや学習枠組みのことです。

初期は単語や文書をベクトル化する手法や時系列モデルが中心でしたが、現在はTransformerを基盤とするモデルが主流です。特にBERTは理解系タスク、GPTやGeminiは生成・対話・推論系タスクで大きな影響を与えてきました。

参考:”Efficient Estimation of Word Representations in Vector Space” Tomas Mikolov [2013]

参考:”Efficient Estimation of Word Representations in Vector Space” Tomas Mikolov [2013]

word2vecとは、単語を連続値のベクトルとして表現する代表的な手法です。2013年に提案され、単語の意味的・文法的な近さをベクトル空間で扱えるようにしたことで、自然言語処理の発展に大きく貢献しました。

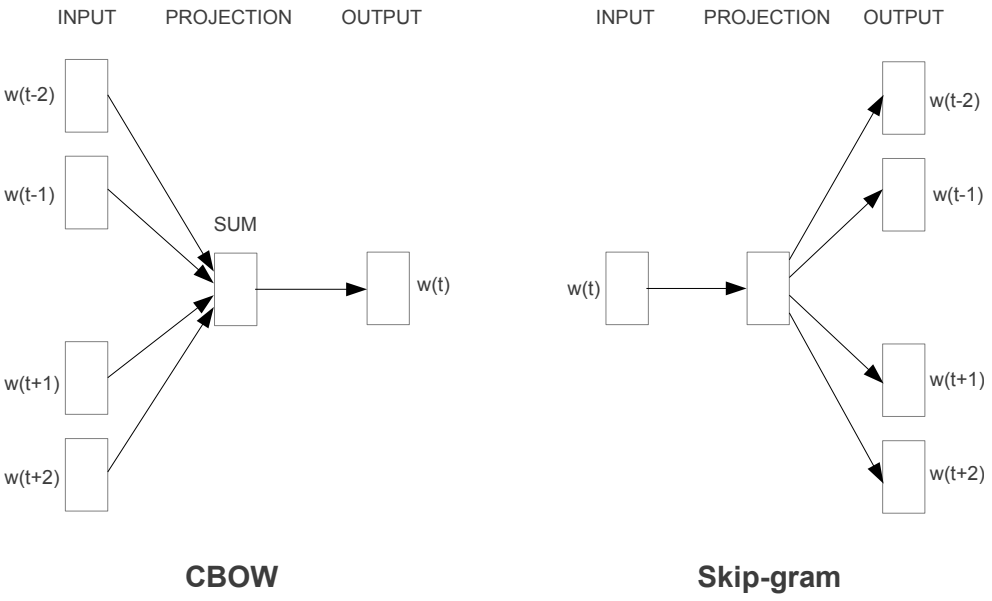

代表的な学習方式には、周辺語から中心語を予測するCBOWと、中心語から周辺語を予測するSkip-gramがあります。現在は文脈依存の埋め込みが主流ですが、word2vecは単語表現の基礎を理解するために重要なモデルです。

word2vecの仕組みを簡単に説明します。

たとえば「ぶどう、パイナップル、果物、ジュース」という単語をベクトル化し、以下のような数値になったとします。

ぶどう:8

パイナップル:6

果物:7

ジュース:3

これは、ベクトル化によって「ぶどう」に最も近いものが「果物」であり、「パイナップル」にもそれなりの類似性があることが示されています。

ちなみに、word2Vecは、大きく分けて2種類の論理的構造(アーキテクチャ)が存在しています。単語周辺の文脈から、その中心となる単語を推測していくCBOW。中心となる単語から、文脈の構成に重要となる要素を推測していくSkip-gramです。

doc2vecは、文章や文書全体を固定長ベクトルに変換するための手法です。2014年のParagraph Vectorの提案に基づくもので、Bag-of-Wordsのように語順や意味関係を落としやすい表現よりも、文書全体の特徴を捉えやすい点が評価されました。

以下の例をはじめとする多くの応用方法が存在します。

また、機械学習のモデルにおける入力には、固定長のベクトルが使用されるケースが多いため、事前にDoc2Vecで前処理を行なった上で、入力ベクトルにするケースも少なくありません。

これまでにもBag-of-wordsやLDAなど、文書を固定長の小さなベクトルにするテクニックは存在していましたが、Doc2Vecを利用することで、それらのテクニックを上回る性能を発揮することが報告されています。

現在はTransformer系のsentence embeddingsやdocument embeddingsに置き換えられる場面も増えています。

参考:Understanding LSTM Networks

参考:Understanding LSTM Networks

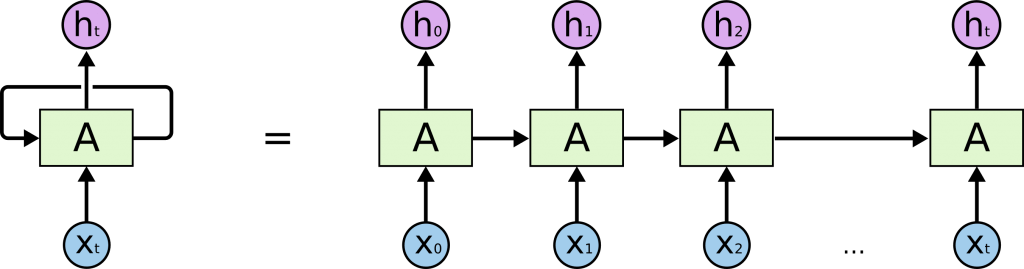

RNNとは、簡単に説明すると「過去のデータを使用できる」という特徴を持ったディープラーニングのことです。2016年9月にGNMTが公表され(深いLSTM=RNN系を採用)、その後Google翻訳に順次適用されました。これがGoogle翻訳の品質向上の主要因の一つと考えられます。

このようなRNNですが、動画や文章といった長い時系列データの場合、ネットワークが時系列長と比べて非常に深くなってしまうのも特徴のひとつです。そのため、情報が上手く伝達されないことも少なくありません。

そのような中で、ある程度の長い時系列データであっても学習できるように考案されたのが、次のLSTMと呼ばれるモデルです。

現在は主役ではありませんが、系列モデルの基礎として重要です。

参考:Understanding LSTM Networks

参考:Understanding LSTM Networks

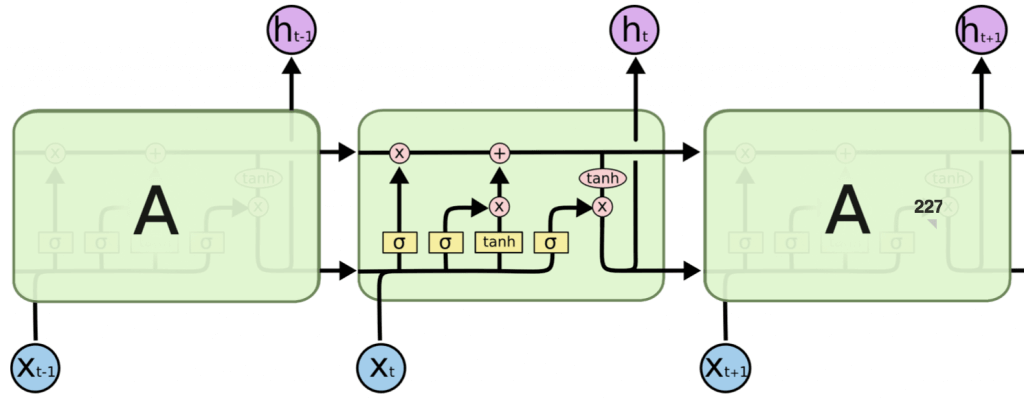

LSTMは、ある程度の長い時系列データでも学習ができるように考案されたモデルであり、「中間層にあるユニットをメモリユニットという要素で置き換えていること」が大きな特徴です。RNNの発展型であり、さまざまなタスクにおいて高い性能を発揮します。

LSTMは、長期の依存性という問題を回避できるよう設計されています。「長時間の情報の記憶」に関しては実質的にデフォルトの動作のため、学習に苦労することもありません。

自然言語処理では機械翻訳、音声処理、文章分類などで広く使われてきましたが、現在はTransformer系モデルに主役の座を譲っています。それでも、系列データを段階的に理解するモデルとしての重要性は今も変わりません。

トランスフォーマー(Transformer)とは、自然言語処理タスクにおける強力なネットワークです。2017年に登場したネットワークで、より素早く情報を集約できるSelf-Attention(自己注意機構)を備えています。

これまで、高精度かつ学習時間も短い従来のモデルにおいては、RNNやCNNを用いるのが一般的でした。しかし、Transformerでは、Attentionという機構だけでネットワークを構築している点が大きな特徴といえます。Attentionとは、簡単にいえば「文に含まれる単語の意味を理解する上で、どの単語に注目すれば良いのかを示すスコア」です。

入力されたデータに対してスコアリングを行い、重要性を考慮したベクトル量として出力していきます。たとえば、ある画像データが入力されて画像の説明を出力するとします。この場合、Attention機構は生成済みの単語のコンテキスト情報を前の隠れ層から受け取って「次の画像の注目ポイント」を推論します。

自己注意機構(Self-Attention)によって、文中のどの単語が他のどの単語と強く関係するかを効率よく捉えられるため、長文や複雑な文脈にも強く、現在のBERT・GPT・Geminiなど多くのモデルの基盤になっています。

BERTとは、Bidirectional Encoder Representations from Transformersを略した自然言語処理モデルであり、2018年10月にGoogle社のJacob Devlin氏らが発表したことで、大きな注目を集めました。日本語では「Transformerによる双方向のエンコード表現」と訳されています。

一般的に、翻訳や文書分類、質問応答といった自然言語処理における仕事の分野を「(自然言語処理)タスク」と呼びます。BERTは、この「タスク」において2018年当時の最高スコアを叩き出したことで注目されました。

BERTの特徴として、「文脈を読めるようになったこと」が挙げられます。Transformerと呼ばれるアーキテクチャ(構造)を組み込むことで文章を文頭・文末の双方向から学習し、文脈を読めるようになったのです。

現在はBERTそのものが最先端の中心ではないものの、検索、分類、抽出などの基礎モデルとして今も影響力が大きく、NLPの歴史を語る中で外せない存在です。

GPTシリーズ(Generative Pre-trained Transformer)は、OpenAIが開発する大規模言語モデルのシリーズです。2020年に登場したGPT-3は、約1,750億個のパラメータを持ち、人間が書いたような自然な文章生成を可能にし、大きな注目を集めました。

その後、テキストと画像を横断して処理できるマルチモーダル対応のGPT-4(2023年3月)、リアルタイム処理に優れたGPT-4o(2024年)へと進化。2025年8月には、質問の難易度に応じて応答と推論を自動で使い分けるGPT-5、さらに、より自然な会話と適応的な推論機能を備えたGPT-5.1が2025年11月に公開されました。

このようにGPTシリーズは、単なる文章生成モデルから、対話、要約、翻訳、検索支援、コーディング、エージェント的なタスク実行まで担う基盤モデルへと進化してきました。現在の自然言語処理においては、GPTシリーズは「人間らしい文章を書くモデル」という位置づけにとどまらず、文脈理解、推論、マルチモーダル処理、ツール連携まで含む中核的な存在になっています。

2026年は、OpenAIのAPIドキュメントでも最新のGPT-5系としてGPT-5.1が推奨されています。

Geminiは、Googleが展開するマルチモーダル大規模モデルのシリーズです。2023年12月に発表されたGemini 1.0を起点に、テキスト、画像、音声、動画、コードなど、複数の形式の情報を横断して理解・生成できるモデルとして進化してきました。

2024年にはGemini 1.5が登場し、長大なコンテキスト処理を強化したことで、長文の文書読解や大規模データの分析でも活用の幅が広がりました。

2025年にはGemini 2.5が発表され、Googleはこれを“thinking model”として位置づけ、複雑な推論やコード生成への対応を前面に打ち出しました。さらに同年11月にはGemini 3が公開され、GoogleはGemini 1でマルチモーダルと長文理解、Gemini 2で推論と思考、そしてGemini 3でそれらを統合した最も高性能なモデルだと説明しています。

Gemini 3は推論、マルチモーダル理解、ツール利用をさらに強化し、学習支援や業務支援など、より実用的な用途での活用が進んでいます。

2026年2月にはGemini 3.1 Proも発表され、複雑な問題解決に向けた基盤性能がさらに向上しました。加えて、GoogleはGemini APIにFile Search Toolなども展開しており、社内文書や外部知識を参照しながら回答する活用も進んでいます。

現在のGeminiシリーズは、単なる文章生成モデルではなく、自然言語処理、推論、マルチモーダル理解、ツール連携を統合した基盤モデルとして位置づけるのが適切です。

企業が自然言語処理を自社のシステムに組み込むことで得られるビジネス上の恩恵は、大きく分けて以下の3点に集約されます。これは単なるコスト削減にとどまらず、企業の競争力を高める「攻めのDX」を実現する強力な武器となります。

自然言語処理の最大の強みは、これまで人間が手作業で行っていた「テキストを読み込み、処理する」時間を劇的に短縮できる点です。

膨大な顧客からの問い合わせ対応、契約書の確認、長文の要約、アンケートのカテゴリ分類などをシステムで自動化することで、従業員はより高度でクリエイティブな「人間にしかできない判断業務」に集中できるようになります。

24時間365日稼働し、人間の言葉の揺らぎを理解するAIチャットボットや、ユーザーの検索意図を正確に汲み取る高度な検索システムにより、顧客は「欲しい情報」へ瞬時に到達できるようになります。

自然言語処理によって「待たせない」「的確に答える」サポート体制の構築は、顧客満足度やCV(コンバージョン)率の向上に直結します。

これまでファイルサーバーの奥深くに埋もれて活用されていなかった過去の議事録、マニュアル、ベテラン社員の問い合わせ対応履歴などを、瞬時に検索・要約し、対話形式で引き出せるようになります。

特定の担当者に業務が依存する「属人化」を解消し、組織全体のナレッジを底上げします。この自然言語処理の強みを最大限に引き出す実装手法として、現在「RAG(検索拡張生成)」が企業のスタンダードとなっています。

自然言語処理を活用してできることは、主に下表の通りです。

| 活用事例・できること | 概要 | |

|---|---|---|

| 検索エンジン | ユーザーの検索意図を理解し、関連性の高い情報を提供する | |

| エンタープライズサーチ(サーチ) | 企業内の大量の文書やデータから必要な情報を効率的に検索する | |

| 機械翻訳 | 二つの言語から別の言語へ、文脈を考慮して自然な翻訳を行う | |

| 文章要約 | 長文で重要なポイントを保持しながら短く要約する | |

| 対話型AI | AIチャットボット | 人間との対話を通じて質問に回答や問題解決を行う |

| ボイスボット | 音声による対話を通じて自然なコミュニケーションを実現する | |

| テキストマイニング | 大量のテキストデータから有用な情報やパターンを抽出する | |

| VoC分析 | 顧客の声を分析し、傾向や要望を把握する | |

| 感情認識・ネガポジ分析 | 文章から書き手の感情や評価の傾向を分析する | |

| 危険予知 | テキストデータから潜在的なリスクや危険を予測する | |

| 画像生成 | テキストの説明文から関連する画像を自動生成する | |

| メール文・記事作成 | 目的や要求に応じて文章を自動で作成する | |

| プログラミング | 自然言語に基づいてコードやプログラムを生成する | |

| AIスピーカー | 音声コマンドを理解し、適切な処理や操作を行う | |

| 感情認識 | 話者の声や文章から感情状態を判断する | |

| AI-OCRの精度向上 | 文字認識の精度を大幅に向上させる | |

活用事例から見ると、自然言語処理を活用するメリットには以下のようなものが挙げられます。

【自然言語処理の活用メリット】

自然言語処理の活用は、業務効率化、顧客体験向上、価値創造の三つの面で大きなメリットをもたらします。業務面では、エンタープライズサーチやAIチャットボットによる作業の自動化と効率化、24時間対応の実現が可能です。顧客対応においては、チャットボットやVoC分析を活用したリアルタイムの対応と顧客ニーズの把握により、カスタマイズされたサービス提供を実現します。

さらに、テキストマイニングによる意思決定支援や画像生成などのクリエイティブ支援により、新たな価値創造とリスク管理を可能にします。これらの総合的な効果により、企業の生産性向上と競争力強化を実現します。

自然言語処理を活用してできることについては、以下の記事でも詳しく解説しています。あわせて参考にしてみてください。

参考:自然言語処理でできることとは?最新AIで可能なテキスト解析・生成の活用シーンを紹介

近年飛躍的に進化した自然言語処理ですが、実業務への導入にあたってはいくつかの越えるべき壁が存在します。導入を成功に導くためには、AIの限界を正しく理解し、運用でカバーする設計が求められます。

自然言語処理における最大の難所は、人間の言葉が持つ「曖昧さ」です。同じ表現であっても、前後の文脈や発言者の立場、業界特有の慣習によって意味は大きく変化します。

現在のAI技術をもってしても、このニュアンスを100%機械的に汲み取ることは依然として簡単ではなく、誤解釈のリスクを前提とした業務プロセスの設計が必要です。

大規模言語モデル(LLM)を活用した自然言語処理で最も警戒すべきなのが「ハルシネーション」です。クラウド最大手のAWSも、「LLMは答えが存在しない場面で誤った情報を生成したり、古い情報を事実として返したりするリスクがある」と明確に警鐘を鳴らしています。

こうした弱点を補強し、事実に基づいた回答を生成させるには、自社の信頼できる知識ベース(社内データなど)を強制的に参照させる「RAG(検索拡張生成)」の構築が不可欠となります。

企業が自然言語処理を本格導入する際、単なる「回答精度」の検証だけでは不十分です。

機密情報を扱うための情報漏えい対策や、部署・役職に応じた厳格な権限管理、そして「AIの回答が業務にどう貢献したか」を測る評価指標(KPI)の設計が欠かせません。「どの社内情報を根拠にさせたか」「どの部門で利用させるか」に加え、「AIが誤答した際に、人間がどうフォローアップするか」という例外処理のフローまでを含めて設計することが、実運用を成功させる最大の鍵となります。

自然言語処理の技術トレンドは、単なるテキストデータの解析から、より人間に近い「高度な推論」「エージェント化(自律的な業務実行)」、そしてテキスト・音声・画像を統合して理解する「マルチモーダル化」へと劇的な進化を遂げています。

たとえば、OpenAIの「GPT-5」および「GPT-5.1」は、複雑な論理推論や外部ツールの高度な利用に対応し、Googleの「Gemini 3」も推論・マルチモーダル理解・エージェント機能を前面に打ち出すなど、自然言語処理を牽引する大規模言語モデル(LLM)の競争は新たな次元に突入しました。

こうした最新の自然言語処理をビジネスに実装する上で、現在最も重視されている設計思想があります。それは「LLM単体ですべてを完結させない」ということです。

現在のAIプロジェクトにおいて、ビジネスの成果を分ける決定的な要因は「どれだけ高性能なAIモデルを使うか」ではなく、「いかに自社の正しい情報源(データ)にAIを接続させるか」へとシフトしています。自然言語処理を真の意味で業務効率化や利益につなげるためには、この「外部連携を前提としたシステム設計」が不可欠です。

自然言語処理(NLP)は、人間の言葉をコンピュータが深く理解し、活用・生成するためのAIの中核技術です。近年はLLM(大規模言語モデル)の飛躍的な進化により、AIチャットボット、高精度な要約や翻訳、社内文書検索、VoC(顧客の声)分析、ナレッジマネジメントなど、ビジネス現場における自然言語処理の実用性は劇的に高まりました。

一方で、自然言語処理を用いたAIツールは「ただ導入すれば自動的に成果が出る魔法のツール」ではありません。

実業務で確かな投資対効果(ROI)を生み出すためには、以下のポイントを網羅した運用設計が不可欠です。

これらを前提とした全体設計を行ってはじめて、抜本的な業務改善や顧客体験(CX)の向上につながります。自然言語処理の特性と限界を正しく理解し、自社の課題解決に最も適した形で導入計画を進めていきましょう。

AISmileyではG検定を取得したコンサルタントによる無料相談を承っております。社内の蓄積したアンケートの分析や過去の技術文書へのアクセスを容易にするなどAIを活用してみませんか?他社の動向や事例集のプレゼントもありますので、お気軽にお問い合わせください。

AIについて詳しく知りたい方は以下の記事もご覧ください。

AI・人工知能とは?定義・歴史・種類・仕組みから事例まで徹底解説

業務の課題解決に繋がる最新DX・情報をお届けいたします。

メールマガジンの配信をご希望の方は、下記フォームよりご登録ください。登録無料です。

AI製品・ソリューションの掲載を

希望される企業様はこちら