生成AI

最終更新日:2026/03/10

OpenAI GPT‑5.4発表

OpenAI GPT‑5.4発表

OpenAIは、ChatGPT、APIおよびCodexにおいて、新モデル「GPT-5.4」をリリースしました。業務用途を想定した高性能モデルで、最小限のやり取りで求められた成果を提供できるよう設計されています。

このニュースのポイント

米OpenAI社は、「GPT‑5.4 Thinking 」としてChatGPT、そしてAPIおよび Codex において、「GPT‑5.4」をリリースしました。

新モデル「GPT-5.4」は、業務用途を想定したOpenAIで最も高性能かつ効率的なフロンティアモデルです。複雑なタスクで最大限のパフォーマンスを求めるユーザー向けに、ChatGPTとAPIで「GPT-5.4 Pro」も提供されます。

「GPT-5.4」は、推論、コーディング、エージェント型ワークフローにおける最近の進歩の成果を、1つのフロンティアモデルに統合しています。「GPT-5.3-Codex」の最先端コーディング能力も取り入れられており、ツールやソフトウェア環境、スプレッドシート、プレゼンテーション、ドキュメントを扱う業務タスクの処理能力も改善されています。

その結果、複雑な実務を正確かつ効率的に処理できるモデルとなり、より少ないやり取りで成果を得られるようになりました。

ChatGPTでは「GPT-5.4 Thinking」により、回答の前に思考の計画を提示できるようになりました。回答途中でも進行方法を調整できるため、追加のやり取りを増やすことなく、目的に近い結果へ導きやすくなります。

また、「GPT-5.4 Thinking」はウェブ調査能力も強化されており、特に具体的なクエリで効果を発揮します。長い思考が必要な質問でも、文脈をより適切に維持できるようになりました。

これらの改善により、より高品質な回答を迅速に提供できるようになり、タスクとの関連性も維持しやすくなりました。

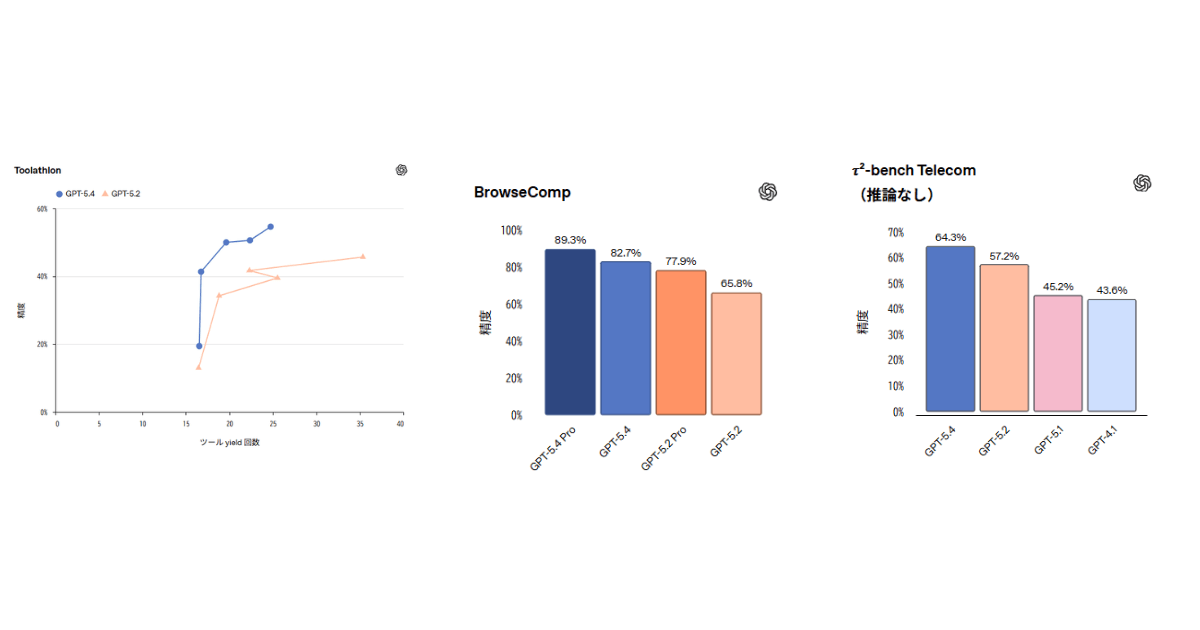

CodexとAPIでは、「GPT-5.4」はネイティブのコンピュータ操作能力を備えたOpenAI初の汎用モデルとして提供されます。エージェントがコンピュータを操作し、複数のアプリケーションを包括する複雑なワークフローを実行できるようになります。

さらに、「GPT-5.4」は最大100万トークンのコンテキストをサポートし、エージェントが長期間にわたるタスクの計画、実行、検証にも対応します。加えて、Tool searchの導入により、大規模なツールやコネクターのエコシステムでも効率的に動作できるようになりました。

これにより、エージェントは適切なツールをより効率的に選択可能です。

「GPT-5.4」は、これまでで最も効率的なリーズニングモデルでもあります。「GPT-5.2」と比較して問題解決に必要なトークン数を大幅に削減し、処理速度の向上とコスト削減を実現しました。

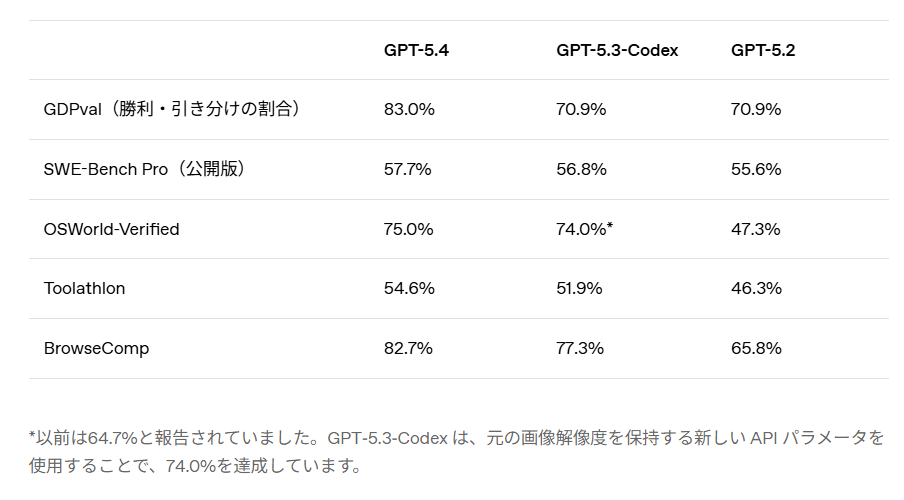

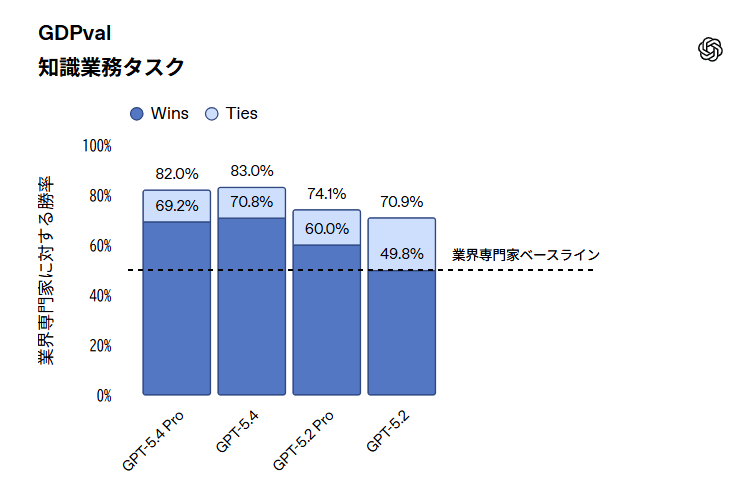

知識業務では、「GPT-5.2」の汎用推論能力を基盤にしながら、専門職の実務に近いタスクでより一貫性のある成果を生み出します。44職種の知識業務を評価するベンチマーク「GDPval」では、「GPT-5.4」は83.0%を記録し、「GPT-5.2」の71.0%を上回りました。

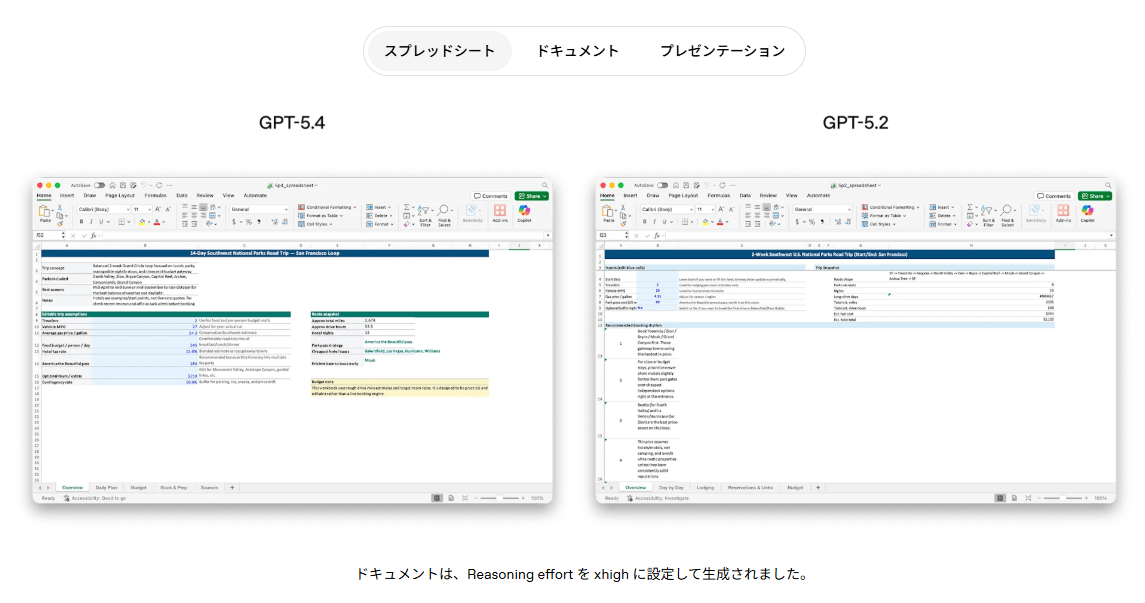

「GPT‑5.4」では、スプレッドシート、プレゼンテーション、ドキュメントの作成・編集能力も強化されています。投資銀行アナリストの業務を想定した社内ベンチマークでは、「GPT-5.4」は平均87.5%を記録し、「GPT-5.2」の68.4%を大きく上回りました。

プレゼンテーション評価では、68.0%の比較で評価者が「GPT-5.4」の成果物を「GPT-5.2」より好むと回答しました。デザイン性や視覚表現の多様性、画像生成の活用が評価されています。

OpenAIは、ハルシネーションや誤りの削減にも取り組んでいます。ユーザーが誤りを指摘した匿名化プロンプトで評価した結果、「GPT-5.4」は「GPT-5.2」と比べて、個々の主張が誤っている確率が相対的に33%低下しました。回答全体に誤りが含まれる確率も18%低下しています。

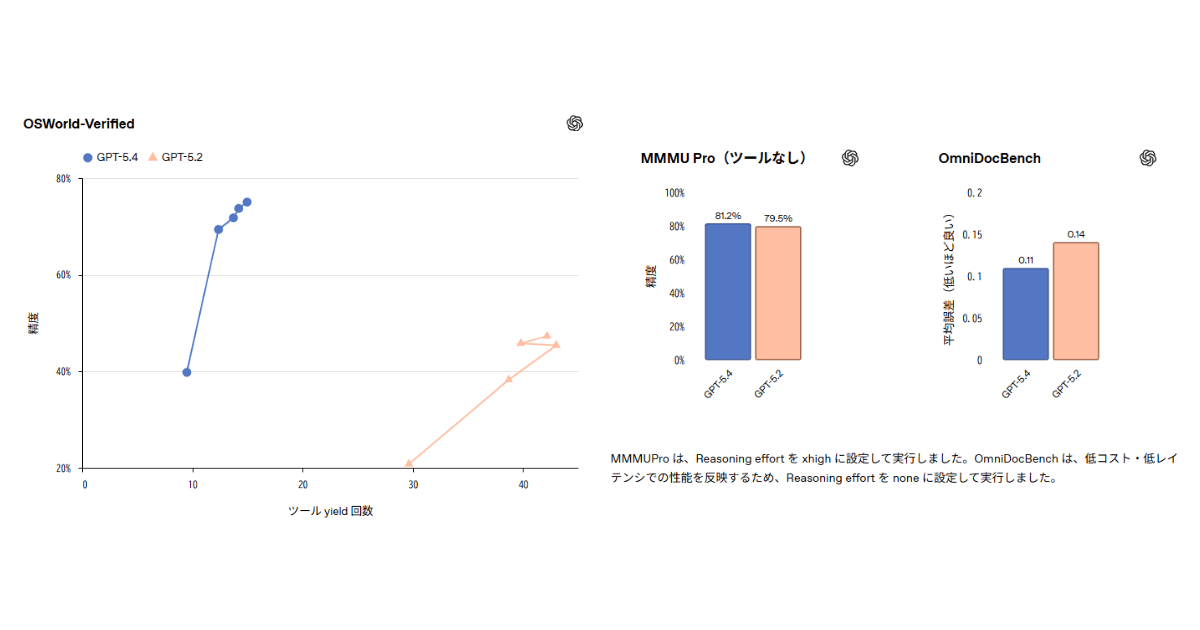

今回、「GPT-5.4」ではコンピュータ操作能力も大きく向上しました。デスクトップ操作を評価するOSWorld-Verifiedでは、「GPT-5.4」は成功率75.0%を記録し、「GPT-5.2」の47.3%を大きく上回りました。

視覚理解能力も改善されており、視覚推論ベンチマークMMMU-Proでは成功率81.2%を記録。「GPT-5.2」の79.5%を上回りました。文書解析ベンチマークOmniDocBenchでも平均誤差が0.109となり、「GPT-5.2」の0.140から改善しています。

また、高密度・高解像度画像の視覚理解も強化されました。「GPT-5.4」では新たにoriginalの画像入力ディテールレベルが導入され、総画素数1,000万ピクセルまたは解像度6Kのいずれか低い方まで対応します。

さらに、highディテールレベルでも、総画素数256万ピクセルまたは最大辺2,048ピクセルまでネイティブに対応します。APIユーザーとの初期テストでは、位置認識や画像理解、クリック精度の向上が確認されています。

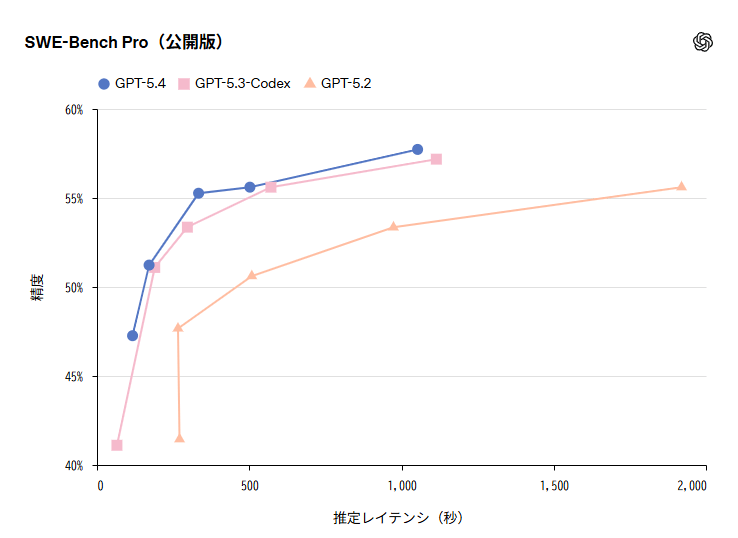

SWE-Bench Proでは、「GPT-5.3-Codex」と同等以上の性能を示しながら、より低いレイテンシを実現しました。加えて、Codexでは「/fast」モードを利用することで、最大1.8倍の高速処理が可能です。モデルの能力はそのままに処理速度のみを向上させ、コーディングやデバッグ作業を効率化できます。

OpenAIは、モデルの安全性向上にも継続的に取り組んでいます。サイバーセキュリティ能力がデュアルユースとなる点を踏まえ、分類器の改善やポリシー調整を続けています。

加えて、推論過程の監視研究の一環として、Chain-of-Thoughtの制御可能性を評価する新しいオープンソース評価「CoT controllability」も公開しました。「GPT-5.4 Thinking」は推論の隠蔽能力が低いことが確認されており、安全性の観点から望ましい特性とされています。

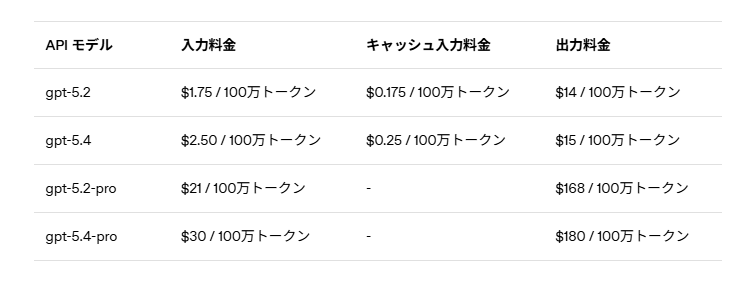

「GPT-5.4」は2026年3月5日から、ChatGPTとCodexで段階的に提供されています。APIでは同日より「gpt-5.4」として利用可能です。

ChatGPTでは「GPT-5.4 Thinking」がPlus、Team、Proユーザー向けに提供されており、EnterpriseおよびEduプランでは管理者設定から早期アクセスを有効化できます。「GPT-5.4 Pro」はProおよびEnterpriseプランで利用可能です。

出典:OpenAI

業務の課題解決に繋がる最新DX・情報をお届けいたします。

メールマガジンの配信をご希望の方は、下記フォームよりご登録ください。登録無料です。

AI製品・ソリューションの掲載を

希望される企業様はこちら