生成AI

最終更新日:2024/12/23

OpenAI o3モデルを発表

OpenAI o3モデルを発表

OpenAIは、12日間に渡り開催してきたイベント「12 Days of OpenAI」の最終日に新たなAIモデル「o3」を発表しました。

このニュースのポイント

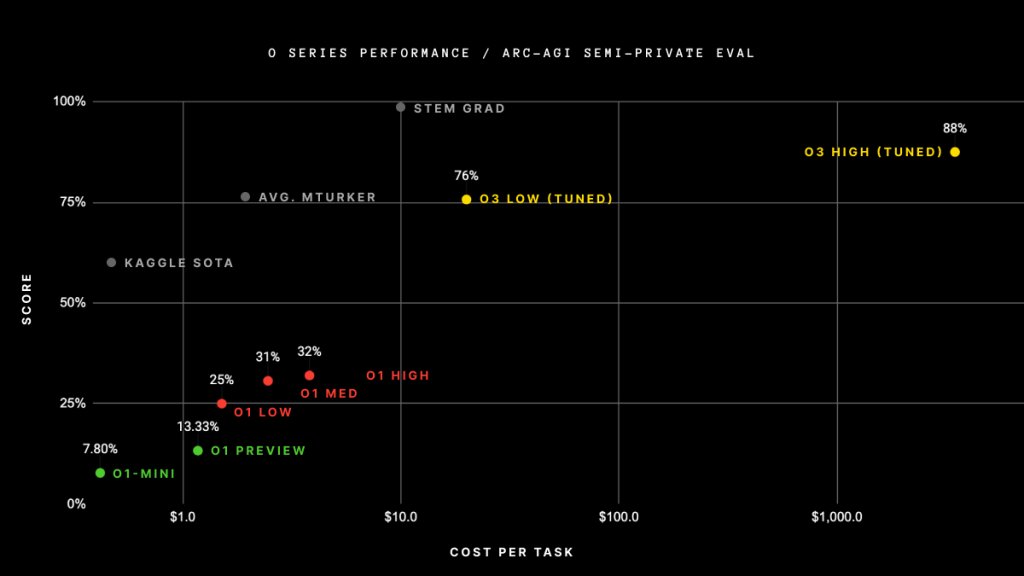

OpenAIは、「12 Days of OpenAI」の最終日に新たなAIモデル「o3」を発表しました。現在一般公開している「o1」よりも性能が高く、汎用人工知能(AGI)としての性能を評価するベンチマークにおいてもハイスコアを記録しています。

「o3」の性能は、コーディング、数学、科学的推論などの分野で高いスコアを記録しており、さらにAGIのベンチマーク「ARC-AGI」では、最大87.5%のスコアを記録しています。

「o3」のほかに、小型モデルの「Open AI o3-mini」も発表。より高速でコーディングに最適化されているo3シリーズとなり、2025年初頭から使用可能になる予定です。

These improvements in capabilities can also be leveraged to improve safety. Today we’re releasing a paper on deliberative alignment that shares how we harnessed these advances to make our o1 and o3 models even safer to use. https://t.co/tX8GkVOVdA

— OpenAI (@OpenAI) December 20, 2024

また、OpenAIは「Deliberative alignment(熟慮的アラインメント)」という新たなアライメント戦略を導入し、安全な言語モデルを実現しました。従来のLLMは、有害なコンテンツを生成したり、悪意あるプロンプトにだまされたりするなどの安全に関する問題を抱えていましたが、「Deliberative alignment」により、人間が書いた安全仕様を推論に組み込むことで、モデルがユーザーのプロンプトに基づいて関連ポリシーを反映し、安全な応答の生成が可能になります。

「o1」モデルの安全性を、GPT-4o、Claude 3.5 Sonnet、Gemini 1.5 Proと比較した結果、「o1」は多くの厳しい安全性評価をクリアし、有害な出力を回避しつつ無害なプロンプトに対してより寛容であることが示されました。さらに、慎重な調整による安全性トレーニングにより、未知の安全性シナリオに対する一般化能力も強化されています。

出典:OpenAI

業務の課題解決に繋がる最新DX・情報をお届けいたします。

メールマガジンの配信をご希望の方は、下記フォームよりご登録ください。登録無料です。

AI製品・ソリューションの掲載を

希望される企業様はこちら