生成AI

最終更新日:2026/03/30

Gemini 3.1 Flash-Liteとは?

Gemini 3.1 Flash-Liteとは?

Google は 2026年3月、高速処理が可能で、コストパフォーマンスに優れた最新の生成AIモデル「Gemini 3.1 Flash-Lite」を公開しました。性能とコストのトレードオフを解消するとされる当モデルは、業務活用の有力な選択肢として注目されています。

本記事では、Gemini 3.1 Flash-Liteの概要や前モデルからの進化、料金、活用シーンについて整理します。AI導入の判断に役立つ情報を網羅していますので、ぜひ参考にしてください。

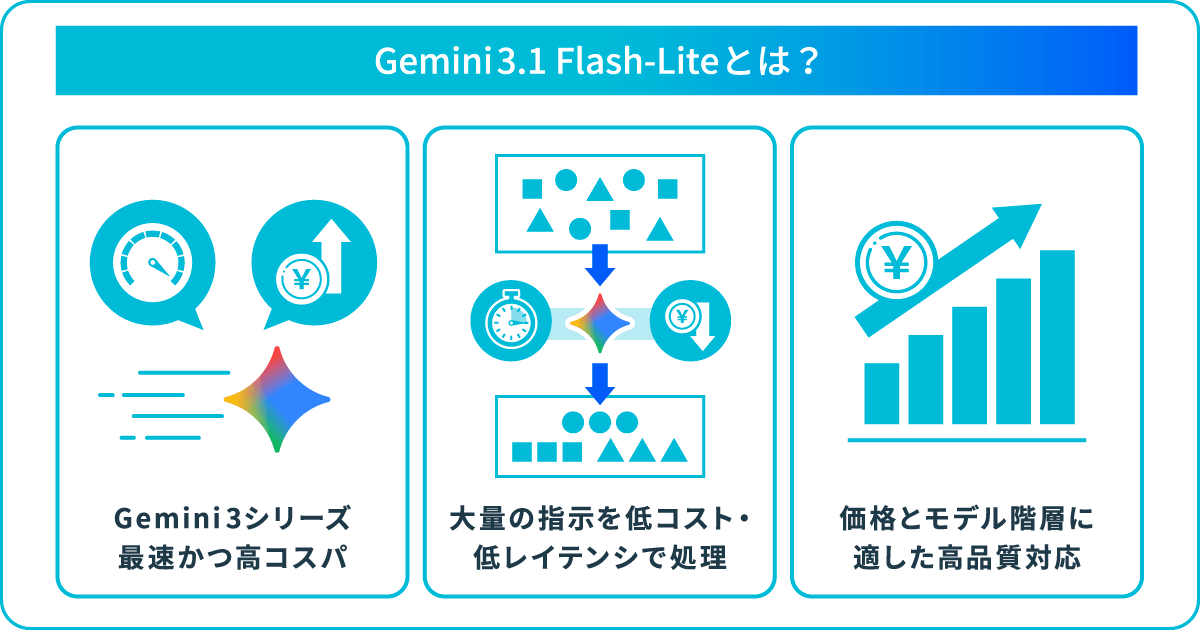

Gemini 3.1 Flash-Liteは、Googleが公開したGemini シリーズの中でも最もコストパフォーマンスと処理速度に優れた最新モデルです。Google AI Studio(Gemini API)および、Vertex AI経由でプレビュー版が利用できます。

関連記事:Geminiとは何か?──GoogleのマルチモーダルAIの全貌を初心者にもわかりやすく解説

前モデルのGemini 2.5 Flashと比較すると、3.1 Flash-Liteはスピード・精度・機能の3点において進化が見られます。

主な比較ポイントを以下の表で整理します。

| Gemini 2.5 Flash | Gemini 3.1 Flash-Lite | |

| 出力速度 | 249トークン/秒 | 363トークン/秒 |

| 初回応答速度 | 基準 | 2.5倍 |

| 高速入力料金(1Mトークン) | $0.30 | $0.25 |

| 出力料金(1Mトークン) | $2.50 | $1.50 |

| Thinkingレベル | あり | あり(4段階) |

| コンテキストウィンドウ | 100万トークン | 100万トークン |

推論スピードにおいては、Gemini 2.5 Flashと比較して出力速度が約45%向上し、最初の回答が返るまでの時間も2.5倍ほど速くなりました。

また、大量のリクエストを処理する業務では、スピード差によってシステム全体のレスポンスが向上しています。

さらに、入出力ともに前モデルより料金が下がり、コストメリットがさらに拡大しました。

Thinkingレベルとは、AIが1つの問いに対してどれだけ深く考えるかを制御できる機能です。タスクの複雑さに応じてレベルを切り替えることで、処理コストと回答品質のバランスを調整できます。

Thinkingレベルは、「minimal・low・medium・high」の4段階に分けられます。

各レベルの特性と適切なユースケースは以下のとおりです。

| レベル | 処理の特性 | 向いている業務の例 |

| minimal | 最速・最安定型 | 翻訳、テキスト分類、コンテンツの可否 |

| low | 軽い推論。速度とコストを優先 | 要約、FAQ自動応答、商品タグ付け |

| medium | 中程度の推論。バランス型 | 資料分析、複数条件が絡む問い合わせ対応 |

| high | 深い推論。精度優先 | UI画面の自動生成、複雑な指示への対応 |

目安として、繰り返し発生する定型業務はminimal〜low、判断の文脈が複雑な業務はmedium〜high、という使い分けることで、コストを抑えつつ必要な精度を確保できます。

Gemini 3.1 Flash-Liteの日本語対応力を知る上で参考になるのが、多言語QAベンチマーク「MMMLU」の指標です。MMMLU は英語以外の言語での知識理解と回答精度を測定する指標で、多言語対応では88.9%と、同価格帯のモデルの中でもトップクラスを打ち出しています。

ベンチマークスコアはあくまで参考値ですが、日本語を含む多言語対応業務の基準の1つとして認識できます。

Gemini 3シリーズには、用途と予算に応じた3つのモデルがあります。

それぞれの役割を理解し、Flash-Liteの立ち位置を把握するために以下表で比較してみましょう。

| 項目 | Gemini 3.1 Pro | Gemini 3 Flash | Gemini 3.1 Flash-Lite |

| 位置づけ | 複雑な推論・創造的タスク向け | バランス型・中位モデル | 大量処理・低コスト特化 |

| 入力料金

(1Mトークン) |

$2.00 | $0.50 | $0.25 |

| 出力料金

(1Mトークン) |

$12.00 | $3.00 | $1.50 |

| 出力速度 | ー | ー | 363トークン/秒 |

| Thinkingレベル | あり | あり | あり(4段階) |

| マルチモーダル対応 | テキスト・画像・動画・音声 | テキスト・画像・動画・音声 | テキスト・画像・動画・音声・PDF |

各モデルの性能を定量的に把握するため、Google DeepMindが公表している主要ベンチマークの数値を以下にまとめました。

| ベンチマーク | 測定内容 | Gemini 3.1 Flash-Lite | Gemini 2.5 Flash |

| GPQA Diamond | 科学的推論(物理・化学・生物・数学) | 86.9% | — |

| MMMU Pro | マルチモーダル推論 | 76.8% | — |

| Video-MMMU | 動画理解 | 84.8% | 79.2% |

| MMMLU | 多言語QA | 88.9% | 86.6% |

| LiveCodeBench | コード生成 | 72.0% | — |

| SimpleQA | 事実の正確性 | 43.3% | — |

| Humanity’s Last Exam | 抽象的な難問・推論 | 16.0% | — |

※―は非公開情報のため不明

Gemini 3.1 Flash-Liteは軽量モデルでありながら、前モデルの多くの指標を上回っています。中でも、特に科学的知識やマルチモーダル理解、動画処理で突出して高い数値を示しています。

一方で、コード生成と抽象的な難問推論はスコアが低い傾向があるため、タスク内容ごとの使い分けが望ましいでしょう。

Gemini 3.1 Flash-Liteは、Google AI StudioとVertex AIの2つで利用できます。それぞれの使用手順を紹介します。

Google AI Studioは、Googleが提供するブラウザ上のAI開発・検証環境です。アカウント登録だけですぐに利用でき、Gemini 3.1 Flash-Liteの無料枠が用意されています。

使い方は、以下の通りです。

AI Studioでは、入力内容がGoogleのサービス改善に利用される可能性があるため、個人情報や守秘義務のある情報は入力しないよう注意が必要です。

関連記事:無料で使える Google AI Studioとは?使い方から料金まで詳しく解説

Vertex AIは、Google Cloudが提供するAI開発基盤です。本番運用のためのプラットフォームで、従量課金制で使えます。利用手順は以下の通りです。

関連記事:Vertex AIとは?使い方や料金、GoogleのGeminiとの違いも紹介

Gemini 3.1 Flash-LiteをAPI経由で呼び出す仕組みは、既存の業務システムやSaaSツールへの組み込みに対応しやすいというメリットがあります。

ただし、スムーズに連携するために、以下のポイントをあらかじめ把握しておきましょう。

Gemini 3.1 Flash-Liteは、Gemini 3シリーズの中で最もコスト効率に優れています。基本料金に加え、バッチAPIの割引や上位モデルとの価格差を把握することで、自社の目的に見合ったモデル選定が可能です。

Gemini 3.1 Flash-Liteは、Gemini 3シリーズの中で最もコスト効率に優れています。基本料金に加え、バッチAPIの割引や上位モデルとの価格差を把握することで、自社の目的に見合ったモデル選定が可能です。

Gemini 3シリーズ内の料金は、以下の通りです。

| モデル | Gemini 3.1 Pro | Gemini 3 Flash | Gemini 3.1 Flash-Lite |

| 入力(1Mトークン) | $2.00 | $0.50 | $0.25 |

| 出力(1Mトークン) | $12.00 | $3.00 | $1.50 |

※Pro:200Kトークン超の入力で料金アップ

Flash-Liteとの価格差は、用途や処理量によって異なりますが、コストを優先する際にはGemini 3.1 Flash-Liteが有利です。

バッチAPI(大量のリクエストをまとめて送信し非同期で結果を受け取る処理)を利用する場合、50%割引が適用されます。

例えば、夜間の大量ドキュメント分類・要約、商品説明や社内マニュアルの多言語一括翻訳、問い合わせ履歴の定期分析といった即時応答が不要なタスクは、バッチAPIを活用することで料金を半分に抑えられます。

チャットボット応答のようなリアルタイム処理と、バッチAPIでの処理とでモデルを使い分けることで、コストの最適化が可能です。

Gemini 3.1 Flash-LiteをAPIで利用する場合、適用される規約は利用経路によって異なります。

| 利用経路 | 適用規約 | データの取り扱い |

| Google AI Studio

(無料枠) |

Gemini API追加利用規約 | Googleの製品改善・学習に利用される可能性あり |

| Gemini API

(有料) |

Gemini API追加利用規約

(有料版) |

無料枠とは異なるデータ保護条件が適用される |

| Vertex AI | Google Cloud Platform

利用規約 |

指示・回答はモデル学習に使用されない |

Googleの利用規約には、「Googleは生成されたコンテンツの所有権を主張しない」と明記されています。

ただし、著作権侵害リスクの判断・管理はユーザー側で責任を持って行う必要があります。

Gemini 3.1 Flash-Liteと競合モデル(GPT-5 mini・Claude Haiku 4.5)との違いを、以下の比較表で整理します。

| 比較項目 | Gemini 3.1 Flash-Lite | GPT-5 mini | Claude Haiku 4.5 |

| 入力料金(1Mトークン) | $0.25 | $0.25 | $1.00 |

| 出力料金(1Mトークン) | $1.50 | $2.00 | $5.00 |

| コンテキストウィンドウ | 100万トークン | 40万トークン | 20万トークン |

| 出力速度 | 363トークン/秒 | ー | ー |

| マルチモーダル入力 | テキスト・画像・動画・音声・PDF | テキスト・画像 | テキスト・画像 |

| Thinking(推論制御) | あり(4段階) | あり | あり |

選定の目安として、大量処理や多言語、マルチモーダル対応を重視する場合は、コンテキストウィンドウが他モデルよりも広く、動画・音声入力にも対応しているGemini 3.1 Flash-Liteが向いています。

同条件での処理量が多いほど、コスト面で有利です。

ここからは、Gemini 3.1 Flash-Liteの具体的な活用について見ていきます。性能が向上した最新モデルとはいえ、すべての業務に万能というわけではありません。

タスクごとの向き不向きを把握して、使い分けを検討する必要があります。

Gemini 3.1 Flash-Liteの特性とベンチマーク評価を踏まえた業務の分類は、以下の通りです。

向いている業務

向いていない業務

カスケーディングとは、処理の複雑さに応じてAIモデルを段階的に切り替える仕組みです。

例えば、Flash-Liteで対応できる処理と、Proが得意とする処理とで、モデルを使い分けることでAPIコストの削減につながります。

日本国内でも導入が始まっています。シフトプラス株式会社は、都城市と共同開発した自治体向け生成AI活用システム「自治体AI zevo(ゼヴォ)」において、2026年3月よりGemini 3.1 Flash-Liteを全利用自治体へ提供開始しました。

今回のGemini 3.1 Flash-Lite追加により、自治体AI zevoで選択できるモデルの幅が広がりました。セキュリティ要件が厳しい自治体のネットワーク環境(LGWAN)での採用は、導入実績として注目されています。

Gemini 3.1 Flash-Liteは現在プレビュー版であり、正式版のリリース時に仕様が変更される可能性があります。また、GA版と比べてリクエスト上限が厳しめとなることも考えられるため、大量のタスク処理を前提とする導入計画は事前に設定を確認することが重要です。

Gemini 3.1 Flash-Liteは、処理スピードとコストパフォーマンスに優れた最新モデルです。翻訳・要約・分類・チャットボットなど、繰り返し発生する定型業務に強みがありますが、上位モデルとのカスケーディング設計による使い分けが、業務利用での最適なアプローチと言えます。

自社の業務にどの生成AIモデルが適しているか、より詳細な比較検討にはアイスマイリーの生成AIサービス比較と企業一覧もあわせてご活用ください。

アイスマイリーでは、生成AI のサービス比較と企業一覧を無料配布しています。課題や目的に応じたサービスを比較検討できますので、ぜひこの機会にお問い合わせください。

速度・性能は大幅に向上し、料金は下がっています。移行する際には、実際の利用状況を想定し、処理スピードやコストとの総合的なバランスを試算した上で判断しましょう。

Google AI Studioの無料枠を利用できます。アカウント登録のみで即日アクセスできるため、評価・検証段階にコストをかけずに試したい場合におすすめです。

ただし、リクエスト内容がGoogleのサービス改善に利用される可能性があります。機密情報や個人情報の入力は避けるとともに、業務での本格的な活用にはVertex AI経由の環境を検討しましょう。

翻訳・分類・要約など定型的な繰り返し作業にはFlash-Lite、チャットボットや中難易度の推論が含まれる業務にはFlash、より複雑な分析や意思決定の支援、高度なコード生成にはProが向いています。

Gemini 3の各モデルを役割分担させるカスケーディング設計により、品質を維持しながらコストを抑えられます。

業務の課題解決に繋がる最新DX・情報をお届けいたします。

メールマガジンの配信をご希望の方は、下記フォームよりご登録ください。登録無料です。

AI製品・ソリューションの掲載を

希望される企業様はこちら