生成AI

最終更新日:2025/11/10

ChatGPT APIとは?

ChatGPT APIとは?

OpenAIの「ChatGPT API」は、2023年3月2日にリリースされました。テキスト、画像、音声、動画などのマルチモーダル処理機能を備えた最新のAIモデル「GPT-4」「GPT-5」にも対応しているChatGPT APIによりさまざまなアプリケーションに機能を実装することが可能です。

本記事では、ChatGPT APIの概要や登録方法、トークン利用料金などについて詳しく解説します。実際にChatGPT APIを導入している企業事例もあわせて紹介しますので、自社サービスの拡張やChatGPT連携サービスの活用を検討している方は、ぜひ参考にしてください。

ChatGPTについて詳しく知りたい方は以下の記事もご覧ください。

ChatGPTとは?使い方や始め方、日本語対応アプリでできることも紹介!

GPT-5とは?最新AIモデルの特徴をGPT-4と比較して解説

※ 本記事は初版をベースに、2025年以降の変更点を反映しています。新規実装は Responses API(/responses) が推奨です。

・ Structured Outputs (JSON Schema)で“壊れにくいJSON”を返せます

・ Realtime API で音声/テキストの低遅延ストリーミングが可能です

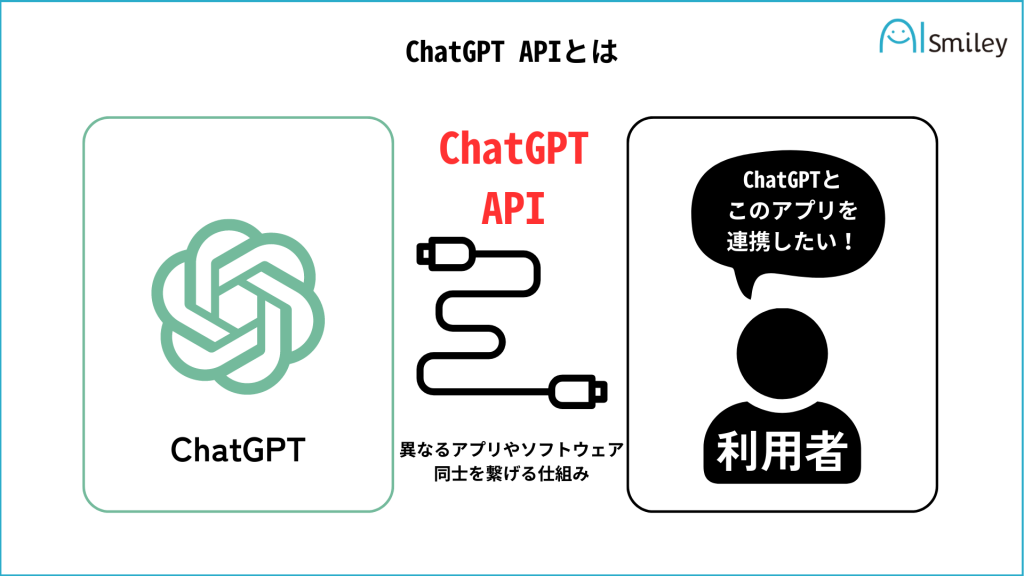

「ChatGPT API」とは、OpenAIによる自然言語処理のためのAIモデル「ChatGPT」を使用して、開発者が自然言語処理を行う際に使われるAPIです。APIは「Application Programming Interface(アプリケーション・プログラミング・インターフェース)」の略称で、ソフトウェアやWebサービスの間をつなぐインターフェースを指します。

以前は、ChatGPTはブラウザからしか利用できませんでした。しかしChatGPT APIが登場したことにより、開発者は他のソフトウェアやプログラムとChatGPTを連携し、ChatGPTのタスクを実行させることが可能になりました。

リリース当初は言語モデル「GPT-3.5-turbo」を採用していましたが、現在は最新モデルであるGPT-5に対応しています。

2025年以降は、用途ごとに分かれていた旧エンドポイントを Responses API(/responses) に統合して利用するのが基本方針となりました。本記事では最新の入口=Responsesを説明します。

OpenAIのガイドラインには、ユーザーから送信されるデータを秘密保持し、外部に漏れないように厳重に保管していると記載されています。

また、OpenAIのデータをモデル学習に使用しない方針を採っているため、ユーザーのデータが未許可で利用されることを防ぐことができます。

ChatGPT APIを使用する際には必ずガイドラインをチェックして、安全性の確認を行うようにしましょう。

(参考:OpenAIガイドライン)

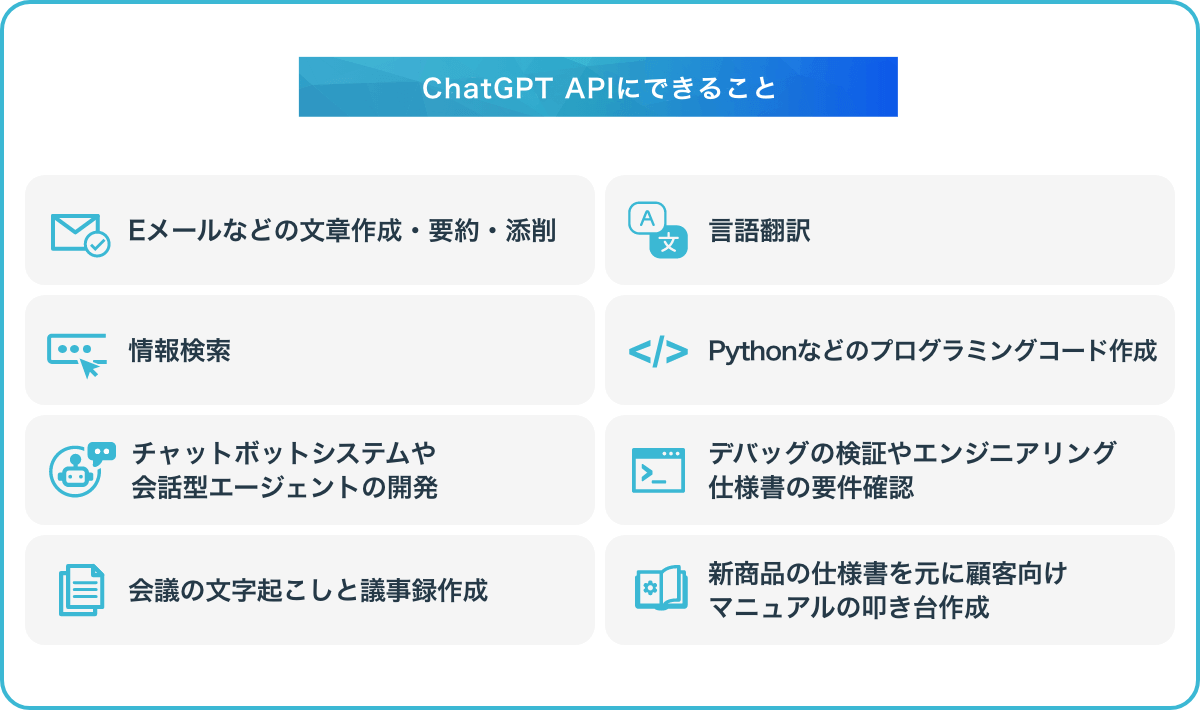

ChatGPT APIを使うことで、次のようなことができます。

自然言語処理機能を使ったさまざまなタスクへの応用が可能です。また、チャット形式は複数ターンでの会話をベースに設計されていますが、シングルターンでの使用も可能です。

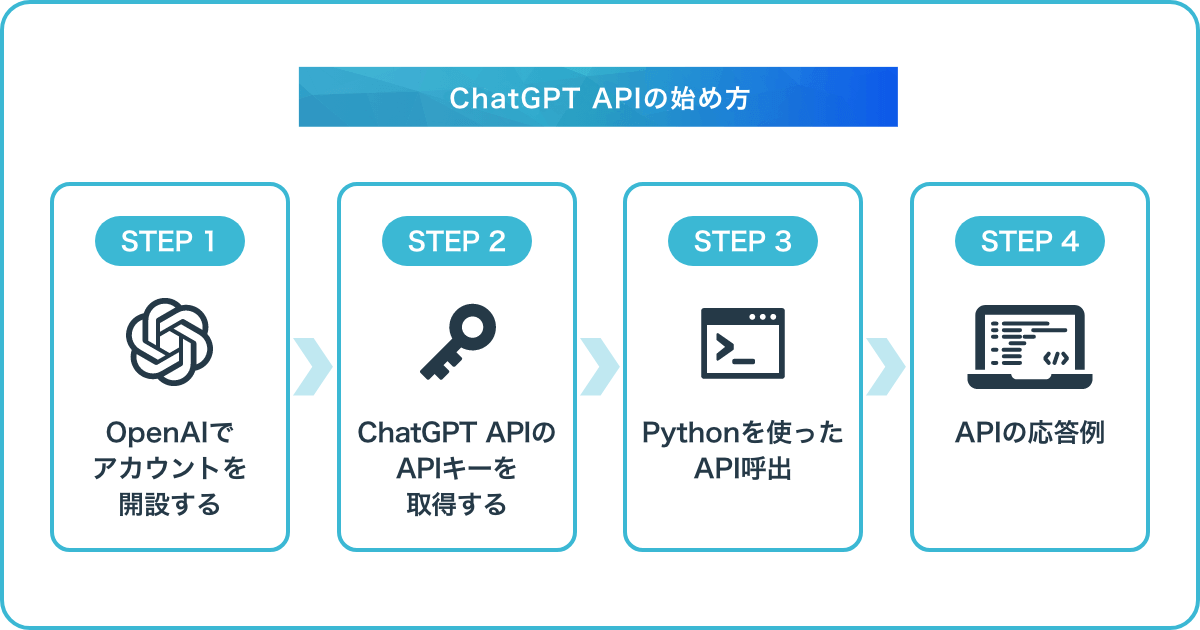

ここからは、ChatGPT APIをPythonで使い始める手順を、最新の Responses API に沿って解説します。次の4ステップで進めれば、まずは「動く」ところまで到達できます。

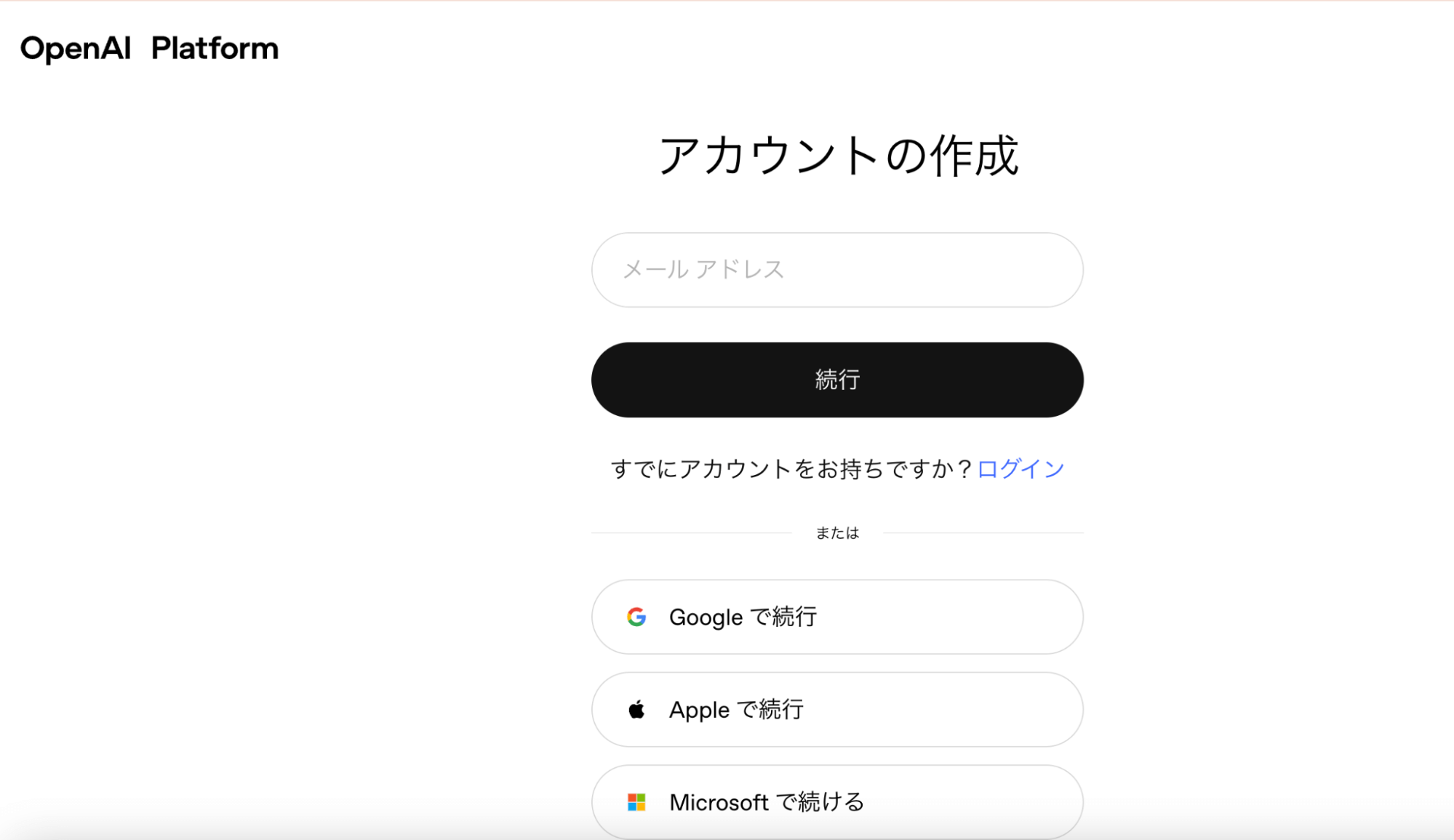

まず、OpenAIアカウントを開設するために、サイトにアクセスします。画面中央に表示されている「ログイン」からAPIプラットフォームを選択し、アカウント作成に進みます。

フォームが表示されたら、メールアドレスを入力します。GoogleアカウントやMicrosoftアカウントによる認証による登録も可能で、希望する方法を選べる点は便利です。

パスワードを入力した後、氏名や生年月日、電話番号など画面の指示に従って必要情報を入力します。最後のステップで電話認証が必要になるため、SMS認証が使える電話番号を入力しましょう。

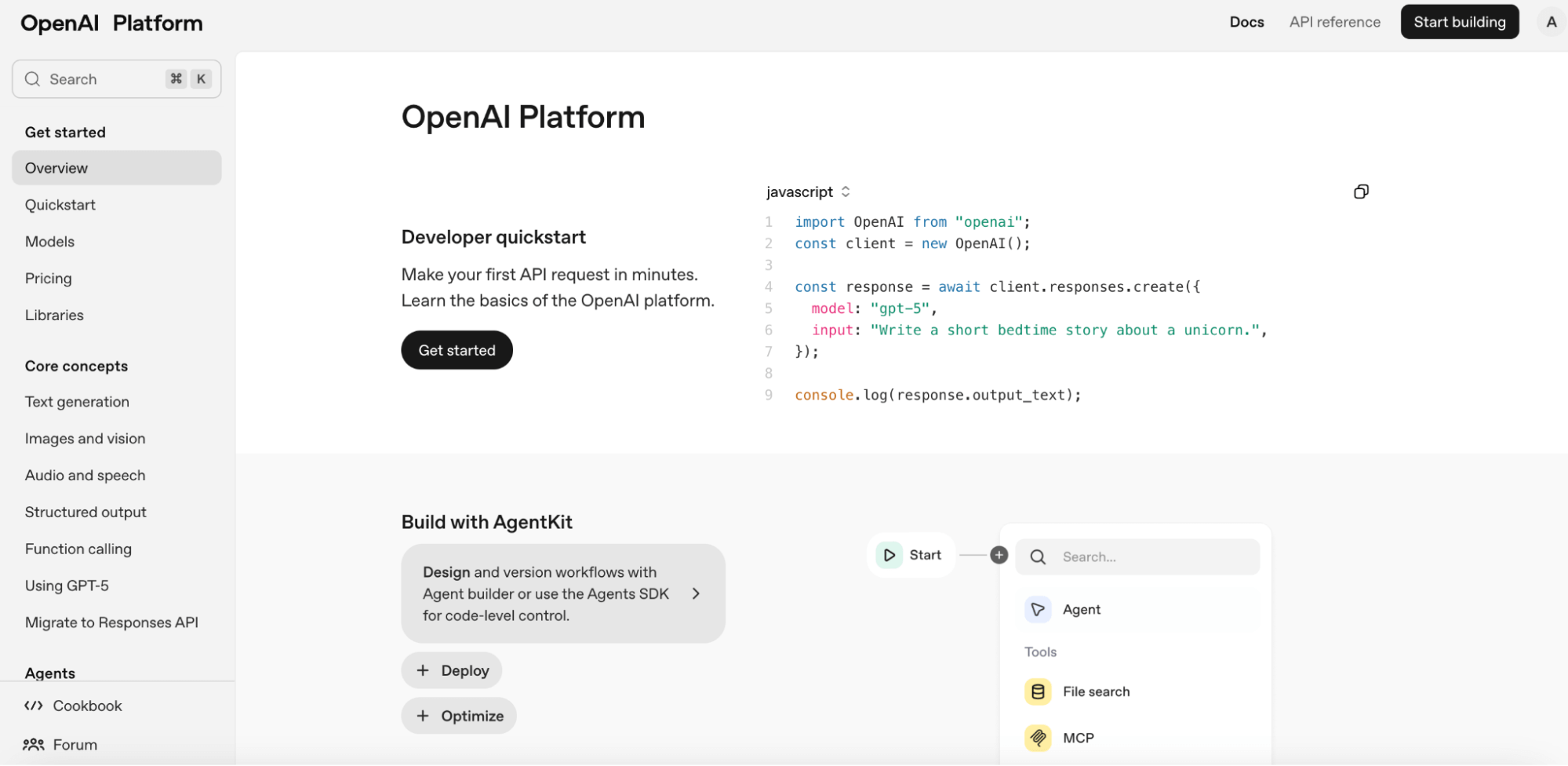

OpenAIにサインアップしたら、続いてAPIキーを取得します。サイトにアクセスしたら、右上のStart buildingをクリックします。企業か個人か、利用目的などを入力する画面が出ますので、自分の所属に従って入力します。

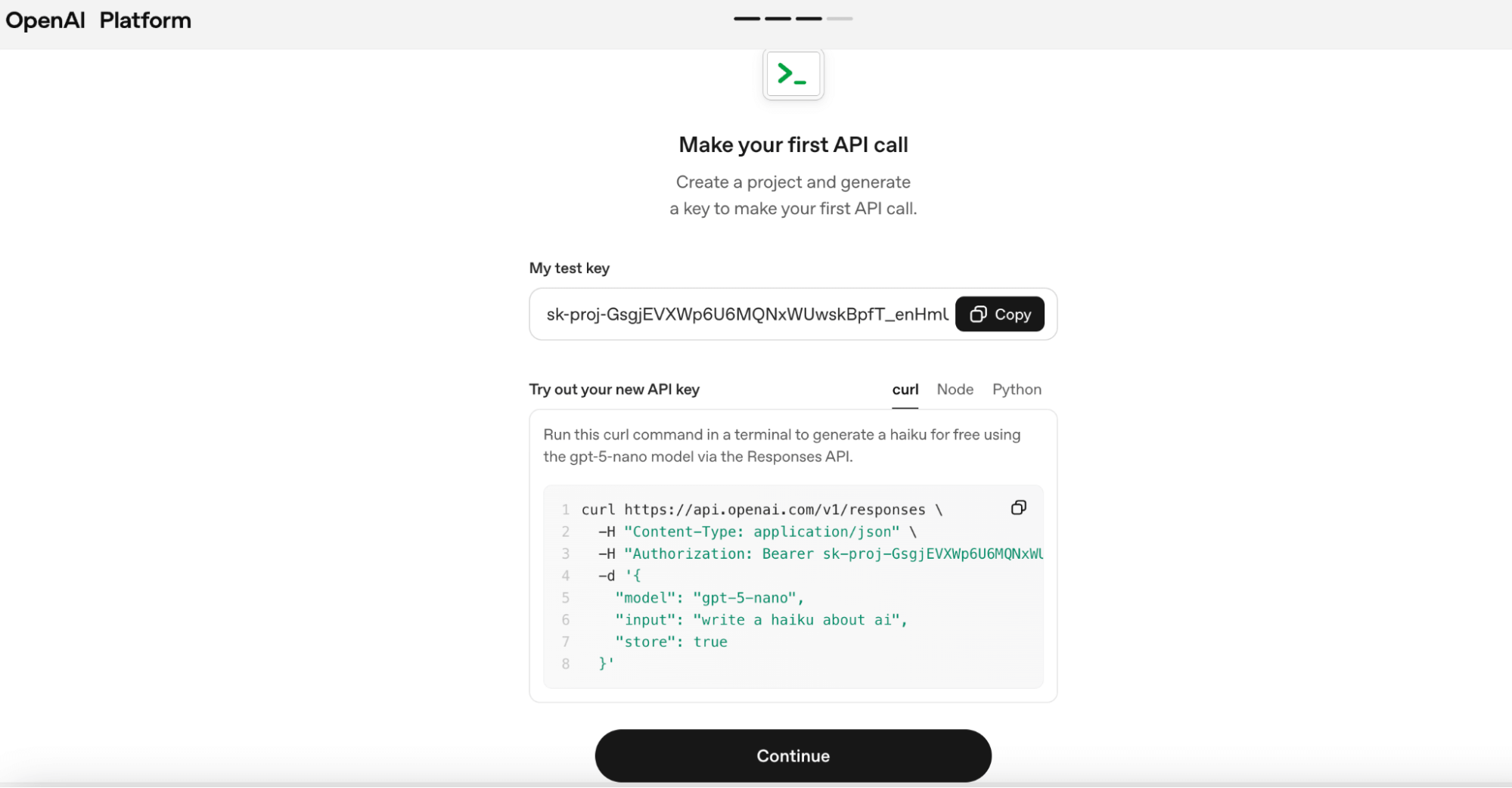

Make your first API callという画面でキーが表示されます。キー(sk-…)が表示されるのは最初の一度だけです。必ずコピーして安全な場所に保存してください。見失った場合は、古いキーをRevokeし、Create new secret keyで新しいキーを発行して使います。

※APIキーはサーバ側で管理し、ブラウザには置かないでください。

以下の最短コードで、まずは動作を確認します。OPENAI_API_KEY は先に設定しておきます。

from openai import OpenAI

import os

client = OpenAI(api_key=os.environ.get("OPENAI_API_KEY"))

res = client.responses.create(

model="gpt-4o-mini",

input="自己紹介を3行で書いてください。")

print(res.output_text)

入口は /responses、出力は output_text で取り出します。

from openai import OpenAI

client = OpenAI()

with client.responses.stream(

model="gpt-4o-mini",

input="50文字で旅のキャッチコピーを1つ"

) as stream:

for e in stream:

if e.type == "response.output_text.delta":

print(e.delta, end="", flush=True)

UIやDBに直接渡したいときは、JSONの型を指定します。

from openai import OpenAI

client = OpenAI()

res = client.responses.create(

model="gpt-4o-mini",

input="レビュー文から rating(1-5) と summary を返してください。",

response_format={

"type": "json_schema",

"json_schema": {

"name": "Review",

"schema": {

"type": "object",

"required": ["rating", "summary"],

"properties": {

"rating": {"type": "integer"},

"summary": {"type": "string"}

}}}})

print(res.output_text) # スキーマ通りのJSON文字列

まとめ:まずは output_text で受け取り、表示を速く見せたいときはストリーミング、画面やDBにそのまま渡すなら Structured Outputs を使います。

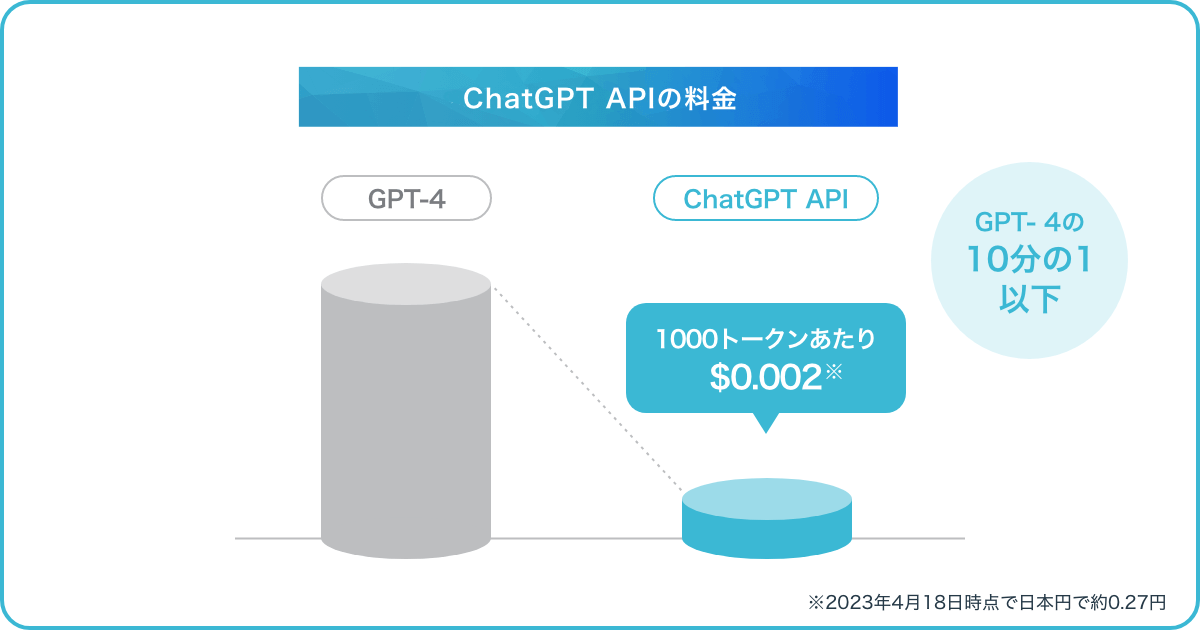

価格はモデルごとに100万トークン単価で公開されています。最新の金額は公式の価格表を確認してください。モデルと為替は更新が多いため、本記事では固定の金額は記載しません。

GPT-5は 入力が100万トークンあたり1.25ドル、キャッシュされた入力が0.125ドル、出力が10.00ドルです。GPT-5 miniは 入力が0.25ドル、キャッシュされた入力が0.025ドル、出力が2.00ドルです。キャッシュは同じ入力を繰り返す場面で適用されます。概算は、総トークンを100万円分の単価で割り戻してください。最新の金額は必ず公式の価格表を確認してください。まずはGPT-5 miniで開始し、精度が必要になったらGPT-5に切り替えると良いでしょう。

ChatGPT APIは有料であっても、格安で利用できる点に魅力を感じる人は多いでしょう。料金は、入力トークンと出力トークンの合計で決まります。仕組みを理解しないと想定外の請求につながります。

ここでは、ChatGPT APIの利用料金を決めるトークン消費の注意点について解説します。

トークン消費の注意点は、以下の2点です。

ChatGPT APIで文脈に沿った回答を得るためには、必要な要点だけを送る設計にする必要があります。最初の応答は1つの投稿文のみですが、2回目の応答では「1回目の投稿文」「1回目の応答文」「2回目の投稿文」という3つのメッセージをに含めることが多く、入力トークンが増えやすくなります。

料金は入力と出力の合計で決まります。やり取りが増えるほど入力が増えやすく、合計トークンも増えるため料金が上がります。1回のリクエストに情報を詰め込みすぎると高額になり得ます。過去のやり取り全てを毎回送ることは避け、必要な要点だけを残す設計にしましょう。

日本語は英語よりトークンが多くなりやすいです。単語の区切りがなく、英語に最適化されたトークナイザーでは語が細かく分割されやすいためです。さらに敬語や助詞の存在も、多くなる原因となります。日本語で長いやり取りを続ける設計は、トークン消費量が多い=費用が増えやすいので注意しましょう。

ChatGPT APIの利用料金を安く抑えるためには、トークン使用量を減らす工夫が有用です。ここでは、トークン使用量を抑えるための3つのコツを紹介します。

トークン使用量を抑えるためのコツは、以下の3つです。

過去のやり取りをそのまま毎回送ると、入力トークンが雪だるま式に増えます。直近の数ターンだけ残し、それ以前は要点だけの要約に置き換えます。要約には結論、根拠、未解決の問いの三点を入れると再現性が上がります。

長文を許すと出力トークンが増え続けます。最初は短い形式で答えるよう指示し、必要なときだけ続きや詳細を求めます。max_output_tokensを小さめに始めて、品質とコストのバランスを見ながら段階的に上げます。

同じ内容でも日本語はトークンが多くなりやすいです。モデルへの指示や中間の思考用テキストは英語にし、ユーザーへの入出力だけ日本語にします。表記を統一し、冗長な敬語や定型文は簡潔に整えるとさらに効果が出ます。

ChatGPT APIの活用事例は、以下の3つです。

各サービスにおけるChatGPT APIの実装が、サービスの性能やユーザーエクスペリエンスにおける変化などについて解説します。自社のChatGPT API活用を検討する際の参考としてご覧ください。

毎月5,000万人以上のユーザーを持つ言語学習プラットフォーム「Duolingo(デュオリンゴ)」は、ChatGPT APIを用いて、新しいサブスクリプション「Duolingo Max」を開発しました。

AIチャットパートナー機能と、間違えた箇所の文法説明という2つの新機能を備えたこのプランは、ユーザーの利用傾向をAIが学習データとして蓄積し、効率的に学習を進められるよう進化していく仕組みです。

同社は有料プラン「Duolingo Max」でGPT-4を活用した「スマート解説」「ロールプレイ」「リリーとビデオ通話」を案内しています。 2025年には148コースの追加など生成AIを活用した拡張を公表しています。

無料オンライン学習サービスの「Khan Academy(カーン・アカデミー)」では、ChatGPT APIを導入し、GPT-4を使ったAI搭載アシスタント「Khanmigo」のリリースを発表しています。Khanmigoは、生徒のための仮想家庭教師と、教師向け授業アシスタントという2つの機能を持つAIプログラムです。

Khan Academy はKhanmigo をGPT-4oベースで展開し、画像入力対応のチュータリングや多言語サポートなどの更新を公開しています。教育機関向けの提供拡大も公式に告知されています。

事業者向けオンライン決済の Stripe は、生成AIを活用してサポート対応やドキュメント検索、不正対策の高度化を進めています。開発者向けドキュメントでは、自然言語の質問に対して関連箇所の要約や抜粋を提示する取り組みが紹介されており、問い合わせの要約や回答作成の支援にも GPT-4 を用いています。不正対策領域でも AI の適用を強化しており、プロダクト群のアップデートとあわせて AI 活用の拡張を継続しています。

2022年11月にChatGPTが公開されて以来、多くの開発者が待ち望んでいたChatGPT APIが、2023年3月にリリースされました。ChatGPT APIにより、多くのアプリケーションからAPI経由で、テキスト作成や自動対話などの自然言語処理機能を活かしたシステムを利用できます。

料金はトークンの合計で決まります。価格はモデルごとに100万トークンあたりで公開されており、日本語で長いやり取りを続ける設計や履歴を大量に送る設計では費用が増えやすくなります。

現在の実装はResponses API(/responses)が推奨です。output_textでの取得、ストリーミング、Structured Outputs による厳密なJSON返却、Realtime の低遅延対話などを同じ入口で扱えます。

自社向けサービスでは、履歴の要約や出力の短文化、内部処理の英語化などでトークンを抑えつつ、モデル選択と運用を定期的に見直すことが重要です。

ChatGPTの使い方から実装例まで、基本情報は下記記事をご覧ください。

ChatGPTとは?使い方や始め方、日本語でできることを紹介!

ChatGPT連携サービスを検討している企業のご担当者の方は、下記一覧をご活用ください。

生成AIについて詳しく知りたい方は以下の記事もご覧ください。

生成AI(ジェネレーティブAI)とは?種類・使い方・できることをわかりやすく解説

AIについて詳しく知りたい方は以下の記事もご覧ください。

AI・人工知能とは?定義・歴史・種類・仕組みから事例まで徹底解説

業務の課題解決に繋がる最新DX・情報をお届けいたします。

メールマガジンの配信をご希望の方は、下記フォームよりご登録ください。登録無料です。

AI製品・ソリューションの掲載を

希望される企業様はこちら