生成AI

最終更新日:2026/04/03

TensorRTとは?

TensorRTとは?

AIモデルの推論速度に課題を感じている開発者の方に、NVIDIA TensorRTは強力な解決策を提供します。

この記事では、TensorRTの基本的な仕組みから実践的な使い方まで、体系的に解説していきます。

具体的には次のような内容を学べます。

PyTorchやTensorFlowで学習したモデルを本番環境で高速化したいエンジニアや、生成AIサービスの運用コストを削減したい企業の担当者にとって、実務に直結する知識が得られます。推論パフォーマンスを最大限に引き出すための技術を、今すぐ理解しましょう。

NVIDIA TensorRTは、学習済みのディープラーニングモデルをNVIDIA GPU上で高速かつ効率的に実行するための推論最適化ソフトウェア開発キット(SDK)です。AI開発には大きく分けて「学習」と「推論」という2つのフェーズが存在します。学習フェーズでは大量のデータを用いてモデルを訓練し、推論フェーズでは学習済みモデルを使って実際のデータに対して予測や判断を行います。

実際のビジネスで価値を生み出すのは推論フェーズです。推論処理の速度と効率性は、ビジネスの競争力を大きく左右します。自動運転では瞬時の判断が安全性に直結し、オンライン広告配信では応答速度が収益に影響します。医療画像診断では診断スピードが患者の治療開始時期を左右し、製造業の外観検査では処理速度が生産ラインの効率を決定します。

TensorRTは、こうした実運用における推論処理を最適化することに特化したツールです。モデルの精度を維持しながら、レイテンシの削減、スループットの向上、メモリ使用量の削減を実現します。

これにより、より少ないハードウェアリソースで高性能なAIサービスを提供できるようになり、運用コストの削減とユーザー体験の向上を同時に達成できます。

推論エンジンとは、PyTorchやTensorFlowといった深層学習フレームワークで学習させたモデルを、実際のサービスや製品で動かす際に高速な推論を実現するための専用ソフトウェア基盤です。

TensorRTは、これらのフレームワークで作成された学習済みモデルを受け取り、NVIDIA GPUの性能を最大限に引き出せるよう最適化された「TensorRTエンジン」へと変換します。

この変換プロセスでは、モデルの構造やパラメータを解析し、使用するGPUのアーキテクチャに合わせた最適な実行計画を自動生成します。これにより、以下の3つの効果が得られます。

推論エンジンは、学習済みモデルを実用レベルで運用するための橋渡し役として機能し、AIの社会実装を技術面から支える重要な役割を担っています。

TensorRTは、NVIDIAが提供する推論最適化のためのソフトウェア開発キット(SDK)であり、学習済みのディープラーニングモデルを実運用環境で高速に動作させるための包括的なツールセットです。

このSDKは、画像認識、自然言語処理、音声解析、自動運転といった多様なAIアプリケーションにおいて、リアルタイム性が求められる高度な処理の中核を担っています。

特にビジネスの現場では、AIモデルの応答速度が顧客体験に直結するため、低遅延なユーザー体験の実現が極めて重要です。

例えば、

といった用途では、わずか数ミリ秒の遅延が顧客満足度やブランドイメージ、さらには安全性に大きく影響します。

TensorRT SDKは、こうした要求に応えるため、ONNXやTensorFlowなどの対応形式をエンジン化するビルダー/パーサ、最適化エンジン、ランタイムライブラリを統合的に提供しており、開発者は複雑な最適化処理を意識することなく、高性能な推論システムを構築できます。

実際の導入企業では、推論速度が数倍から数十倍に向上した事例も報告されており、AIの実用化を技術面とビジネス面の両方から強力に支えるソリューションとなっています。

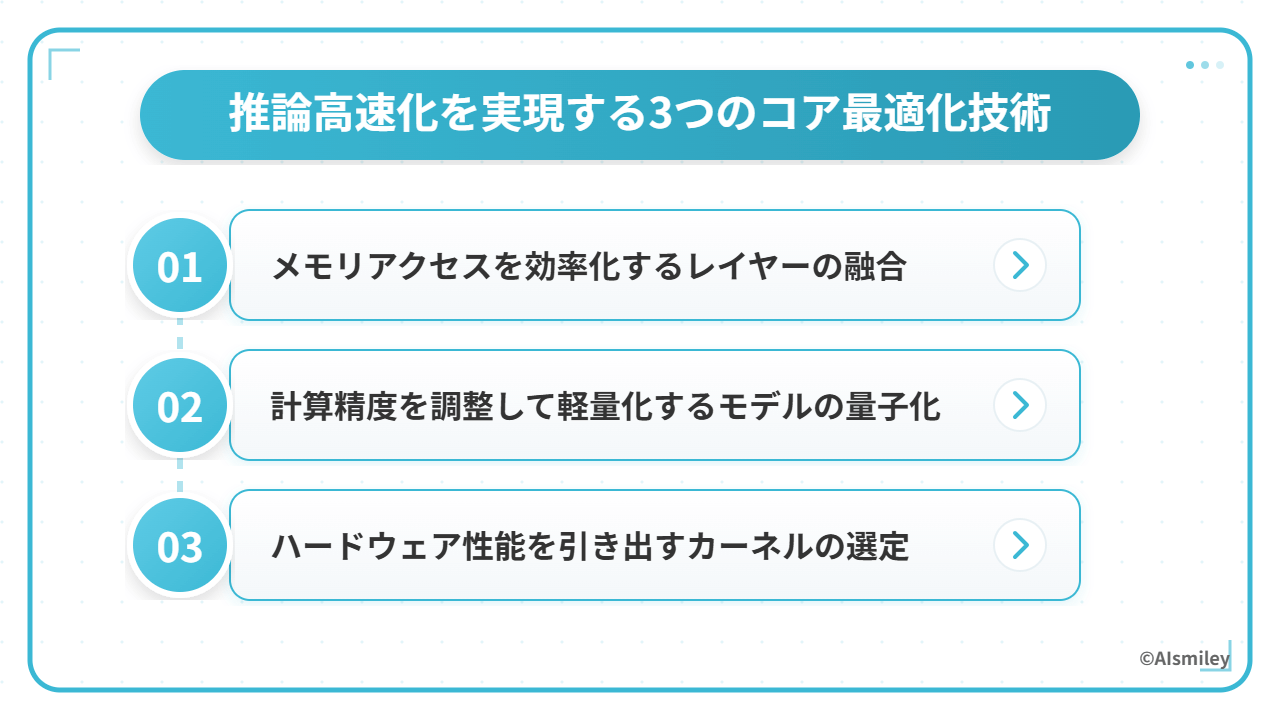

TensorRTが高速な推論を実現できる理由は、単純な計算能力の向上だけではなく、処理の無駄を徹底的に排除し、メモリを効率的に管理する独自の最適化プロセスにあります。

具体的には、TensorRTは以下の3つのコア技術を組み合わせて推論処理を高速化しています。

これらの技術は個別に動作するのではなく、相互に連携しながら最適化を進めます。

特に注目すべきは、TensorRTがターゲットとなるGPUの特性を詳細に分析し、そのハードウェアに最適化された実行プランを自動的に構築する点です。同じモデルであっても、データセンター向けの高性能GPUとエッジデバイス向けの省電力GPUでは、最適な処理方法が異なります。

TensorRTはこうした違いを認識し、それぞれの環境に合わせてオーダーメイドの最適化を施すことで、対応するNVIDIAプラットフォームで最高水準のパフォーマンスを引き出します。この柔軟性こそが、TensorRTが幅広い業界で採用される理由となっています。

ニューラルネットワークの推論処理では、各レイヤーが個別に実行されるたびにGPUメモリへのデータ転送が発生し、この読み書きのオーバーヘッドが全体の処理速度を大きく低下させる要因となります。

TensorRTのレイヤー融合技術は、連続する複数の演算ステップを1つのカーネルに統合することで、メモリアクセスの回数を劇的に削減します。

具体的には、次のような最適化が行われます。

例えば、チャットボットの自然言語処理において、埋め込み層と注意機構内部の行列演算、正規化、活性化関数といった一連の処理を個別に実行すると、各ステップでグローバルメモリへの書き込みと読み出しが繰り返されます。

レイヤー融合を適用すると、これらの処理が1つのカーネルにまとめられ、中間結果をレジスタや共有メモリといった高速なオンチップ資源に保持できるため、グローバルメモリへのアクセスが大幅に削減されます。

画像認識モデルでも同様に、特徴抽出の各段階を融合することで、メモリ帯域幅のボトルネックを緩和し、GPUの計算リソースを最大限に活用できるようになります。量子化やカーネル最適化など他の手法と組み合わせることで、推論速度が数十%から数倍向上することも珍しくありません。

TensorRTが推論を高速化する重要な手法の一つが、モデルの量子化です。これは、ニューラルネットワークの重みや演算に使用される数値の精度を下げることで、計算負荷とメモリ使用量を大幅に削減する技術です。

深層学習モデルの学習時にはFP32(32ビット浮動小数点数)という高精度な数値形式が使われますが、推論時にはより軽量な形式で十分な精度を維持できます。TensorRTは、このFP32形式を以下のような低精度形式へ変換することで高速化を実現します。

特にINT8量子化では、キャリブレーションと呼ばれる技術を用いて、代表的なデータセットでモデルの出力分布を分析し、精度への影響を最小限に抑えながら変換を行います。この手法により、わずかな精度低下に留めつつ、推論速度を大幅に向上させることができます。

データ型のビット数が小さくなれば、メモリ帯域幅の要求も削減され、演算器の処理効率も向上します。そのため、リアルタイム処理が求められる用途で大きな効果を発揮します。

TensorRTは、GPUの世代やデータサイズに応じて最も効率的な演算プログラム、すなわちカーネルを自動で試行・選択する「オートチューニング」機能を備えています。同じ行列演算でも、GPUのアーキテクチャやメモリ帯域幅、演算するデータの形状によって最適な実装方法は異なります。

TensorRTはビルド時に複数のカーネル実装を実際に実行し、その環境で最も高速なものを自動的に選び出します。この仕組みにより、開発者が手動でチューニングすることなく、常に最適な計算処理を適用できます。

具体的には、次のような要素に応じてカーネルが選定されます。

AmpereやHopperといった最新世代から、PascalやTuringといった過去の世代まで、各アーキテクチャに最適化されたカーネルライブラリが用意されています。そのため、ハードウェアを更新しても同じモデルで最大限の性能を引き出せます。この自動選定により、開発者は推論速度の最適化に時間を費やすことなく、アプリケーション開発に集中できます。

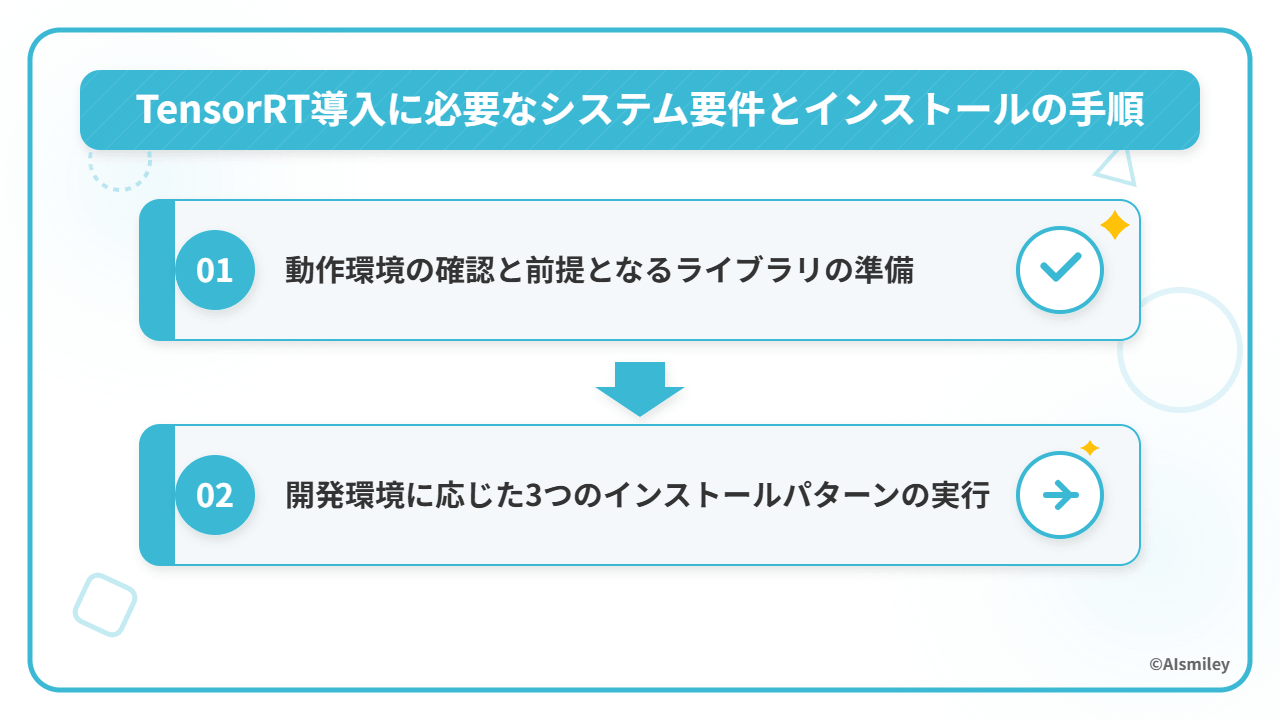

TensorRTを導入するには、まずNVIDIA製のGPUが必須です。TensorRTはNVIDIA GPUに特化した推論エンジンとして設計されており、AMD製やIntel製のGPUでは動作しません。また、GPUを制御するためのCUDAツールキットと、対応するバージョンのGPUドライバーが事前にインストールされている必要があります。

システム要件を満たした上で、実際のインストール方法は開発環境に応じて3つのパターンから選択できます。

Dockerコンテナを使う方法は、必要なライブラリがすべて含まれているため、環境構築の手間を最小限に抑えられます。既存のPython環境に組み込みたい場合はpipによるインストールが便利です。より細かいカスタマイズや特定バージョンの管理が必要な場合には、手動セットアップを選択します。

TensorRTを導入する前に、開発環境が必要な要件を満たしているかを確認します。最も重要なのは、NVIDIA GPUを搭載していることです。最新の最適化機能を活用するにはTuring(SM 7.5)世代以降が推奨されます。

次に、以下のソフトウェアコンポーネントが正しくインストールされているかを確認しましょう。

環境確認は、ターミナルやコマンドプロンプトで実行できます。CUDAのバージョンを確認するには「nvcc –version」コマンドを入力してください。

また、GPUの認識状況やドライバーのバージョンは「nvidia-smi」コマンドで確認できます。このコマンドを実行すると、搭載されているGPUの型番、使用中のメモリ量、ドライバーバージョンなどの詳細情報が表示されます。

TensorRTの各バージョンは対応するCUDAとcuDNNのバージョンが指定されているため、NVIDIA公式のサポートマトリックスで互換性を確認することが重要です。バージョンの組み合わせが適切でないと、インストールエラーや実行時の不具合が発生します。これらの確認作業を丁寧に行うことで、後続のインストール作業をスムーズに進められます。

TensorRTのインストールには、開発環境や運用体制に応じて選択できる3つの主要なパターンが用意されています。

最も推奨される方法は、NVIDIA公式が提供するDockerコンテナを利用する方法です。nvcr.ioから配布されているコンテナイメージには、TensorRTと必要な依存ライブラリがすべて含まれているため、環境構築の手間を大幅に削減できます。docker pullコマンドで取得し、docker runで起動するだけで、すぐに開発を始められます。

次に、Python開発者に適しているのがPipを使った導入方法です。pip install tensorrtのように通常のPythonパッケージと同様にインストールできるため、既存の開発環境に組み込みやすいという特徴があります。仮想環境での管理も容易で、プロジェクトごとに異なるバージョンを使い分けることも可能です。

最後に、本格的な製品環境や細かなカスタマイズが必要な場合には、tarファイルから直接インストールする方法が選択されます。NVIDIA公式サイトからtarアーカイブをダウンロードし、展開後にLD_LIBRARY_PATHなどの環境変数を適切に設定することで、システムレベルでの統合が可能になります。

この方法は柔軟性が高く、C++アプリケーションへの組み込みや、特定のシステム構成に最適化した導入を実現できます。

TensorRTを実際に利用する際には、学習済みモデルをそのまま使うのではなく、TensorRTが解釈できる形式に変換し、最適化エンジンを生成する一連のワークフローを理解する必要があります。この変換プロセスは大きく分けて二つのステップで構成されています。

第一に、PyTorchやTensorFlowなどのフレームワークで学習したモデルを、中間フォーマットであるONNX形式に出力します。ONNXは異なるフレームワーク間でモデルを交換するための標準的な形式であり、TensorRTはこのONNX形式を入力として受け取ることができます。

次に、ONNX形式のモデルをTensorRTエンジンにビルドする工程に進みます。このビルドプロセスでは、TensorRTが自動的にモデルを解析し、先述した最適化技術を適用して、特定のGPUハードウェアに最適化されたエンジンファイルを生成します。このエンジンファイルには、レイヤーの融合や最適なカーネルの選定といった最適化が反映されます。

INT8やFP16などの量子化を適用する場合は、ビルド時に設定を有効化し、必要に応じてキャリブレーションデータを用意することで、さらなる高速化を実現できます。

一度作成した最適化済みエンジンは、シリアライズしてファイルとして保存することが可能です。保存したエンジンファイルを本番環境で読み込み、推論コードから呼び出すことで、毎回ビルドする必要なく、GPU性能を限界まで引き出した高速な推論を実行できるようになります。

この仕組みにより、開発時の最適化作業と本番運用を明確に分離でき、実運用環境でのレイテンシを最小限に抑えることが実現します。

TensorRTでモデルを最適化するには、まずPyTorchやTensorFlowといった学習フレームワークで訓練したモデルを、中間フォーマットであるONNX形式に変換します。ONNXはOpen Neural Network Exchangeの略称で、異なるAIフレームワーク間でモデルを相互運用するための標準フォーマットです。

TensorRTがモデル構造を正確に解析して最適化を施すには、統一された形式でネットワーク定義を受け取る必要があるため、この変換プロセスが不可欠となります。

PyTorchの場合、torch.onnx.export関数を使用して、学習済みモデルとダミー入力データを指定するだけでONNX形式へ出力できます。TensorFlowでは、tf2onnxというツールを利用して同様の変換が可能です。

変換時には、入力テンソルの形状や動的バッチサイズの設定、演算子のバージョン指定など、いくつかのパラメータを適切に設定することで、後続のTensorRTビルドプロセスが円滑に進行します。ONNX形式に統一することで、フレームワークの違いを吸収し、TensorRTの強力な最適化機能を最大限に活用できる基盤が整います。

ONNXファイルをTensorRTエンジンに変換するには、Python APIを使用して最適化設定を行いながらビルドを実行します。まず、tensorrtライブラリをインポートし、Loggerオブジェクトを作成してからBuilderとNetworkを初期化します。次にONNXパーサーを用いてエクスポートしたモデルファイルを読み込み、ネットワーク定義に変換します。

ビルド時の最適化設定では、BuilderConfigオブジェクトを通じて重要なパラメータを指定できます。

代表的な設定として、

などがあり、これらを適切に組み合わせることで推論速度が大幅に向上します。TensorRTはビルド時に複数のカーネル実装を自動計測し、最速のものを選択する仕組みを備えています。

エンジンのビルドが完了したら、シリアライズして保存しておくことで次回以降の起動時間を短縮できます。推論実行時には、保存したエンジンをデシリアライズしてExecutionContextを作成し、入力データをGPUメモリにコピーします。CUDAストリームを活用することで、データ転送と演算処理を並行実行させ、さらなる高速化が実現できます。

最後にexecute_async_v2メソッドで推論を実行し、結果をホストメモリに転送して取得する流れとなります。

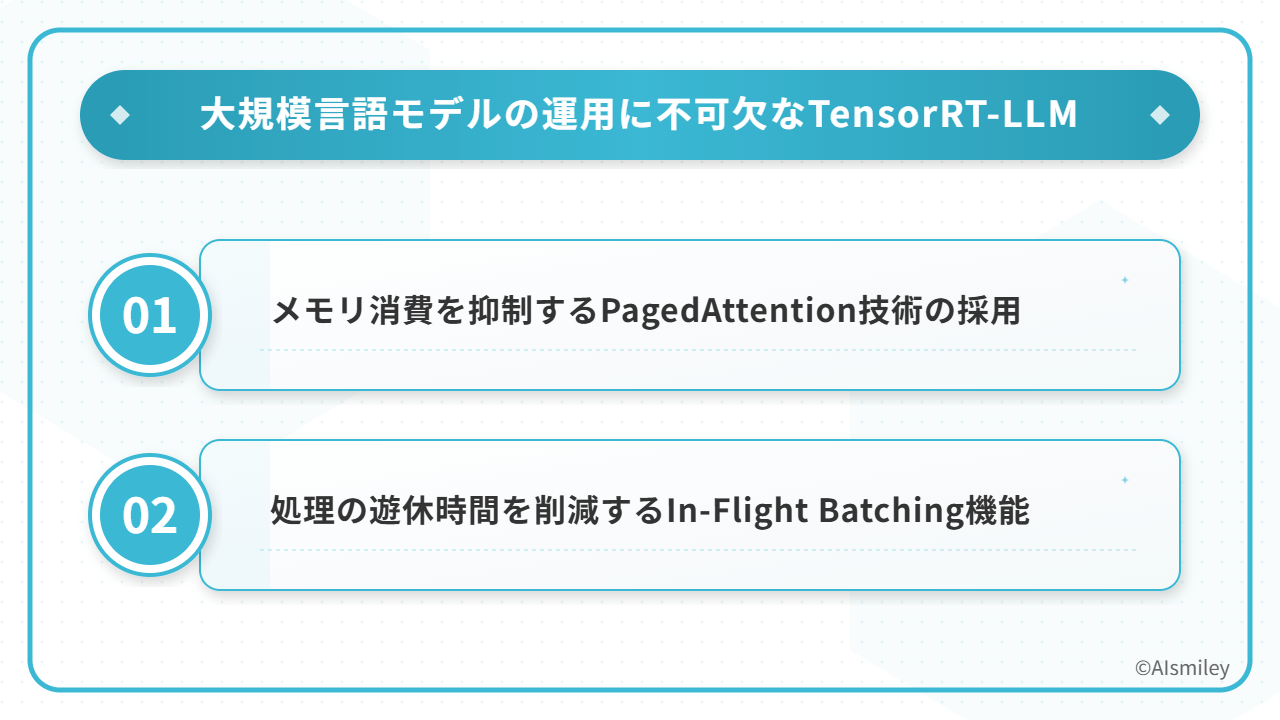

GPTやLlamaといった大規模言語モデル(LLM)は、膨大なパラメータ数とトークン処理の特性により、従来の推論エンジンでは効率的な運用が困難です。TensorRT-LLMは、こうしたLLM特有の課題を解決するために開発された専用のライブラリで、数十GBから数百GBに及ぶメモリ消費や、プロンプト長の変化に伴う動的な処理パターンに最適化されています。

TensorRT-LLMが解決する主な課題として、以下のようなものが挙げられます。

このライブラリは、LLMの商用運用において推論コストを大幅に削減し、レスポンス速度を向上させます。対話型AIサービスやリアルタイム翻訳システムでは、ユーザー体験を左右する応答速度とインフラコストの両面で重要な役割を果たします。

TensorRT-LLMの導入により、同じハードウェアでより多くのユーザーリクエストを処理できるようになり、事業者にとっての経済的メリットも明確です。

TensorRT-LLMでは、大規模言語モデルの推論時に膨大なメモリを消費するKVキャッシュの管理に、PagedAttentionという技術を採用しています。

この技術は、OSの仮想記憶システムにおけるページング機構から着想を得たもので、KVキャッシュを固定サイズの小さなページ単位に分割して管理します。

従来の連続したメモリ領域への割り当て方式では、リクエストごとに異なる長さのシーケンスを処理する際、メモリの断片化が発生し、実際には空き容量があるにもかかわらず新たな割り当てができない問題がありました。

PagedAttentionを導入することで得られる具体的なメリットは次の通りです。

この技術により、従来は数個のリクエストしか同時処理できなかった環境でも、数十個のリクエストを並行して処理できるようになり、スループットが劇的に向上します。

チャットボットや対話型AIなど、多数のユーザーから同時にリクエストが来るサービスにおいて、コストパフォーマンスの大幅な改善が実現されています。

In-Flight Batching機能は、従来のバッチ処理の課題を解決する革新的なスケジューリング技術です。通常のバッチ処理では、バッチ内のすべてのリクエストが完了するまで次のバッチを処理できないため、短い応答で終わったリクエストがあってもGPUは次のバッチまで待機状態になってしまいます。

In-Flight Batchingはこの遊休時間を削減するため、処理中のバッチに対して完了したリクエストの枠へ新しいリクエストを動的に追加していきます。

この仕組みにより実現される主なメリットは次の通りです。

大規模言語モデルのような生成AIサービスでは、ユーザーごとに生成されるトークン数が異なるため、この技術の効果は顕著です。

TensorRT-LLMにおけるIn-Flight Batching機能は、リアルタイムで到着するリクエストを効率的にスケジューリングし、コスト削減に直結する重要な最適化として多くの商用サービスで採用されています。

TensorRTは多様な業界で導入が進んでおり、自動運転、医療画像診断、品質検査など、それぞれの分野で顕著な成果を上げています。

自動運転では、車載カメラ映像をリアルタイム解析して歩行者や障害物を瞬時に検出するため、TensorRTによる推論高速化が欠かせません。NVIDIAのJetsonプラットフォームと組み合わせることで、エッジデバイスでもミリ秒単位の高速判断が可能となり、自動運転システムの実用化を力強く支えています。

医療画像診断においても、CTやMRI画像から病変を検出するAIモデルにTensorRTを適用することで推論が高速化されます。診断の迅速化はもちろん、医師の業務効率化にもつながり、より多くの患者へ質の高い医療を届ける環境が整いつつあるのです。

製造業の品質検査では、高速で流れる生産ラインに対してリアルタイムで欠陥を検出する必要があります。TensorRTの最適化により1秒あたりの処理枚数が大幅に増加し、従来のCPU処理と比べて生産効率は飛躍的に向上しました。

生成AIサービスでは、PerplexityなどのAI検索サービスがTensorRT-LLMを活用し、大規模言語モデルの推論を最適化しています。PagedAttentionやIn-Flight Batchingといった技術がメモリ効率とスループットを大幅に引き上げ、コスト削減と応答速度の改善という二つの課題を同時に解決しています。

自動運転の分野では、車載カメラの映像データやLiDARの点群データから得られる膨大な情報を瞬時に処理し、歩行者や他の車両、車線、交通標識などを正確に識別する必要があります。

TensorRTを活用することで、物体検出や画像セグメンテーションといった深層学習モデルの推論速度が大幅に向上し、ミリ秒単位での判断が求められる状況でも高速な走行制御を実現できます。

一瞬の遅れが重大な事故に直結するため、リアルタイム性は自動運転システムにとって生命線といえます。

医療画像診断の領域でも、TensorRTは重要な役割を果たしています。CTやMRIで撮影された高解像度の画像データは非常に大容量であり、従来の方法では解析に時間がかかっていました。

TensorRTによって最適化されたAIモデルを用いることで、以下のような診断支援が可能になります。

これにより医師は診断時にリアルタイムでAIのサポートを受けられ、見落としのリスクを減らしながら診断精度と効率を同時に高めることができます。

生成AIサービスの運用において、TensorRTは大幅なコスト削減を実現しています。対話型AI検索サービスのPerplexityは、TensorRT-LLMを採用することで推論処理を最適化し、応答速度の向上とインフラコストの削減を同時に達成しました。

大量のクエリを処理する検索サービスでは、推論エンジンの性能が直接的に運用コストとユーザー体験に影響するため、TensorRTのような最適化技術の導入効果は特に顕著です。

Eコマース分野でも同様の効果が確認されています。Amazonでは、ユーザーが入力したスペルミスをリアルタイムで自動修正する機能にTensorRTを活用し、50ミリ秒以下という極めて短い応答時間を実現しました。この高速化により、顧客は検索結果を待つストレスから解放され、満足度の向上につながっています。

これらの事例が示すように、TensorRTによる推論高速化は、単なる技術的な改善にとどまりません。サービス品質の向上と運用コストの削減という、ビジネス上の明確な価値を生み出しているのです。

TensorRTは、NVIDIAが提供する幅広いGPUアーキテクチャに対応しており、データセンターからエッジデバイスまで多様な環境で活用されています。用途に応じて最適なハードウェアを選択できることが、TensorRT普及の大きな要因のひとつです。

データセンター向けには、H100やA100といった高性能GPUが大規模言語モデルや画像生成AIの推論基盤として採用されています。Transformer Engineやマルチインスタンス機能を備えるこれらのGPUは、クラウドサービスやエンタープライズ環境での大量リクエスト処理に強みを発揮します。

一方、エッジコンピューティングの領域では、Jetsonシリーズが自動運転車やロボット、産業用カメラなどの組み込みデバイスで採用され、低消費電力でのリアルタイム推論を可能にしています。

プラットフォーム別の主な対応状況は、以下の通りです。

将来的には、5GやIoTの普及によりエッジでのAI処理需要がさらに急増すると予測されています。NVIDIAは新アーキテクチャの開発と並行してTensorRTの最適化技術も進化させており、より少ない電力でより高い性能を引き出せる方向へと進んでいます。

クラウドからエッジまであらゆる場所でAI推論が実行される時代に向けて、TensorRTはその中核技術としての役割をさらに強化していくでしょう。

用途別に見ると、それぞれのプラットフォームには明確な役割分担があります。データセンター向けのH100・A100は、大規模言語モデルの推論処理において圧倒的なスループットを誇ります。Transformer Engineによる混合精度演算やマルチインスタンス機能を活用することで、クラウドサービスやエンタープライズ環境における大量リクエストを効率的に処理できます。

開発者やクリエイター向けには、GeForce RTX 4090・RTX 4080などのRTXシリーズが広く使われています。低精度演算への対応により、手元の環境でモデルの検証やプロトタイピングをスムーズに進められる点が魅力です。

エッジ用途では、Jetson Orin NanoやJetson AGX Orinが活躍します。電力制約の厳しい自律走行ロボットやスマートカメラ、産業用IoT機器においても、TensorRTの最適化技術を最大限に引き出せる設計となっています。クラウドからエッジまで一貫したソフトウェアスタックで開発できることが、導入のハードルを下げる大きな要因となっています。

TensorRTの価値は、単体の推論エンジンにとどまりません。TensorRT-LLMやTriton Inference Serverといった関連ツールとの統合により、モデルの最適化から本番環境へのデプロイまでを一貫して担える開発基盤が整っています。

こうした環境の整備は、AI活用の裾野を着実に広げています。高度な推論最適化技術はかつて大手テック企業や研究機関の専有物でしたが、現在はスタートアップや個人開発者にも手が届くようになりました。その背景には以下のような取り組みがあります。

「AIの民主化」とも呼ばれるこの潮流は、小規模なチームでも高性能なAIアプリケーションを開発できる土台をつくりつつあります。多様な分野での革新的なサービスが生まれる素地は、着実に広がっているのです。

NVIDIA TensorRTは、学習済みAIモデルの推論を高速化する強力なソフトウェアSDKです。レイヤーの融合、モデルの量子化、カーネルの最適化という3つのコア技術により、GPUの性能を最大限に引き出し、推論速度を劇的に向上させます。

導入にあたっては、適切なシステム要件の確認とライブラリの準備が必要ですが、PyTorchなどのフレームワークからONNX形式を経由してTensorRTエンジンへ変換する手順は明確に整備されています。大規模言語モデルの運用では、TensorRT-LLMがPagedAttentionやIn-Flight Batchingといった先進技術によってメモリ効率と処理速度を両立させています。

自動運転や医療画像診断のようなリアルタイム処理が求められる分野から、クラウドベースの生成AIサービスまで、幅広い業界で実用化が進んでいます。データセンター向けのH100やA100から、エッジデバイス向けのJetsonシリーズまで対応する柔軟性と、充実したエコシステムによって、TensorRTはAIの実用化を支える中核技術として重要な役割を果たしています。

アイスマイリーでは、生成AI のサービス比較と企業一覧を無料配布しています。課題や目的に応じたサービスを比較検討できますので、ぜひこの機会にお問い合わせください。

業務の課題解決に繋がる最新DX・情報をお届けいたします。

メールマガジンの配信をご希望の方は、下記フォームよりご登録ください。登録無料です。

AI製品・ソリューションの掲載を

希望される企業様はこちら